全球出行巨头Uber近期宣布扩大与亚马逊云科技(AWS)的合作协议,将把派单算法、运力预测等更多核心网约车业务模块迁移至亚马逊自研AI芯片集群运行。此次合作被行业视作Uber对原有云服务商Oracle、谷歌云的直接替代,也是亚马逊自研芯片在ToB云服务市场拿下的又一标杆客户案例,进一步撼动了英伟达在AI加速硬件市场的主导地位。

此次合作更新于2026年4月正式对外披露,据双方公布的合作细节,Uber首批迁移的业务模块主要集中在实时性要求最高的C端出行服务场景,首批上线的芯片集群算力规模超过1200P Flops,可支撑全球17个国家和地区的日常出行需求调度。

最近两年,AI算力需求的爆发倒逼云服务厂商纷纷布局自研AI芯片,摆脱对英伟达单一供应链的依赖同时,也能为客户提供性价比更高的算力方案。亚马逊早在2018年就启动了AI芯片自研项目,目前已经迭代到第三代Inferentia推理芯片和第二代Trainium训练芯片,**公开测试数据显示,其推理场景的单位算力成本比英伟达A100低42%,能效比提升60%**。

此前包括Snap、Spotify在内的多家互联网企业已经部分迁移AI业务到亚马逊自研芯片上,Uber是目前出行行业首个大规模采用该方案的头部企业。

对于Uber而言,AI芯片的性能直接决定了核心业务的用户体验和运营成本:实时派单算法需要在毫秒级完成供需匹配,高峰时段的运力预测需要处理PB级的历史出行数据,甚至车内智能语音、安全识别等功能也需要大量的推理算力支撑。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

10 小时前

4月7日,AI大模型厂商Anthropic官方披露其年化收入(ARR)已突破300亿美元,首次反超竞争对手OpenAI同期250亿美元的年化收入水平。该公司2025年末年化收入仅为90亿美元,3个多月内收入规模大涨约210亿美元,同时同步官宣最新AI芯片采购大单,引发全球AI产业对大模型商业化格局的广泛讨论。

12 小时前

2026年4月,欧洲头部人工智能企业Mistral AI联合创始人兼CEO Arthur Mensch访韩期间,与三星电子副董事长兼CEO全永铉及核心高层会晤,双方重点围绕AI半导体存储芯片供应链、技术协同方案展开磋商。Mistral AI正寻求稳定XPU算力芯片供应以支撑模型迭代,三星在高带宽内存...

14 小时前

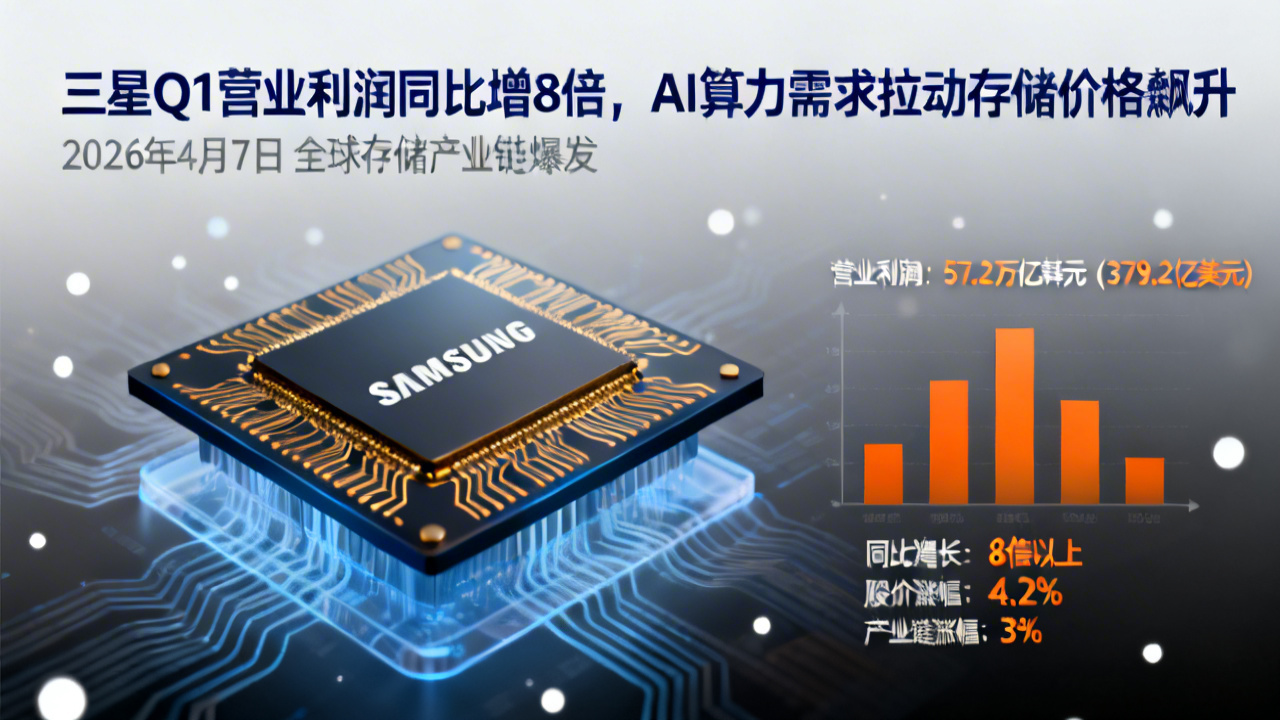

2026年4月7日,全球存储巨头三星电子发布2026年第一季度初步业绩预告,预计营业利润达57.2万亿韩元(约合379.2亿美元),较去年同期增长8倍以上,远超分析师预期的40.6万亿韩元。此轮业绩暴涨核心动力为生成式AI基础设施建设带来的存储芯片需求激增,存储价格大幅上涨推动行业彻底走出此前的下行周期。

3 天前

TechCrunch于2026年4月发布的最新民调显示,超62%的美国受访居民更支持社区周边新建亚马逊仓储设施,而非AI算力数据中心。当前AI大模型爆发带动全球算力需求年增速超80%,数据中心邻避效应已成为算力基建扩张的核心阻碍,该议题也将成为4月30日举办的StrictlyVC 2026旧金山峰会的核心讨论方向。

4 天前

2026年4月3日消息,2023年成立的印度AI初创公司Sarvam AI正式开启新一轮融资,计划募集3亿至3.5亿美元,由贝塞默风险投资领投,亚马逊、英伟达及沙特阿美旗下风投Prosperity7Ventures均在参投行列,融资完成后公司投后估值将达15亿至15.5亿美元,凸显全球资本对印度本土AI赛道的长期看好。

5 天前

当地时间2026年3月30日,有“HBM之父”之称的韩国科学技术院电气与电子工程学院教授金正浩公开对外表态,当前以英伟达GPU为核心的AI芯片体系即将发生根本性变革,未来高带宽内存(HBM)、高带宽闪存(HBF)将成为计算核心,GPU与CPU将退居配角,这一预判也引发全球半导体行业对存算一体架构落地节奏的广泛讨论。

6 天前

近日,专注于AI辅助半导体设计的初创企业Cognichip宣布完成6000万美元新一轮融资。该公司核心产品为面向AI算力芯片的全流程AI原生设计工具链,官方测试数据显示其可将芯片研发成本降低75%以上,研发周期缩短超50%,本次融资将主要用于技术迭代、团队扩张及商业化落地,有望破解AI算力芯片研发成本高、周期长的行业痛点。

6 天前

数据库巨头甲骨文为追赶生成式AI浪潮,举债500亿美元扩建AI数据中心遭遇现金流压力,于2026年3月31日启动大规模裁员,波及美印地区数千名员工,年内市值已蒸发超26%。投行TD Cowen测算,甲骨文若要维持当前AI扩张速度,需裁减2万至3万名员工,每年释放80亿至100亿美元自由现金流填补投入缺口。