2026年3月25日,《MIT科技评论》记者Michelle Kim发布最新一期《AI炒作指数》专题,聚焦军用AI领域最新动态:AI初创公司Anthropic因明确反对将旗下大模型Claude武器化,与美国五角大楼终止合作谈判,随后OpenAI快速接手相关合作项目,引发全球AI行业对技术伦理边界的集中讨论。

《MIT科技评论》推出的《AI炒作指数》是全球AI行业关注度最高的趋势观察栏目之一,每期都会筛选当期最具争议性的AI行业事件,从技术落地、伦理影响、商业价值多个维度给出中立评估,本期将军用AI作为核心主题,正是因为该赛道的近期变动已经触碰了全球AI从业者的共识红线。

过去两年,全球主要国家的国防部门都在加速AI技术的落地部署,仅美国五角大楼2026年披露的AI相关采购预算就超过120亿美元,同比2024年增长47%,涵盖情报分析、作战辅助、后勤调度多个场景。此前包括谷歌、微软在内的科技巨头都曾拿到过五角大楼的AI订单,但也多次因员工抗议伦理问题暂停部分项目。

此次Anthropic与五角大楼的分歧核心,恰恰是大模型是否可以被用于直接作战场景。据知情人士透露,五角大楼希望将Claude接入作战指挥系统,用于自动生成打击方案、识别高价值目标,而Anthropic的公司章程中明确要求,旗下技术不得被用于武器研发、大规模杀伤性工具开发等场景,其联合创始人达里奥·阿莫迪此前多次强调,公司的宪法AI机制从底层限制了模型输出有害内容,这也是其拒绝武器化合作的核心技术支撑,双方的谈判在僵持3个月后最终宣告破裂。

而OpenAI的选择则与Anthropic形成鲜明对比,OpenAI CEO萨姆·奥尔特曼此前就曾公开表示,AI技术应当服务于本国的国家安全需求,只要相关应用符合现有法律框架,OpenAI愿意与政府部门展开合作。此次接盘五角大楼的项目后,OpenAI将为后者提供定制化的GPT系列大模型服务,首批系统将在2026年下半年完成交付测试。

此次事件在全球AI行业引发的讨论还在持续,不少从业者担心,头部企业对军用AI合作的态度分化,可能会加速AI技术的军事化应用,甚至引发新一轮的全球AI军备竞赛。据《MIT科技评论》的评估,当前军用AI的炒作指数已经达到8.7分(满分10分),处于严重过热区间,技术落地的速度已经远超伦理规范的制定速度。

目前欧盟、中国等多个国家和地区已经在推进AI治理相关的立法工作,明确限制AI技术在武器领域的无底线应用,但全球层面的统一规范仍然处于空白状态。有行业专家指出,只有建立跨国家、跨企业的AI伦理共识,才能避免技术发展最终走向违背人类共同利益的方向。

28 分钟前

2026年4月,AI大模型研发商Anthropic在清理平台上泄露的自家源代码过程中出现操作失误,提交的下架申请误伤数千个无关GitHub开源仓库。Anthropic高管随后公开承认事故为人为操作导致,已第一时间撤销绝大多数不当下架通知,目前GitHub已逐步恢复所有被误下架仓库的正常访问权限。

3 小时前

国内大模型厂商智谱日前发布2025年全年业绩公告,全年营收达7.24亿元,同比增长131.9%,经调整净亏损31.82亿元,同比扩大29.1%。其最新推出的GLM-5发布24小时内即获字节、阿里、腾讯等头部大厂接入,国内前10大互联网公司已有9家深度集成GLM系列模型,旗下GLM Coding Plan付费开发者规模突破24.2万。

10 小时前

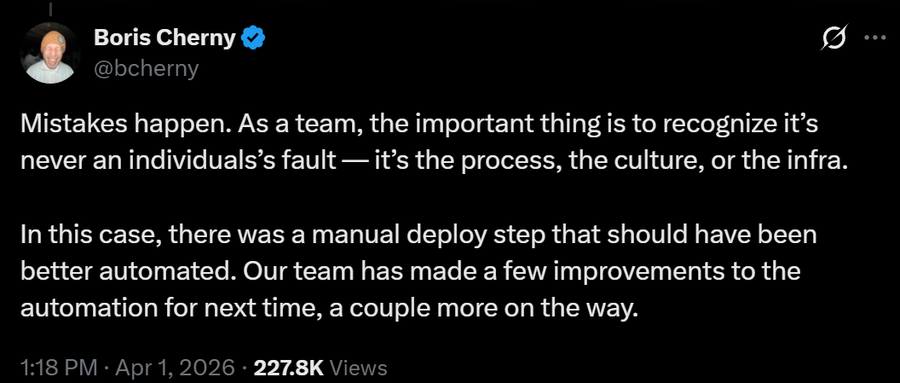

2026年4月,AI创企Anthropic旗下闭源编程工具Claude Code意外泄露引发行业震荡,项目负责人鲍里斯·切尔尼公开承认团队手动操作部署流程失误导致事故,第三方基于泄露代码推出的平替版本上线后短时间内便斩获GitHub 10万星,Anthropic随后紧急启动下架封杀措施,此次事件也引发行业对闭源AI项目安全管控的广泛讨论。

12 小时前

近日,科技公司Meta公布了一项针对大语言模型(LLM)代码审查场景的技术优化方案,其核心的半形式化推理方法通过结构化提示词约束模型追踪代码路径、论证结论合理性,在实现代码审查准确率提升超五成的同时,算力开销可降低超80%,大幅减少企业对高成本代码执行测试环境的依赖,为工业级LLM代码应用落地提供了新路径。

12 小时前

2026年4月1日,全球头部AI实验室Anthropic核心开发者鲍里斯·切尔尼就近日引发技术圈广泛关注的Claude Code源代码泄露事件正式回应,确认本次泄露并非黑客攻击,而是产品部署环节未混淆MAP调试文件被误打包的人为失误所致,目前Anthropic已启动版权清理,后续将升级部署自动化流程降低操作风险。

12 小时前

2026年4月1日,OpenAI官方宣布与金融AI初创公司Gradient Labs达成深度合作,依托GPT-5.4系列模型为普通银行用户提供此前仅面向私人银行客户的专属客户经理服务。Gradient Labs由前Monzo银行AI负责人创立,目前已将全量生产流量迁移至OpenAI最新架构,系统响应延迟低至500毫秒,覆盖欺诈处理、支付拦截等多个高频场景,将大幅优化传统银行服务流程。

13 小时前

2026年4月以来,基于大语言模型的AI文游在国内社交平台快速走红,普通用户可通过灵光App等零代码AI助手,以自然语言对话方式生成个性化文字游戏,部分创作者将成品以9.9元至30元的价格出售变现。这类轻量内容产品兼具高定制性与情感价值,不仅满足Z世代创作需求,也成为情绪经济的全新载体,推动内容创业逻辑发生转变。

15 小时前

2026年4月,AI企业Anthropic针对旗下代码大模型Claude Code的源代码泄露事件正式发起法律维权,向代码托管平台GitHub提交多份DMCA下架通知,后者已清理涉事主仓库及超8100个相关Fork分支,系近年AI行业规模最大的代码版权清理行动。经调查,本次泄露并非员工操作失误,而是Anthropic内部打包工具底层BUG所致。