2026年4月1日,全球头部AI实验室Anthropic核心开发者鲍里斯·切尔尼就近日引发技术圈广泛关注的Claude Code源代码泄露事件正式回应,确认本次泄露并非黑客攻击,而是产品部署环节未混淆MAP调试文件被误打包的人为失误所致,目前Anthropic已启动版权清理,后续将升级部署自动化流程降低操作风险。

本次泄露事件最早在海外开发者社区Hacker News曝光,流出的文件包很快在GitHub等代码平台扩散,不少资深代码开发者测试后确认,这份文件包含Claude Code核心推理逻辑、模块调用规则、接口加密规则等核心机密信息,几乎相当于将这款闭源代码大模型的内部架构完全“裸奔”在公众面前,相关话题24小时内的全网讨论量突破12万次。

针对外界关于“黑客攻击窃取核心资产”的猜测,鲍里斯·切尔尼在官方博客的回应中直接澄清,本次事故与外部攻击完全无关,完全是内部部署团队的操作疏漏导致。

据其披露,本次泄露的核心载体是未做混淆处理的MAP调试文件:这类文件是开发阶段用于排查代码错误的辅助文件,包含完整的源码映射关系,按照Anthropic的上线规范,生产环境的安装包必须删除并混淆所有调试文件,但本次部署时团队的校验环节出现疏漏,直接将包含MAP文件的测试包推送至了公开下载节点。

事故发生后,Anthropic的安全团队在3小时内就完成了公开节点的包替换,同时向GitHub、GitLab等所有主流代码托管平台发送了DMCA版权下架通知,截至4月1日晚,公开渠道可检索到的泄露文件已基本被清理。

鲍里斯同时坦言,本次事故暴露出Anthropic部署流程的核心短板:目前公司大模型产品的上线部署环节自动化率仅为68%,包括敏感文件校验在内的多个关键节点仍依赖人工二次核对,本次失误正是校验人员临时换班导致的遗漏。目前Anthropic已经成立了专项小组,计划在3个月内将部署流程的自动化率提升至95%以上,从根源上降低人为操作的风险。

作为仅次于OpenAI的全球第二大闭源大模型厂商,Anthropic的本次事故也给整个AI行业敲响了警钟。

此前业内对大模型安全的关注大多集中在训练数据合规、输出内容风险、算法对抗等层面,往往忽略了运维、部署等“偏后端”环节的风险。有安全专家指出,随着大模型产品的迭代速度越来越快,不少厂商为了赶上线节奏压缩运维校验流程,类似的疏漏未来很可能会频繁出现,只有把安全校验嵌入从训练到上线的全链路,才能真正避免核心资产泄露的风险。

9 小时前

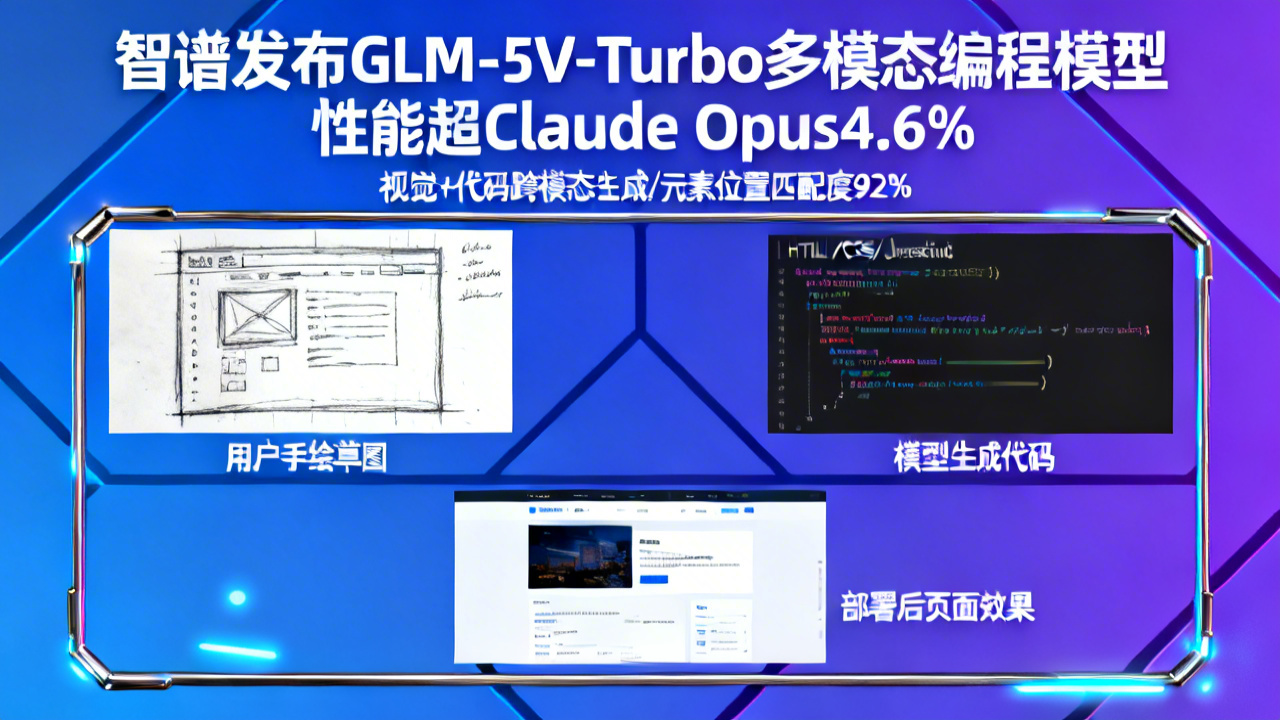

2026年4月2日,国产大模型厂商智谱正式发布旗下首个多模态Coding基座模型GLM-5V-Turbo,该模型具备“视觉+代码”跨模态生成能力,可基于草图、UI设计稿直接生成可运行前端工程,实测视觉编程性能较Claude Opus高出4.6%,是智谱在GLM-5-Turbo之后推出的又一编程类大模型迭代产品。

11 小时前

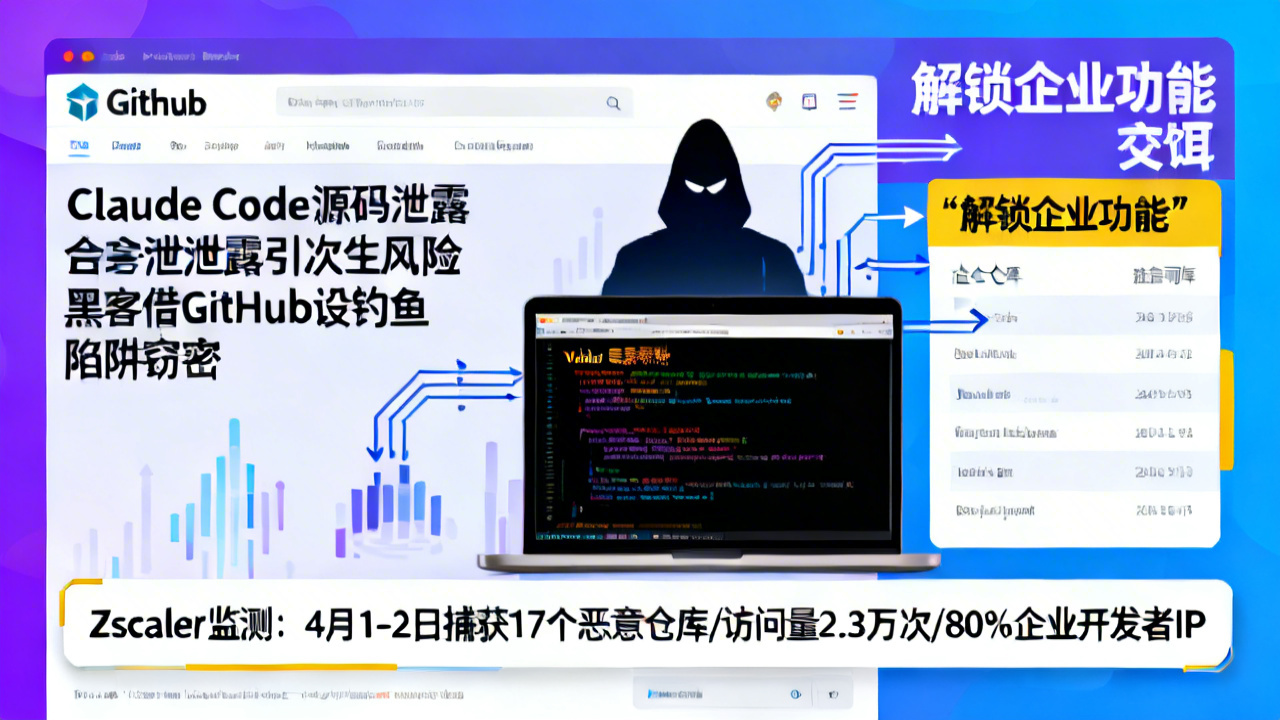

2026年4月,Anthropic因人为操作失误引发的Claude Code源码泄露事件持续发酵。安全厂商Zscaler监测发现,黑客借该热点在GitHub搭建多个虚假仓库,以“解锁企业功能”的泄露版源码为诱饵传播Vidar信息窃取恶意软件,且恶意仓库经SEO优化位居相关关键词搜索结果前列,大量开发者面临窃密风险。

11 小时前

2026年4月,Anthropic旗下AI终端编码工具Claude Code因人为操作失误泄露51.3万行前端源码,引发严重次生安全危机。黑客在GitHub搭建大量虚假代码仓库,以“解锁版”“完整泄露版”源码为诱饵诱导开发者下载,活跃攻击者idbzoomh传播的恶意程序内嵌Vidar木马,可窃取账号密码、加密货币钱包等核心隐私,目前安全机构已介入监测。

1 天前

2026年4月2日,阿里巴巴正式发布新一代大语言模型千问3.6-Plus。该模型配备100万token长上下文窗口,在多项权威编程评测中位居国产模型首位,整体编程能力接近全球标杆Claude系列,可自主完成前端开发、复杂仓库任务、设计稿转网页等需求,被业内称为当前最强国产编程大模型。

1 天前

2026年4月2日,AI大模型厂商Anthropic被曝正为旗下核心产品Claude开发代号为“龙虾”的常驻智能代理Conway。该产品支持独立工作UI、Webhook事件唤醒、浏览器直接操作与代码执行能力,还将推出CNW ZIP自定义扩展标准,开放开发者生态,打破传统AI聊天框的交互局限。

1 天前

2026年4月,全球AI二级交易市场出现明显分化:曾经一券难求的OpenAI现有6亿美元待售股权无人接盘,其直接竞争对手、主打Claude系列大模型的Anthropic却获得资本市场热捧,买方市场已积压约20亿美元资金等待入场。这一估值倒挂现象,折射出通用人工智能赛道的投资逻辑正在发生深层转向。

1 天前

2026年4月,AI头部企业Anthropic在处理旗下代码生成工具Claude Code的源码泄露事件时,因自动监测下架工具规则设置失误,导致GitHub平台上数千个与侵权无关的合法代码仓库被错误删除,大量无辜开发者权益受损,该事件引发开源社区对企业版权清理操作合规性的广泛质疑。

1 天前

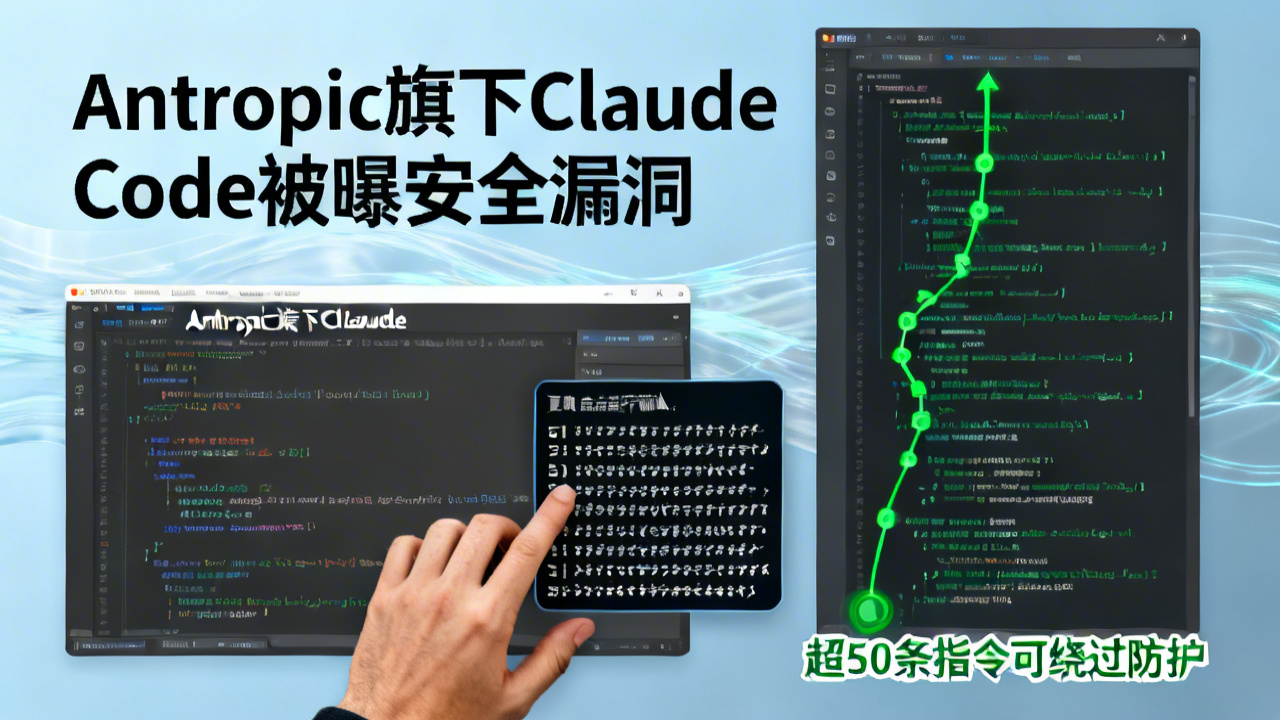

2026年4月,以色列安全厂商Adversa披露AI巨头Anthropic旗下代码开发工具Claude Code存在严重安全漏洞:因代码硬编码“最大安全检查子命令数”上限为50,攻击者只需构造超过该数量的超长指令链即可绕过内置安全拦截规则,诱导开发者执行高风险操作,当前该漏洞已引发AI开发工具安全领域的广泛关注。