量子计算厂商Multiverse Computing近日面向主流市场推出AI大模型压缩商用方案,已完成对OpenAI、Meta、DeepSeek、Mistral AI等头部厂商主流大模型的轻量化改造,同步上线的演示应用与开放API可让各类开发者低成本调用高压缩比、低算力需求的大模型能力,大幅降低大模型落地门槛。

此次Multiverse推出的压缩方案可将原有大模型的体积压缩至原有的1/10至1/20,推理过程中的算力需求下降80%以上,而输出质量的损失控制在5%以内,这一参数表现已经达到当前大模型压缩领域的第一梯队水平。

过去两年大模型技术迭代速度不断加快,但商用落地的成本门槛始终居高不下。对于中小开发者而言,调用头部厂商的大模型API每年的成本可达数万至数十万元,而如果选择本地化部署70B参数级别的大模型,仅前期硬件投入就需要超过30万元,且后续的运维、算力成本也持续高企,大部分下沉场景的需求难以被满足。

此前市面上的大模型压缩方案大多存在两大短板:要么压缩比提升的同时性能损失过大,无法满足实际商用需求;要么仅适配单一厂商的模型底座,开发者需要针对不同模型重复做适配工作,反而增加了开发成本。

Multiverse原本是一家聚焦量子算法研发的科技公司,此前已经在金融、工业等领域的复杂优化问题上积累了大量算法经验,此次推出的大模型压缩方案正是其量子启发算法在AI领域的落地应用。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

10 小时前

近期微软确认将加大自研AI模型投入,打破此前AI产品线核心能力主要依赖OpenAI技术的合作模式,旗下AI助手Copilot、Azure云AI服务将逐步接入自研大模型,与OpenAI GPT系列、谷歌Gemini系列形成直接竞争。本次自研模型覆盖通用对话、代码生成、多模态处理等场景,预计2025年上半年完成核心产品线适配。

1 天前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。

1 天前

2026年4月,人工智能头部企业OpenAI官宣最新一轮高管架构调整:首席运营官布拉德·莱特卡普(Brad Lightcap)将卸任原有职务,转任公司内部全新设立的“特殊项目”部门负责人;首席营销官凯特·劳奇(Kate Rouch)因癌症治疗将暂时离岗,待身体康复后回归。本轮调整是OpenAI 2026年首次公开的核心管理层变动,引发行业对其新业务布局的广泛关注。

1 天前

TechCrunch于2026年4月发布的最新民调显示,超62%的美国受访居民更支持社区周边新建亚马逊仓储设施,而非AI算力数据中心。当前AI大模型爆发带动全球算力需求年增速超80%,数据中心邻避效应已成为算力基建扩张的核心阻碍,该议题也将成为4月30日举办的StrictlyVC 2026旧金山峰会的核心讨论方向。

1 天前

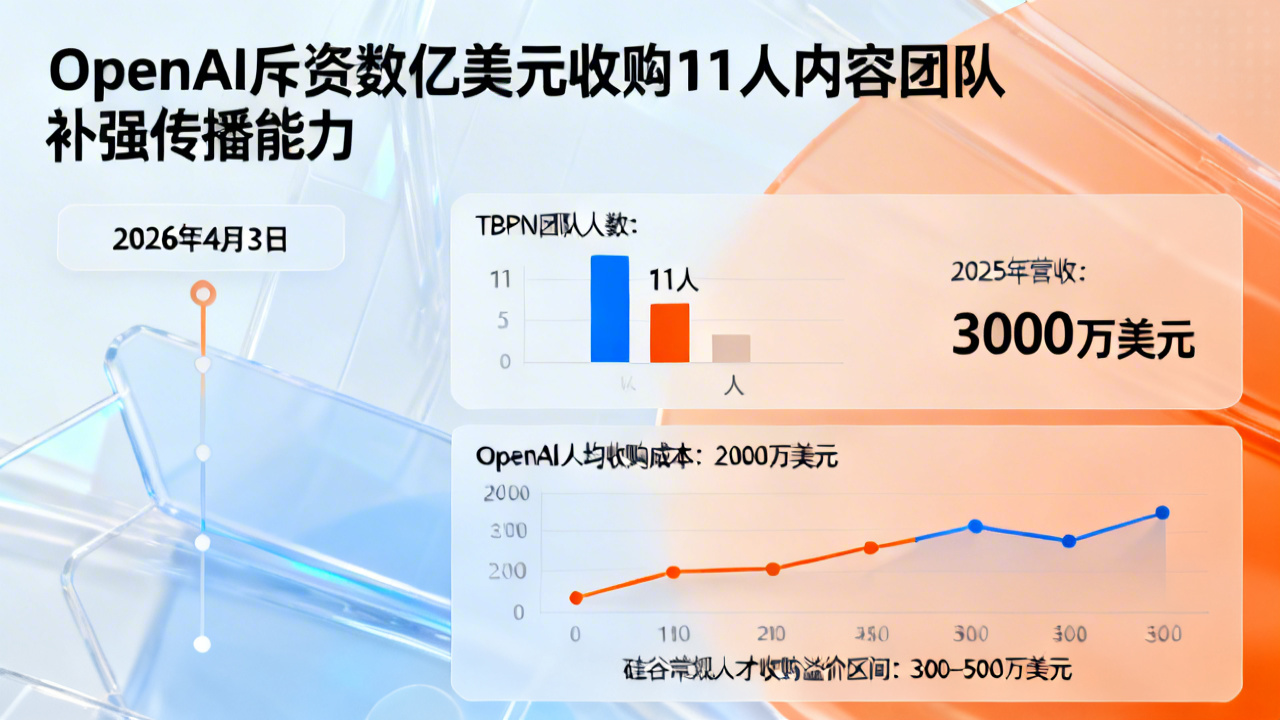

2026年4月3日,全球人工智能头部企业OpenAI宣布完成对美国科技访谈节目运营商TBPN的收购。据英国《金融时报》知情人士披露,本次收购对价达小几亿美元,标的团队仅11人,2025年全年营收达3000万美元。本次交易是OpenAI强化对外传播能力、重塑公众叙事体系的核心战略布局,也是2026年开年以来AI领域金额最高的内容生态类收购案。

1 天前

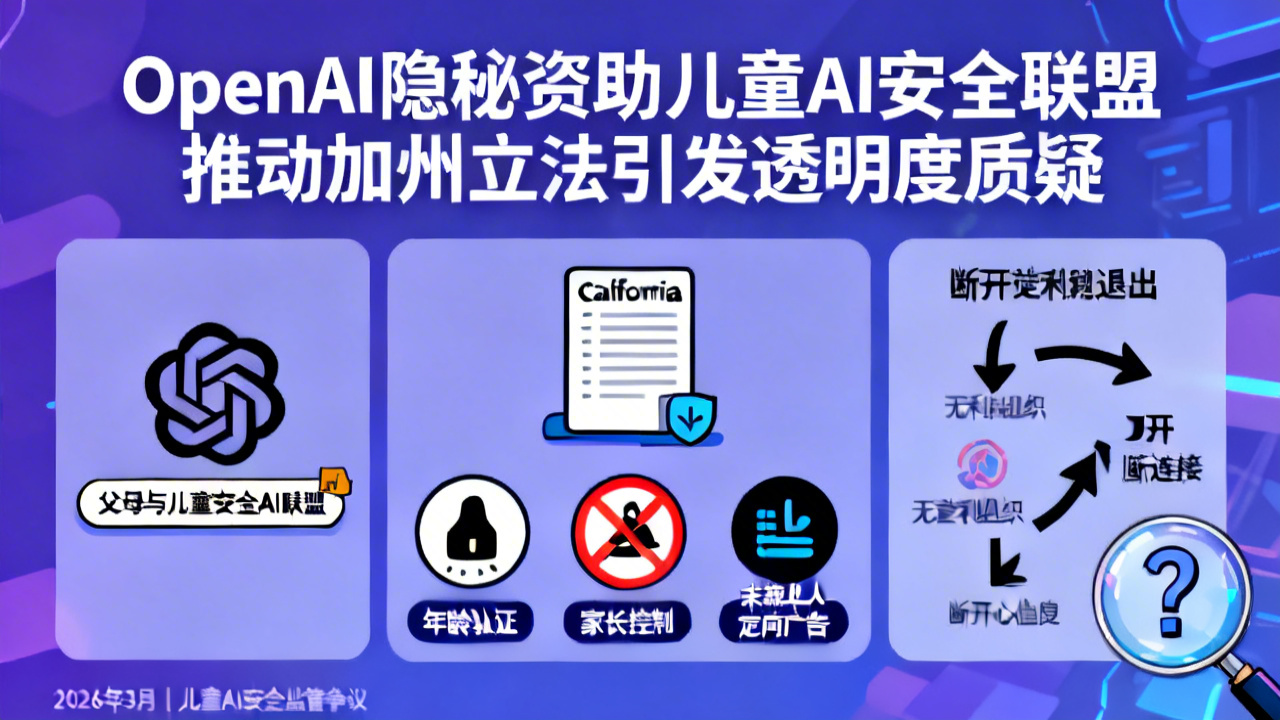

2026年3月,头部AI企业OpenAI隐秘资助成立“父母与儿童安全AI联盟”,推动加州出台儿童AI安全领域立法,倡导年龄验证、家长控制、禁止未成年人定向AI广告等监管规则,全程未公开其出资方身份,目前已有多家此前加入的儿童安全非营利组织因信息不透明选择退出,引发行业对AI企业干预监管立法透明度的广泛讨论。

2 天前

近期微软调整旗下AI业务核心战略,从此前依赖OpenAI GPT系列技术支撑Copilot等智能产品,转向投入超110亿美元搭建自研大模型团队,目标在2025年底前推出完全自主可控的通用AI底座,替代现有外采技术方案,相关调整已覆盖云计算、办公AI、消费级智能助手三大核心业务线。

2 天前

2026年4月披露的最新规划显示,微软正全面推进AI自主化战略转型,计划2027年推出自研尖端多模态大模型,实现文本、图像、音频处理能力全行业领先,直接对标OpenAI、Anthropic等头部厂商。为支撑该计划,微软已启动英伟达GB200芯片集群部署,未来12-18个月算力将大幅提升,同时仍将维持多元化AI生态布局。