当地时间2026年3月9日,人工智能初创公司Anthropic正式向加州联邦地区法院提起诉讼,反对特朗普政府将其旗下大语言模型Claude列入国防供应链黑名单。此前Claude曾是唯一获准接入五角大楼机密网络的AI模型,本次双方从深度合作转向对簿公堂,直接暴露了AI军事应用与伦理边界的核心矛盾,也引发全球AI行业对技术落地底线的广泛讨论。

在五角大楼的供应链管控体系中,“供应链风险”的标签过去只被贴给被美国视为对手的外国企业,从未有过本土科技公司被列入该清单的先例——直到Anthropic成了第一个吃螃蟹的对象。

就在起诉前一个月,Anthropic还是美国国防部联合全域指挥控制(JADC2)项目的核心合作方,其自研的Claude系列大模型是唯一通过五角大楼涉密安全评估、获准接入军方机密网络的通用大模型,甚至曾被用于协助推演特定区域高价值目标的打击方案,是美国军方AI落地的标杆性合作案例。

双方的蜜月期在2026年2月的合同续签谈判中彻底破裂。上周四美国国防部正式公示的供应链风险清单中,Anthropic赫然在列,这意味着所有承接美国国防项目的承包商,都必须出具未使用Claude相关技术的证明,否则将失去参与军方项目的资格。

根据Anthropic向法院提交的诉讼文件显示,双方的矛盾核心来自五角大楼对Claude的功能修改要求:军方希望Anthropic调整其宪法AI伦理框架,放宽对军事用途的限制,允许Claude接入实时战场数据,直接辅助火力分配、目标判定等作战决策,而这一要求直接越过了Anthropic成立之初设定的“不开发杀伤性武器相关技术”的核心红线。

值得注意的是,本次美国政府给Anthropic贴上的“供应链风险”标签,此前从未适用于美国本土企业,通常只用来制裁被美国认定存在安全威胁的境外实体。Anthropic在诉讼中表示,该认定没有任何事实依据,是对企业自主选择权的恶意侵犯。

本次诉讼并不是AI行业第一次与军事用途需求产生冲突,此前OpenAI、DeepMind等头部AI企业都曾因员工抗议,终止过部分与军方合作的武器相关研发项目,但Anthropic是首个选择以法律诉讼的方式公开对抗美国政府相关要求的主流AI厂商。

有行业分析师指出,本次诉讼的结果将直接影响美国AI行业的发展走向:如果Anthropic胜诉,将为所有AI企业争取到拒绝不合理军事用途要求的法律先例;如果败诉,未来美国AI厂商可能将被迫向军方开放核心技术能力,而这也会进一步加剧全球对AI技术军备化的担忧。

目前欧洲已经在《人工智能法案》中明确划定了自主杀伤性AI武器的禁令,而美国联邦层面至今尚未出台统一的AI军事应用监管规则,本次事件也被视为倒逼美国相关立法加速落地的关键节点。

1 小时前

2026年4月,AI大模型研发商Anthropic在清理平台上泄露的自家源代码过程中出现操作失误,提交的下架申请误伤数千个无关GitHub开源仓库。Anthropic高管随后公开承认事故为人为操作导致,已第一时间撤销绝大多数不当下架通知,目前GitHub已逐步恢复所有被误下架仓库的正常访问权限。

4 小时前

国内大模型厂商智谱日前发布2025年全年业绩公告,全年营收达7.24亿元,同比增长131.9%,经调整净亏损31.82亿元,同比扩大29.1%。其最新推出的GLM-5发布24小时内即获字节、阿里、腾讯等头部大厂接入,国内前10大互联网公司已有9家深度集成GLM系列模型,旗下GLM Coding Plan付费开发者规模突破24.2万。

11 小时前

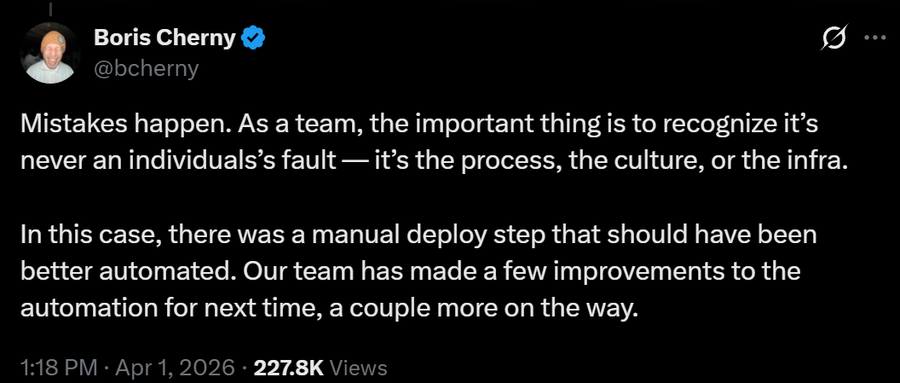

2026年4月,AI创企Anthropic旗下闭源编程工具Claude Code意外泄露引发行业震荡,项目负责人鲍里斯·切尔尼公开承认团队手动操作部署流程失误导致事故,第三方基于泄露代码推出的平替版本上线后短时间内便斩获GitHub 10万星,Anthropic随后紧急启动下架封杀措施,此次事件也引发行业对闭源AI项目安全管控的广泛讨论。

13 小时前

近日,科技公司Meta公布了一项针对大语言模型(LLM)代码审查场景的技术优化方案,其核心的半形式化推理方法通过结构化提示词约束模型追踪代码路径、论证结论合理性,在实现代码审查准确率提升超五成的同时,算力开销可降低超80%,大幅减少企业对高成本代码执行测试环境的依赖,为工业级LLM代码应用落地提供了新路径。

13 小时前

2026年4月1日,全球头部AI实验室Anthropic核心开发者鲍里斯·切尔尼就近日引发技术圈广泛关注的Claude Code源代码泄露事件正式回应,确认本次泄露并非黑客攻击,而是产品部署环节未混淆MAP调试文件被误打包的人为失误所致,目前Anthropic已启动版权清理,后续将升级部署自动化流程降低操作风险。

14 小时前

2026年4月以来,基于大语言模型的AI文游在国内社交平台快速走红,普通用户可通过灵光App等零代码AI助手,以自然语言对话方式生成个性化文字游戏,部分创作者将成品以9.9元至30元的价格出售变现。这类轻量内容产品兼具高定制性与情感价值,不仅满足Z世代创作需求,也成为情绪经济的全新载体,推动内容创业逻辑发生转变。

16 小时前

2026年4月,AI企业Anthropic针对旗下代码大模型Claude Code的源代码泄露事件正式发起法律维权,向代码托管平台GitHub提交多份DMCA下架通知,后者已清理涉事主仓库及超8100个相关Fork分支,系近年AI行业规模最大的代码版权清理行动。经调查,本次泄露并非员工操作失误,而是Anthropic内部打包工具底层BUG所致。

17 小时前

2026年4月1日,在上海浦江AI学术年会上,阿里巴巴联合上海人工智能实验室正式发布《守己利他:智能时代做负责任的技术》AI安全白皮书。本次发布聚焦AI从对话交互向可自主执行任务的智能体升级的产业节点,深度剖析当前智能体普及的安全隐患,提出兼顾技术自律与行业协同的治理中国方案,为全球AI安全治理提供可落地的参考路径。