极佳视界推出GigaBrain-0.5M VLA模型 突破具身智能长时程瓶颈

曾让具身智能折戟的长时程琐碎任务,如今迎来全新突破口。曾在RoboChallenge拿下全球第一的GigaBrain系列模型,日前推出进化体GigaBrain-0.5M*VLA大模型。该模型凭借世界模型条件驱动与“人在回路”持续学习机制,在叠衣服、冲咖啡等复杂长时程任务中实现数小时零失误,成功率逼近100%,一举突破具身智能此前的性能天花板。

叠衣服要对齐衣边、调整褶皱,冲咖啡需精准控制水量与水温,折纸盒要按顺序压痕成型——这些看似简单的日常任务,却曾是具身智能领域难以跨越的“长时程”鸿沟。此前的具身智能模型,往往在这类需要多步骤连贯决策、持续感知环境变化的任务中,因中间某一环节的微小偏差导致整体失败,长时程任务成功率始终低迷,成为制约具身智能落地家用服务、工业流水线等场景的核心障碍。

而极佳视界最新推出的GigaBrain-0.5M*VLA大模型,正是瞄准这一痛点而来。作为曾斩获RoboChallenge全球冠军的GigaBrain-0.1的进化体,这款新模型在性能上实现了质的飞跃。其核心突破在于两大技术架构:首先是世界模型条件驱动机制,模型不再仅依赖当下的环境感知输入,而是通过内置的世界模型预判未来动作的状态与价值,将这些预测结果作为决策的核心依据。比如在执行冲咖啡任务时,模型会提前预判倒水角度对水流的影响、水温变化对咖啡萃取的效果,据此实时调整动作幅度,从根源上降低失误概率,大幅提升长时程任务的鲁棒性。

其次是创新引入的“人在回路”持续学习机制,打破了传统具身智能模型“训练完成即定型”的局限。系统会收集模型在真实环境中的推演轨迹,经人工筛选校正后重新用于迭代训练,让模型基于真实交互反馈不断优化决策策略,形成“行动—反思—进化”的完整闭环。这种持续学习模式,使得模型能在一次次任务中自我修正,逐步适应不同环境下的任务需求,最终实现数小时零失误的稳定运行。

在与主流具身智能方法RECAP的直接对比测试中,GigaBrain-0.5MVLA的优势尽显:它将复杂长时程任务的成功率直接拉升至近100%,而RECAP在同类任务中的表现与之差距显著。这一数据意味着,具身智能终于能够摆脱“实验室演示”的

从家用服务机器人代替人类完成日常家务,到工业机器人执行复杂的流水线组装任务,再到养老陪护机器人提供长时间的辅助服务,GigaBrain-0.5MVLA的出现,为具身智能的落地应用打开了新的想象空间。业内专家认为,这款模型的技术突破,不仅刷新了具身智能的长时程任务纪录,更推动整个行业向“通用化、实用化”的方向迈进一步。

随着具身智能技术的不断迭代,我们或许不用等待太久,就能看到真正能“走进生活”的机器人——它们能精准完成每一项琐碎家务,持续稳定地提供服务,成为人类生活中可靠的帮手。

5 小时前

2026年4月1日消息,高德正式全量开源全球首个基于统一架构的具身操作基座模型ABot-M0。该模型可作为“通用大脑”适配多种形态的具身机器人,在Libero、Libero-Plus等多个权威基准测试中达到SOTA表现,其中在Libero-Plus基准上任务成功率达80.5%,较此前业界标杆方案Pi0提升近30%。

6 小时前

2026年3月31日,谷歌DeepMind正式推出旗下目前定价最亲民的AI视频生成模型Veo 3.1 Lite。该模型生成速度与此前发布的Veo 3.1 Fast版本持平,生成成本不到后者的一半,720P分辨率视频生成成本低至每秒0.05美元,支持文生视频、图生视频两大核心功能,大幅降低了AI视频创作的准入门槛。

6 小时前

2026年4月1日,阿里巴巴正式推出图像生成与编辑统一模型Wan2.7-Image,针对当前AI生图领域普遍存在的审美疲劳、标准脸同质化、色彩失控等行业痛点,该模型主打高「活人感」人物生成能力,支持精准色彩调控、3K token超长文本渲染三大核心升级,可实现千人千面的生成效果,大幅提升生图内容的商用适配性。

15 小时前

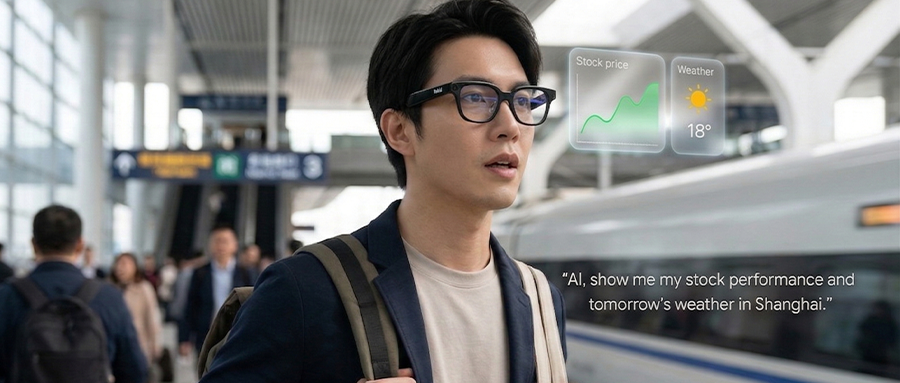

2026年4月,AR科技公司Rokid的AIUI相关演示内容引发科技行业广泛热议。当前全球大模型迭代进入月更周更的竞速阶段,此前OpenClaw的爆火已推开AI大众化的大门,但应用层落地始终滞后于算力与模型技术发展,AIUI作为替代传统GUI图形交互的新方案,被视为AI眼镜终端迎来“iPhone时刻”的核心抓手。

17 小时前

2026年4月1日,高德正式全量开源全球首个统一架构机器人具身操作基座模型ABot-M0,该模型旨在以“一个通用大脑适配多形态机器人”,打破异构硬件壁垒。其在Libero-Plus基准测试中任务成功率达80.5%,较此前行业标杆Pi0提升近30%,同时开源覆盖数据、算法、预训练模型三大维度,推动具身智能落地提速。

18 小时前

2026年4月1日,阿里正式推出图像生成与编辑统一大模型Wan2.7-Image,该模型突破传统AI生图同质化、指令对齐难的行业痛点,支持从骨相到五官细节的像素级捏脸,搭载调色盘风格迁移功能,最高支持3K token文本输入,可稳定输出含公式、表格的印刷级图文内容,大幅提升了AI生图的个性化程度与专业场景适配能力。

21 小时前

法国大模型独角兽Mistral AI于2026年3月末宣布完成8.3亿美元(约合57.5亿元人民币)债务融资,这是该公司首次开展债务融资,所得资金将主要用于巴黎旗舰数据中心建设,计划采购部署1.38万块英伟达GB系列GPU。目前Mistral AI多轮股权融资后估值已达约117亿欧元(约合930.5亿元人民币),是欧洲估值最高的AI初创企业。

1 天前

国产AI企业DeepSeek旗下服务于2026年3月29日至31日连续三天出现异常波动,网页端、移动端App及API接口均出现连接中断或响应延迟,三次故障时长分别为1小时48分、10小时13分、1小时3分,其中30日超10小时大规模宕机对开发者生态及企业级应用影响显著。目前服务已全面修复,事件引发业界对大模型基础设施承压能力的深度思考。