Anthropic旗下AI编程工具Claude Code近期遭遇大量企业开发者质疑,GitHub社区反馈及第三方调研数据显示,近6成受访企业开发人员称其在调试、多文件系统级任务中的完成准确率较3个月前下降超20%,无法满足中大型项目的工程化需求,引发行业对生成式AI编程工具落地稳定性的广泛讨论。

某头部SaaS企业后端开发工程师李明最近彻底把Claude Code从自己的常用工具列表里移除了。上周他尝试用该工具协助排查一个跨6个微服务的接口超时问题,先后输出的7套排查方案里有5套存在明显逻辑漏洞,剩下2套完全忽略了系统底层的旧版依赖限制,最终他花了比手动排查多两倍的时间才解决问题。

随着生成式AI技术的成熟,AI编程工具已经从开发者的“尝鲜玩具”转向企业研发流程中的标配工具。Gartner此前发布的报告显示,2024年全球将有近70%的科技企业在开发流程中引入生成式AI编码工具,其中Anthropic推出的Claude Code凭借超长上下文窗口的优势,一度成为仅次于GitHub Copilot的第二大热门企业级AI编程工具,尤其受需要处理多文件复杂项目的后端工程师、架构师欢迎。

但近期大量用户反馈显示,Claude Code在复杂工程场景的表现出现了明显滑坡。GitHub平台上与Claude Code输出准确性相关的issue数量近3个月增长了170%,用户吐槽的问题集中在两大场景:一是复杂bug调试,尤其是涉及底层依赖、跨模块联动的问题,工具经常生成看似逻辑自洽但实际无法运行的代码;二是多文件系统级的重构、开发任务,频繁出现上下文遗漏问题,比如修改了A模块的核心逻辑,却忘了同步调整B、C模块的对应配置,反而给开发者带来额外的校验成本。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

8 小时前

2026年4月,全球顶级唱片公司与AI音乐初创企业Suno针对AI生成音乐的版权许可框架谈判宣告陷入僵局,双方就授权模式、艺术家权益保障方案等核心条款存在根本性分歧,目前暂无可行的折中路径。此次谈判破裂也折射出AI音乐商业化进程中,内容版权规则滞后于技术迭代的行业共性痛点。

14 小时前

2026年4月,美国科技公司Meta宣布拟举债30亿美元,在俄亥俄州新奥尔巴尼打造算力规模达1吉瓦的AI专用数据中心Prometheus。该项目供电能力相当于一座小型核电站,可覆盖100万户家庭的用电需求,融资利率较担保隔夜融资利率(SOFR)高出2.5个百分点,是Meta近年布局AI算力基础设施的最大手笔之一。

15 小时前

AI企业Anthropic于2026年4月披露其年化收入已正式突破300亿美元,较2025年底的90亿美元实现超2倍增长。旗下Claude系列AI服务企业级需求爆发,目前已有超1000家企业客户年均消费超100万美元,该占比自2026年2月以来实现翻倍。为支撑业务高速扩张,Anthropic已确认联合谷歌、博通展开深度算力合作。

15 小时前

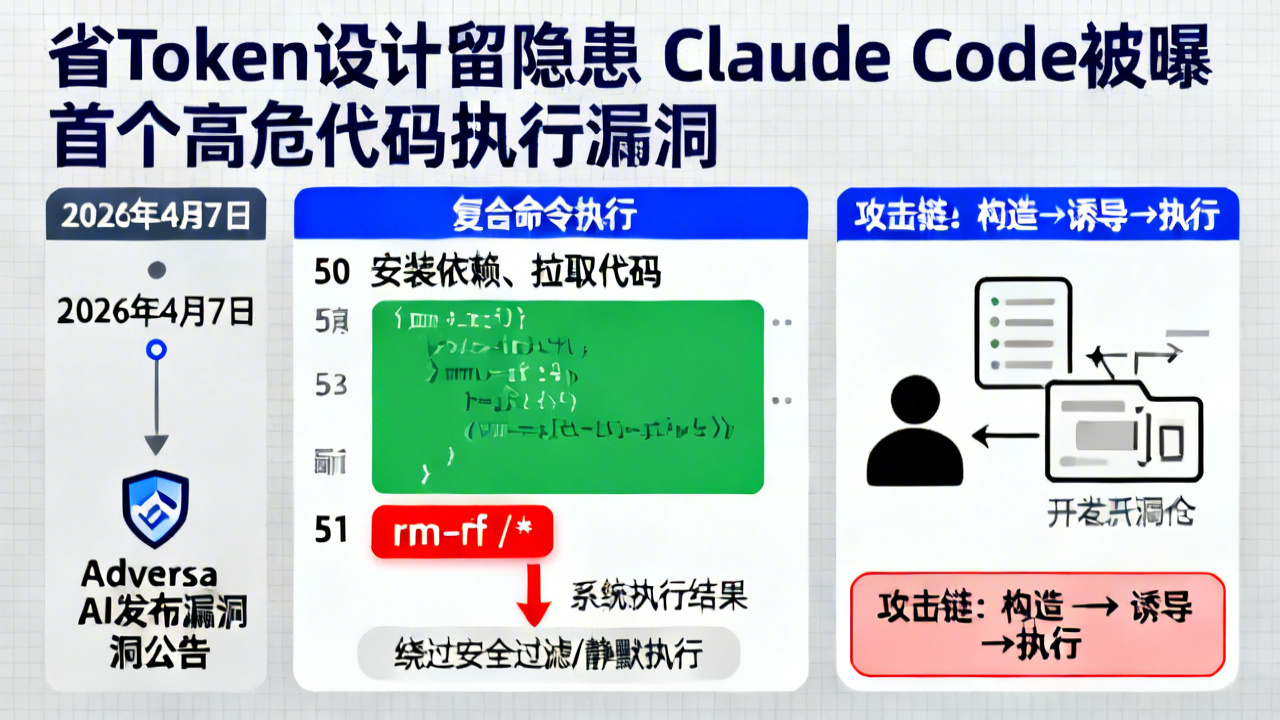

2026年4月7日,安全研究机构Adversa AI发布公告称,在Anthropic旗下AI编程助手Claude Code此前意外泄露的源代码中,发现首个高危代码执行漏洞:当工具处理超过50条子命令的复合命令时,会自动绕过所有内置安全过滤规则,第51条及之后的恶意代码可静默执行,攻击者可通过构造恶意开源仓库诱导开发者操作完成攻击。

19 小时前

微软旗下开源代码编辑器Visual Studio Code于近期推送1.114正式版本更新,针对内置的GitHub Copilot AI功能完成多项体验升级,包括为AI聊天上下文菜单新增「复制最终回复」命令、简化Copilot跨代码库检索流程,同时新增图片轮播组件的视频预览能力,进一步降低开发者调用AI辅助编程的操作成本。

23 小时前

2026年4月,MIT Technology Review刊发行业报道,经济学家公开呼吁全球启动类“曼哈顿计划”的跨学科专项研究,破解当前AI渗透职场过程中就业影响数据零散、口径不统一的行业痛点,填补大语言模型、生成式AI等技术落地过程中的就业评估空白,为政策制定、企业用工调整、从业者职业规划提供可落地的量化参考依据。

1 天前

当前生成式AI落地进入深水区,大量企业面临大语言模型(LLM)选型难题,本次梳理的27项核心评估维度,覆盖部署成本、推理性能、场景适配能力、合规性等多个层面,适用于OpenAI、Anthropic、国内厂商等推出的各类LLM产品,可帮助企业快速筛选匹配需求的模型,降低试错成本。

1 天前

近日AI企业Anthropic宣布调整旗下大模型产品Claude的订阅权益,正式取消订阅用户原有的OpenClaw工具访问权限,为降低用户迁移影响将向受影响用户发放专属使用积分补偿。OpenClaw联合开发者透露其曾多方沟通将本次调整落地时间延后一周,本次调整已引发订阅用户关于使用成本升高、市场竞争受限的普遍质疑。