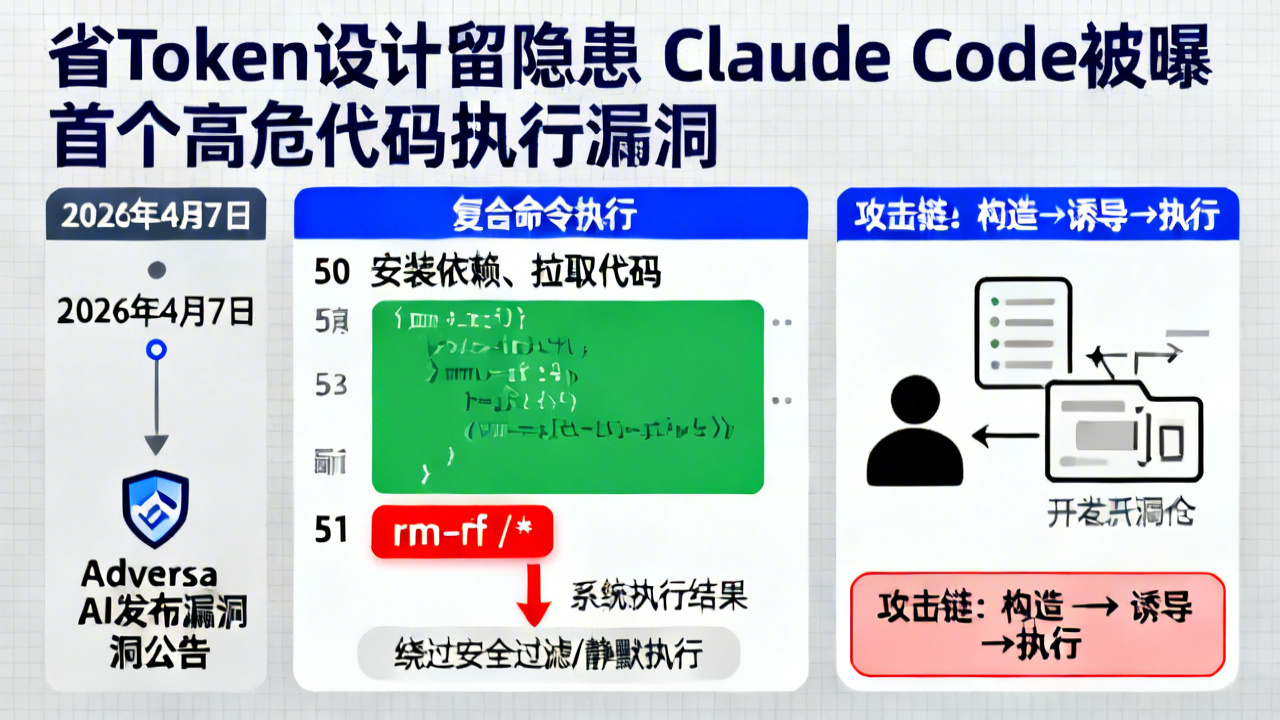

2026年4月7日,安全研究机构Adversa AI发布公告称,在Anthropic旗下AI编程助手Claude Code此前意外泄露的源代码中,发现首个高危代码执行漏洞:当工具处理超过50条子命令的复合命令时,会自动绕过所有内置安全过滤规则,第51条及之后的恶意代码可静默执行,攻击者可通过构造恶意开源仓库诱导开发者操作完成攻击。

图源: 图像由AI生成

图源: 图像由AI生成Adversa AI在漏洞报告中披露了完整的复现流程:研究人员构造了一串由51条子命令拼接而成的复合指令,前50条均为安装依赖、拉取代码等正常操作,第51条则写入了清除本地磁盘的高危指令`rm -rf /*`,将这串指令输入Claude Code后,系统完全没有触发安全告警,直接执行了全部命令。

作为Anthropic旗下增长最快的AI编程工具,Claude Code原本内置了完善的命令安全校验机制,默认禁止执行curl、rm等可能造成数据泄露或系统损坏的高危指令。而此次漏洞的根源,是研发团队**为降低推理阶段的Token消耗,给命令审查环节设置了最高50条的截断规则**,超过阈值的子命令会直接跳过校验进入执行环节,相当于主动给恶意代码开了“绿灯”。

目前官方披露的可行攻击路径已得到验证:攻击者只需在开源仓库中植入带有长复合命令的CLAUDE.md文件,诱导使用Claude Code的开发者拉取仓库并执行AI推荐的操作,即可在用户无感知的情况下执行恶意代码,窃取本地密钥、销毁代码库等攻击均可轻松实现。

此次Claude Code的漏洞并非个例,而是当前AI生产力工具普遍存在的安全问题的缩影。随着大模型应用的规模化落地,厂商的算力成本压力持续上涨,不少团队都会通过上下文截断、低秩推理、跳过非核心校验等方式压缩Token消耗,而安全环节往往是最先被“优化”的部分。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

2 小时前

2026年4月,全球估值居前的AI初创企业Anthropic被曝正推进深度洽谈,计划出资2亿美元参与设立全新私募股权基金,完成从此前一级市场“吸金王”到产业出资人的角色转换。该动作是AI头部企业首次以基石LP身份切入一级市场投资赛道,将撬动更多社会资本流向AI前沿领域,强化自身在AGI演进路径中的话语权。

2 小时前

AI企业Anthropic于2026年4月披露其年化收入已正式突破300亿美元,较2025年底的90亿美元实现超2倍增长。旗下Claude系列AI服务企业级需求爆发,目前已有超1000家企业客户年均消费超100万美元,该占比自2026年2月以来实现翻倍。为支撑业务高速扩张,Anthropic已确认联合谷歌、博通展开深度算力合作。

6 小时前

微软旗下开源代码编辑器Visual Studio Code于近期推送1.114正式版本更新,针对内置的GitHub Copilot AI功能完成多项体验升级,包括为AI聊天上下文菜单新增「复制最终回复」命令、简化Copilot跨代码库检索流程,同时新增图片轮播组件的视频预览能力,进一步降低开发者调用AI辅助编程的操作成本。

18 小时前

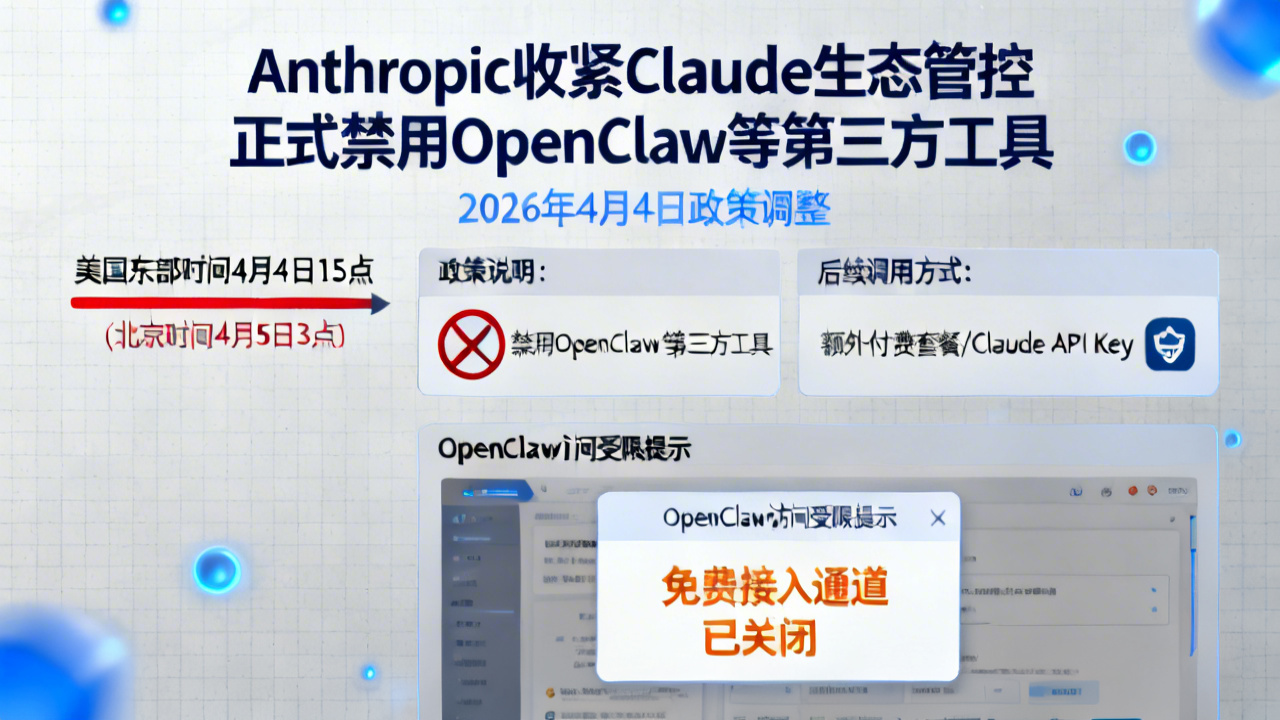

近日AI企业Anthropic宣布调整旗下大模型产品Claude的订阅权益,正式取消订阅用户原有的OpenClaw工具访问权限,为降低用户迁移影响将向受影响用户发放专属使用积分补偿。OpenClaw联合开发者透露其曾多方沟通将本次调整落地时间延后一周,本次调整已引发订阅用户关于使用成本升高、市场竞争受限的普遍质疑。

2 天前

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

3 天前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。

3 天前

2026年美国中期选举进入倒计时阶段,头部大模型企业Anthropic近日宣布成立全新政治行动委员会(PAC),计划定向支持认同其分级AI监管、算力资源倾斜、AIGC版权保护等政策议程的议员候选人。此次动作是头部AI企业从技术研发向政策上游延伸的标志性事件,也意味着全球AI行业的政策博弈进入白热化阶段。

3 天前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。