网站截图

网站截图

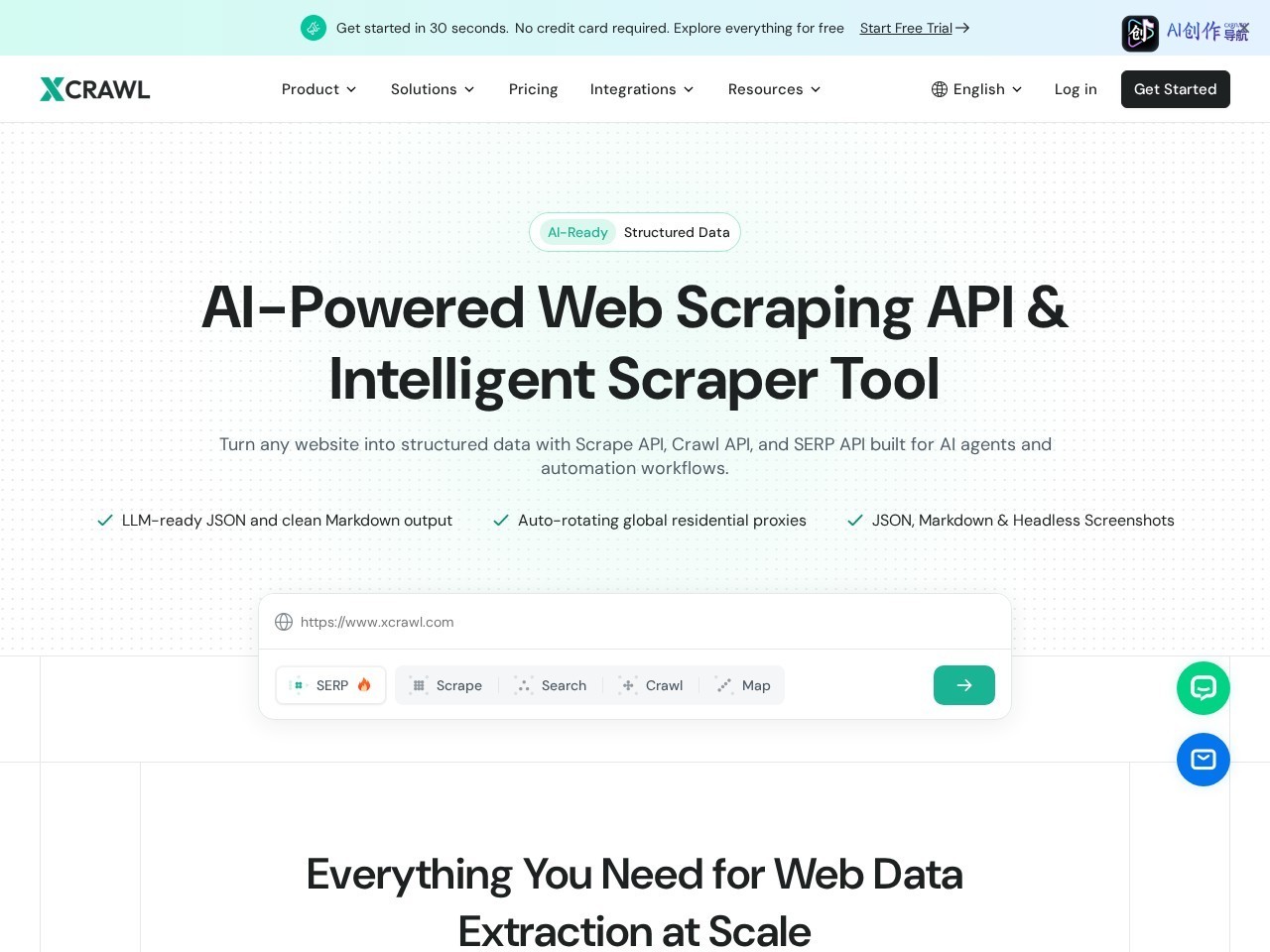

XCrawl是一款面向规模化网页数据提取需求的AI智能爬取API工具,核心定位为低代码、高可用的网页数据采集解决方案,内置代理、爬虫调度与自动化处理能力,无需用户自行搭建复杂爬虫框架,仅通过API调用即可快速获取规整的目标数据。相比传统自行开发的爬虫工具,它大幅降低了数据采集的技术门槛与运维成本,适配多场景的数据获取需求。

调用Scrape API采集电商商品页,可直接返回包含商品名称、价格、参数、评价的JSON格式数据,无冗余广告、页面标签等噪声信息;调用Search API采集谷歌搜索结果,可直接输出结构化SERP数据,包含排名、标题、链接、摘要字段,可直接用于SEO分析;调用Crawl API采集资讯站点全量内容,可按指定深度爬取全站文章,输出标准Markdown格式文稿,无需二次清洗。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

2 个月前

2026年3月,蚂蚁数科天玑实验室团队发布AoE持续性第一人称视频采集框架,推出仅需一台手机+低于20美元颈挂支架的轻量化具身数据采集方案,可替代数万美元专业设备。该技术依托华为云算力实现并发采集与云端自动化处理,实测可将机器人任务成功率从45%提升至95%,相关论文已发布于Arxiv。

2 个月前

2026年3月,蚂蚁数科天玑实验室发布AoE持续性第一人称视频采集框架,推出低成本具身数据采集方案:仅用一台手机搭配不足20美元的颈挂式支架,即可替代数万美元的专业采集设备。该技术支持数千台设备并发采集与云端自动化处理,实测引入200条数据后,机器人任务成功率从45%跃升至95%,相关论文已在Arxiv发布。

3 小时前

2026年5月,世界一级方程式锦标赛(F1)Scuderia Ferrari HP车队与科技巨头IBM达成技术合作,将基于IBM定制化AI交互系统重构赛事粉丝服务体系。双方已披露多套落地场景,预计可覆盖全球超2亿法拉利F1核心粉丝,将观赛互动转化率提升30%以上,同时为车队周边消费、会员运营提供全链路数据支撑。

4 小时前

近日,微软宣布调整Office套件的Copilot AI助手交互逻辑,新增悬浮Copilot按钮的手动关闭选项,解决了此前用户反馈的常驻悬浮键遮挡编辑区域、误触率高等问题。作为微软面向办公场景落地的核心AI工具,Copilot目前已覆盖Office全系列办公应用,全球付费企业用户规模已突破3000万,本次功能更新将进一步优化不同使用习惯用户的体验。

5 小时前

知名企业家埃隆·马斯克旗下人工智能公司xAI近期签订总金额超120亿美元的长期协议,全面转向天然气为AI算力供电,同时其执掌的SpaceX正加速推进轨道数据中心布局,二者动作均与马斯克早年提出的“全球太阳能电力经济”目标形成明显背离,引发行业对AI高能耗背景下能源选择逻辑的广泛讨论。

7 小时前

近日,AI开源研究机构Nous Research正式发布全新大模型调控技术对比神经元归因(Contrastive Neuron Attribution,简称CNA)。该技术无需进行稀疏自动编码器(SAE)训练,也不需要修改模型权重参数,仅通过消融稀疏MLP电路即可实现对大语言模型行为的精准控制,大幅降低了大模型对齐与功能定向修改的技术门槛与算力成本。

10 小时前

AI搜索企业Perplexity于近期宣布开源供应链安全工具Bumblebee,该工具基于Go语言开发,采用只读架构设计,可在不获取额外权限的前提下,精准扫描开发者端点的供应链包暴露风险,为全球开发团队防范软件供应链攻击提供了轻量化的开源解决方案,上线仅一周便获得GitHub超2000星的社区关注度。

18 小时前

2026年5月,谷歌面向全球全量用户推送搜索产品的AI功能迭代后,被曝出现罕见功能性漏洞:用户在搜索框输入英文关键词“disregard”检索时,会直接导致搜索界面加载失败、功能完全失效。该漏洞已在全球多个地区的PC端、移动端搜索场景复现,目前谷歌官方尚未作出公开回应,也未推送针对性修复补丁。