美国科技巨头谷歌于2026年3月25日正式公开全新AI内存压缩算法TurboQuant,该技术可将大模型运行所需的工作内存最高压缩至原有1/6,大幅降低AI推理及训练的硬件成本。因核心特性与HBO热播剧《硅谷》中虚构的Pied Piper压缩技术高度重合,该算法发布后迅速引发全球科技圈与网友讨论,目前仍处于实验室实验阶段。

TurboQuant相关论文公开仅3小时,X平台上#TurboQuant #PiedPiper两个相关话题的讨论量就突破了120万,不少《硅谷》的资深观众晒出剧中“魔笛手”公司的压缩技术介绍截图,调侃谷歌的研发团队“怕不是照着电视剧写的技术需求”。

作为HBO曾经的王牌剧集,《硅谷》中虚构的Pied Piper公司主打超高压缩比的无损压缩技术,设定中可以将任意数据压缩到原体积的几十分之一,一度被剧迷称为“最符合科技发展逻辑的科幻设定”。而此次谷歌发布的TurboQuant虽然针对的是AI运行时的工作内存,而非普通存储数据,但其“超高压缩比、极低精度损失”的核心特性,与剧中的Pied Piper技术几乎完全吻合,也因此引发了跨界的传播热度。

TurboQuant的发布,恰好踩中了当前AI行业的核心痛点。2025年全球AI服务器出货量同比增长127%,但高端显存的供应缺口仍高达38%,显存成本已经占到单台AI服务器总成本的42%,大模型运行的内存瓶颈已经成为制约AI普及的核心障碍。

谷歌官方给出的测试数据显示,针对70B参数级别的大语言模型,TurboQuant可以在推理精度损失不到0.8%的前提下,将运行所需的工作内存压缩6倍。这意味着原本需要80GB高端显存才能流畅运行的大模型,现在仅需13GB显存即可支持,几乎可以适配目前主流的消费级显卡。

尽管技术参数亮眼,但谷歌方面也明确表示,TurboQuant目前仍属于实验室阶段的研究成果,仅在Gemini 2、Llama 3等少数几款大模型上完成了验证,还没有解决多模态模型压缩、极端任务场景下的精度波动等问题。

谷歌研究院相关研发团队透露,TurboQuant的商业化落地至少还需要12-18个月的时间,后续会首先应用在谷歌自家的Gemini API服务中,率先降低云端推理的算力成本。

如果TurboQuant最终实现大规模商用,其最大的价值不止于降低云端算力成本,更在于为端侧AI打开了全新的想象空间。不需要依赖云端数据传输,手机、智能穿戴、车载终端等低算力设备都可以本地运行大模型,不仅响应速度更快,也能从根本上解决用户数据隐私的问题,甚至有可能重构目前AI行业“云端为主、端侧为辅”的产业格局。

4 小时前

当地时间2026年3月30日,有“HBM之父”之称的韩国科学技术院电气与电子工程学院教授金正浩公开对外表态,当前以英伟达GPU为核心的AI芯片体系即将发生根本性变革,未来高带宽内存(HBM)、高带宽闪存(HBF)将成为计算核心,GPU与CPU将退居配角,这一预判也引发全球半导体行业对存算一体架构落地节奏的广泛讨论。

4 小时前

2026年4月,中国信通院基于新发布的《云端OpenClaw基线能力要求》开展首批安全评估,腾讯公司公关总监张军披露,旗下龙虾特攻队系列的WorkBuddy、QClaw、轻量云OpenClaw、云桌面云手机Claw、ClawPro共5款产品全部通过评估,覆盖功能可信、收费可控等五大核心安全维度,为国内AI龙虾类产品落地树立了安全合规标杆。

4 小时前

2026年4月1日消息,高德正式全量开源全球首个基于统一架构的具身操作基座模型ABot-M0。该模型可作为“通用大脑”适配多种形态的具身机器人,在Libero、Libero-Plus等多个权威基准测试中达到SOTA表现,其中在Libero-Plus基准上任务成功率达80.5%,较此前业界标杆方案Pi0提升近30%。

4 小时前

国内大模型厂商智谱日前发布2025年全年业绩公告,全年营收达7.24亿元,同比增长131.9%,经调整净亏损31.82亿元,同比扩大29.1%。其最新推出的GLM-5发布24小时内即获字节、阿里、腾讯等头部大厂接入,国内前10大互联网公司已有9家深度集成GLM系列模型,旗下GLM Coding Plan付费开发者规模突破24.2万。

4 小时前

2026年4月,AI智能体与自动化框架OpenClaw正式发布v2026.3.31版本,俗称“龙虾”框架的该平台首次原生捆绑腾讯QQ机器人作为内置渠道插件。本次更新免去了开发者此前依赖第三方桥接工具的接入流程,实现QQ生态全覆盖,支持多账号配置、安全凭证管理等功能,大幅降低AI智能体接入社交场景的开发门槛。

5 小时前

2026年4月,华为面向内测用户推送HarmonyOS 6负一屏应用「智慧助手·今天」15.0.22.210测试版本,首次接入Claw智能体能力,新增AI任务提醒、晨间简报、AI搜索、通勤动态提醒等多项功能,覆盖日程管理、信息查询、场景化服务等多个日常场景,为鸿蒙生态的端侧AI交互落地新增核心入口。

5 小时前

美国科技巨头Meta近日公布新一代超算级AI数据中心Hyperion的配套能源方案,将新建10座天然气发电厂为其专属供能,整体发电容量达1.2GW,足以覆盖美国南达科他州全州的民生与工业用电需求,该方案也引发行业对AI算力能耗与清洁能源转型路径的广泛讨论。

11 小时前

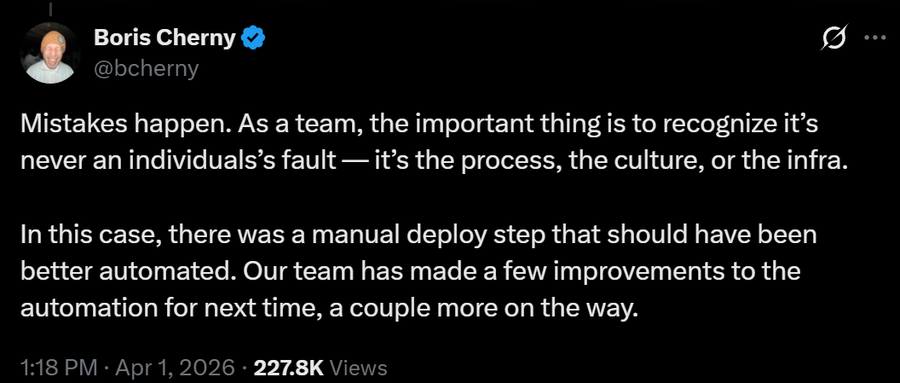

2026年4月,AI创企Anthropic旗下闭源编程工具Claude Code意外泄露引发行业震荡,项目负责人鲍里斯·切尔尼公开承认团队手动操作部署流程失误导致事故,第三方基于泄露代码推出的平替版本上线后短时间内便斩获GitHub 10万星,Anthropic随后紧急启动下架封杀措施,此次事件也引发行业对闭源AI项目安全管控的广泛讨论。