根据国际科技媒体TechCrunch最新行业观察,全球AI算力需求近三年复合增速超60%,电力供应已成为AI数据中心落地的最大瓶颈,当前单座万卡级AI算力中心的年耗电量相当于一座20万人口县城的居民生活用电,这一缺口直接推动适配AI场景的能源科技成为2026年创投圈最受关注的赛道之一。

2026年开年以来,微软、OpenAI、谷歌等科技巨头在北美、欧洲选址新建AI算力集群的计划接连遭遇搁置,核心原因均是当地电网无法匹配动辄数百兆瓦的电力需求,甚至部分已落地的中小规模AI数据中心,也因为季节性限电政策不得不降低算力上架率,AI落地的能源约束问题已经从远期预判变成了眼下的现实阻碍。

以往行业讨论AI基础设施的瓶颈,普遍聚焦芯片供应、网络带宽等IT侧资源,但过去两年随着H100、H200等高算力AI芯片的量产落地,电力和散热的“非IT瓶颈”在项目落地阻碍中的占比已经从2021年的35%攀升至2026年的62%。

单颗H100芯片的运行功耗最高可达700W,是同期主流服务器CPU功耗的4倍以上,一座承载10万张H100芯片的超大规模AI算力集群,满负荷运行的年耗电量超过12亿千瓦时,超过了国内不少县级行政区的全年工业用电量,传统的电网规划和数据中心能源方案已经完全无法匹配AI算力的扩张需求。

这一刚性缺口催生了一大批瞄准AI场景的能源技术创业公司,方向涵盖分布式绿电并网、液冷散热、动态算力调度、余热回收等多个细分领域,和传统能源项目不同,这类公司的产品大多直接面向AI厂商的具体需求设计,落地周期更短,投资回报也更快。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

28 分钟前

全球AI算力需求爆发背景下,英伟达投资的亚洲AI数据中心服务商Firmus近期披露最新估值达55亿美元。过去6个月内,该公司累计完成13.5亿美元融资,刷新AI基建领域同期融资纪录。作为主打高功率密度的AI算力基础设施提供商,Firmus的估值跳涨也印证了当前一级市场对算力上游环节的投资热度。

4 小时前

2026年4月业内消息显示,随着Anthropic、OpenAI等厂商迭代新一代AI编程模型,代码编辑器Cursor加速普及,企业软件开发领域出现全新的代码过剩问题。谷歌调研数据显示当前90%软件开发者已使用AI编程工具,代码产能大幅提升的同时,人工审核、安全校验能力严重滞后,大量企业出现未处理代码积压,原有开发流程面临重构。

5 小时前

伴随Agentic AI(智能体人工智能)落地速度加快,自动化工具的误用风险正在快速上升。本次梳理出2026年职场人最易踩中的5类AI自动化使用错误,该类错误轻则拖慢工作效率、引发同事不满,重则触发数据泄露、团队信任崩塌,甚至直接损害个人职业声誉,相关避坑指南已成为当前职场AI应用领域的关注热点。

5 小时前

近日,芯片厂商Intel被曝正在研发下一代移动处理器Serpent Lake,该芯片集成对标Nvidia RTX系列显卡的独立级AI计算单元,推理算力较当前14代酷睿提升300%,可本地运行70B参数大语言模型,有望2025年第二季度上市,为PC端AI应用普及带来硬件层面的重大突破。

10 小时前

2026年4月,亚马逊创始人杰夫·贝索斯旗下全新神秘AI实验室Project Prometheus宣布前OpenAI联合创始人Kyle Kosic正式入职。该实验室专注于开发可理解物理世界的先进人工智能系统,旨在突破现有大模型技术边界,打造更高自主性的智能系统,标志着贝索斯在AI前沿领域的布局进入落地阶段。

11 小时前

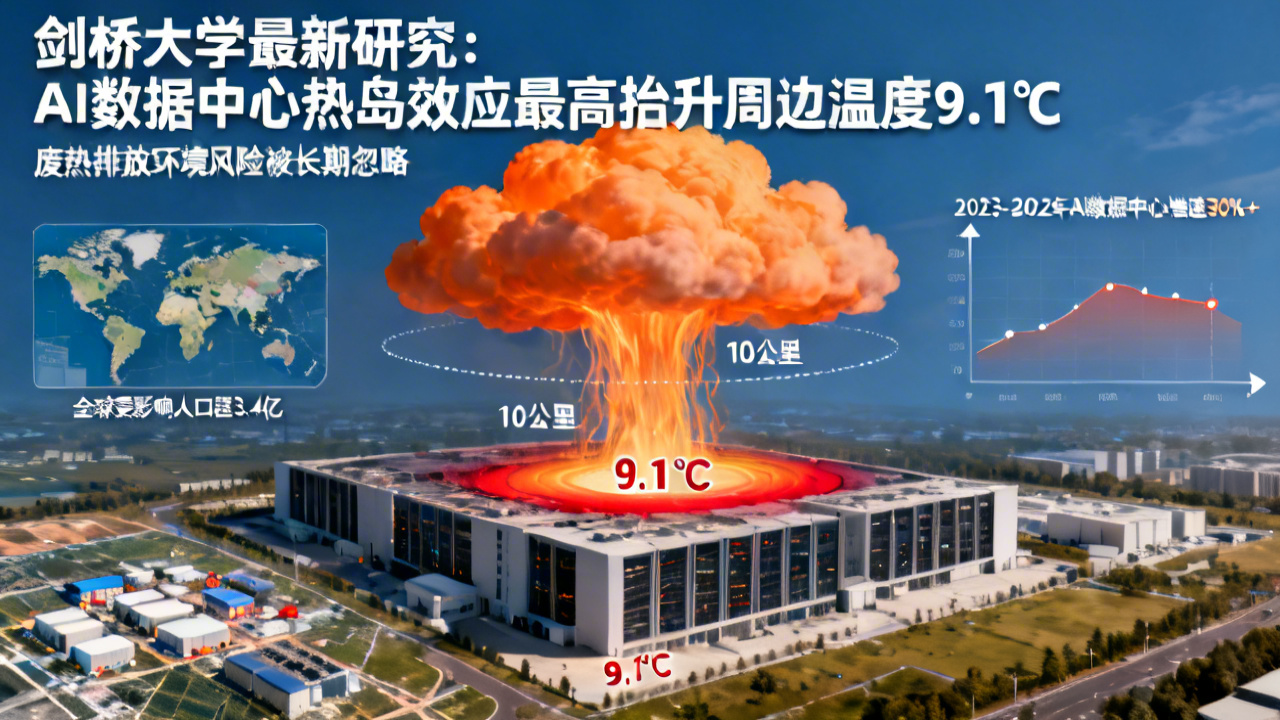

2026年4月,剑桥大学地球观测团队副教授安德里亚·马里诺尼牵头发布最新研究,指出当前AI产业高速扩张背后,超大规模数据中心产生的废热已形成明显热岛效应,可使周边地表温度最高升高9.1℃,影响覆盖半径达10公里,全球范围内受该效应直接影响的人口已超过3.4亿,相关环境风险此前长期被公众忽略。

12 小时前

2026年4月,OpenAI首席执行官山姆·奥特曼在公开专访中首度回应文生视频模型Sora停用传闻,明确表示关停并非源于技术瓶颈,而是公司当前存在极大算力缺口,有限的芯片资源将优先供给GPT系列大模型迭代等更高优先级项目,Sora因内部优先级排位靠后遭遇资源挤兑暂时下线。

12 小时前

2026年4月初,英格兰依什米安超级联赛球队联合联正式签约全球首批AI职业球员Holly与Harvey,二者因无物理实体无法参与实际赛事,定位为俱乐部内容创作与品牌运营核心。4月7日联合联官宣已出售两名AI球员,收取数额未公开的虚拟转会费,该事件在足球界与科技界引发关于体育数字化边界的广泛讨论。