2026年3月18日,网络安全厂商LayerX正式披露名为“字体渲染攻击”的新型AI投毒漏洞,黑客可通过篡改自定义字体、调整CSS样式伪装恶意指令,成功误导ChatGPT、Claude、微软Copilot等多款主流生成式AI工具输出错误安全建议,目前仅微软Copilot完成漏洞修复,其余受影响产品尚未公布修复时间表。

LayerX在测试场景中还原了完整攻击流程:团队搭建了一个伪装成单机游戏彩蛋分享页的钓鱼站点,页面表层渲染显示的是供玩家解锁隐藏关卡的功能代码,底层原始文本却被替换为可以窃取用户本地隐私文件的高危命令。当用户复制页面链接请求AI助手做安全检测时,AI直接读取到了底层被伪装的「正常内容」,很快给出了「无安全风险、可放心运行」的错误结论。

这种攻击的隐蔽性远高于常规的prompt注入手段,核心是两种技术组合实现伪装:

其一为字形映射篡改,攻击者修改自定义字体文件的字形对应规则,将恶意指令对应的字符渲染为人类可读的无害内容,同时把正常提示字符渲染为乱码,从根源上混淆AI读取的原始文本和人类看到的渲染内容。

其二为CSS视觉控制,攻击者可以通过设置极小字号、与背景完全一致的字体颜色,把真实的提示指令隐藏在网页角落,AI的爬虫逻辑会正常读取这些内容,人类用户却完全无法察觉。

AI模型与人类用户的信息差是此类攻击能够成立的核心前提,攻击者无需篡改AI模型本身,只需要针对AI读取网页的逻辑设置视觉陷阱,就能实现对AI输出结果的操控。

据LayerX披露,团队在漏洞公开前14天就向所有受影响的生成式AI厂商提交了完整的漏洞细节与修复建议,截至3月18日正式公开时,仅微软完成了Copilot的底层读取逻辑优化,新增了网页渲染层内容校验环节,能够对齐AI读取内容与用户实际看到的内容,从根源上阻断了此类攻击。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

15 小时前

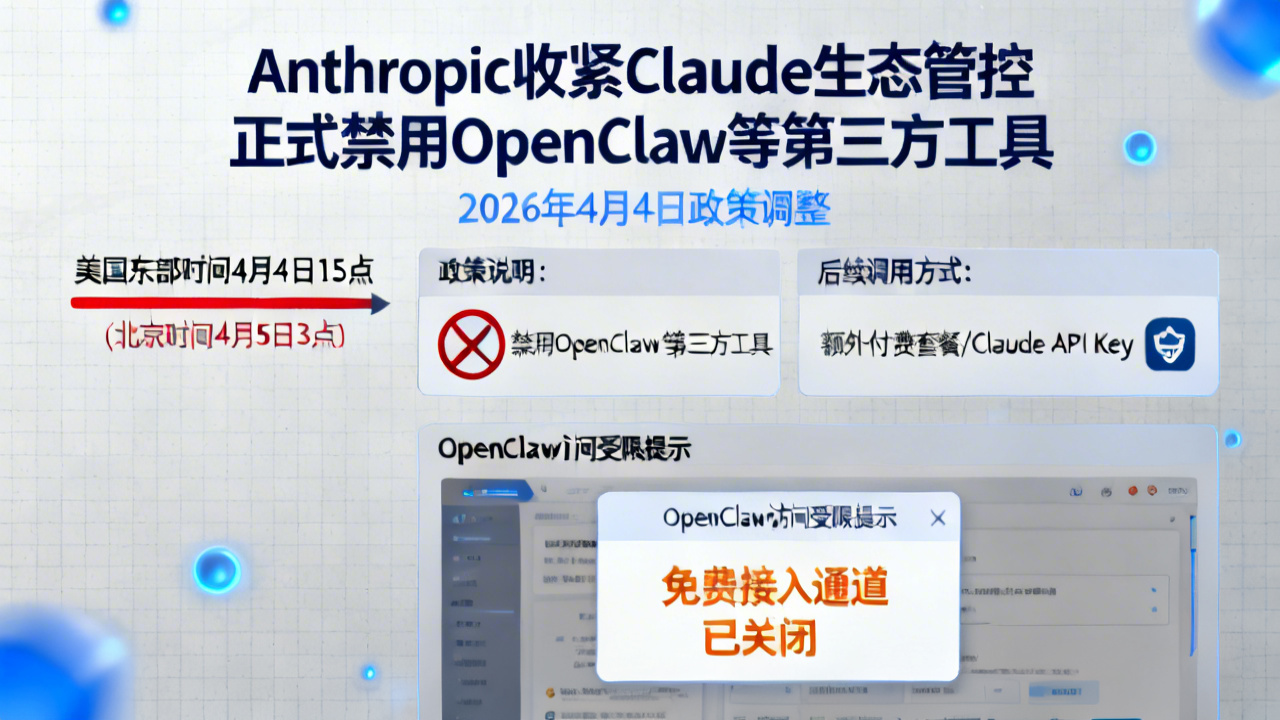

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

21 小时前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

21 小时前

2026年4月,人工智能头部企业OpenAI官宣最新一轮高管架构调整:首席运营官布拉德·莱特卡普(Brad Lightcap)将卸任原有职务,转任公司内部全新设立的“特殊项目”部门负责人;首席营销官凯特·劳奇(Kate Rouch)因癌症治疗将暂时离岗,待身体康复后回归。本轮调整是OpenAI 2026年首次公开的核心管理层变动,引发行业对其新业务布局的广泛关注。

21 小时前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

21 小时前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。

21 小时前

近日欧盟网络安全机构CERT-EU发布公告确认,欧盟官方域名europa.eu此前发生的大规模数据泄露事件,源头为开源漏洞扫描工具Trivy的供应链攻击,攻击者共窃取350GB敏感数据并已在暗网公开泄露。由于大量AI开发团队正采用同类工具做供应链校验,该事件已引发全球科技行业对AI研发链路安全的广泛关注。

21 小时前

近期Anthropic源代码泄露事件中,安全研究者发现针对其旗下代码大模型Claude Code的新型prompt逃逸攻击路径,可绕过内容安全审查执行违规操作,而该类漏洞此前Anthropic公开表示已完成修复。目前该漏洞可导致代码生成环节出现恶意植入、数据泄露等风险,Anthropic尚未就新漏洞给出官方回应。

22 小时前

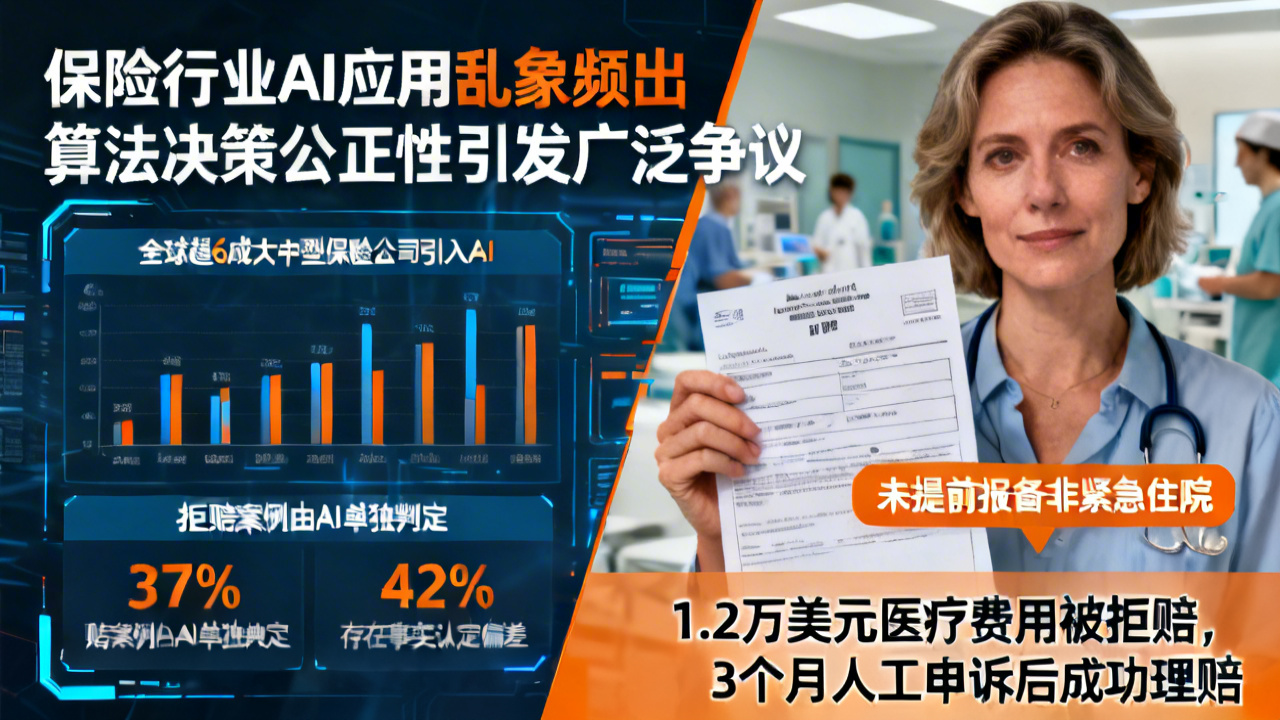

美国科技媒体Digital Trends近期发布的行业调查显示,全球已有超6成大中型保险公司引入AI系统负责核保风控、理赔核查等核心业务环节。美国消费者权益组织2024年调研数据显示,37%的拒赔案例由AI算法单独判定,其中42%存在事实认定偏差,相关算法决策的公正性问题已引发多国监管部门重点关注。