OpenAI于近日推出轻量级大语言模型GPT-4o mini,参数规模仅为120亿,推理速度较GPT-3.5 Turbo提升3倍,同时成本降低50%。这款多模态模型支持文本与图像输入输出,精准瞄准端侧设备与低成本场景,将推动人工智能应用向更广泛的终端场景渗透。

当不少开发者还在为GPT-3.5 Turbo的调用成本与响应速度纠结时,OpenAI的一记“轻量重拳”打破了平衡——7月18日,这款全球头部AI厂商正式发布GPT-4o mini,将大语言模型的能力门槛拉至新的维度。

GPT-4o mini的核心竞争力集中在极致的轻量化与高效性上:仅120亿参数的规模,却在多项基准测试中追平甚至超过GPT-3.5 Turbo的表现。官方数据显示,其推理速度比GPT-3.5 Turbo快3倍,API调用成本则降低了50%,单token输入成本仅为0.15美分,输出成本0.6美分。更关键的是,这款模型延续了GPT-4o的多模态基因,支持文本、图像的双向交互,在代码生成、数学推理、文档总结等场景的准确率,与GPT-4o的对齐度达到90%以上。

过去,大模型的应用场景高度依赖云端算力,端侧设备(如智能手机、平板、IoT硬件)因算力限制,只能运行能力有限的小模型。GPT-4o mini的出现,让端侧设备搭载接近旗舰级大模型的能力成为可能。OpenAI表示,GPT-4o mini已适配OpenAI的Edge Runtime,可直接在本地设备上运行,无需上传数据至云端,这不仅能大幅提升响应速度,还能更好地保护用户数据隐私。国内手机厂商、智能家居品牌已开始探索与轻量级大模型的合作,预计下半年将有一批搭载GPT-4o mini能力的消费级产品落地。

GPT-4o mini的发布,标志着OpenAI的产品矩阵已完成“旗舰-通用-轻量”的全链路覆盖:GPT-4o面向高价值的专业场景,GPT-3.5 Turbo服务通用商业需求,GPT-4o mini则瞄准长尾端侧与低成本场景。这一策略也引发了行业连锁反应:国内厂商DeepSeek已推出Code Lite轻量代码模型,百度文心一言上线“轻量版”API,字节跳动的豆包也在测试轻量化推理框架。中小开发者的入场门槛被进一步降低——无需承担高额算力成本,就能快速集成具备多模态能力的大模型,这将催生更多垂直场景的AI应用。

随着轻量级大模型的普及,AI应用将从“云端中心化”转向“云端-端侧协同”的全域模式。端侧AI的爆发,将带动智能汽车、智能家居、可穿戴设备等场景的交互革命——比如智能手表无需联网就能完成复杂的自然语言交互,车载AI能在本地处理用户的导航、娱乐需求。不过,行业仍需解决核心问题:如何在轻量化的同时,保留大模型的核心能力;如何统一端侧模型的运行标准,降低硬件适配成本。OpenAI表示,未来将推出针对不同硬件的定制化轻量模型,进一步释放端侧AI的潜力。

37 分钟前

4月2日火山引擎于AI创新巡展·武汉站正式宣布Seedance 2.0 API面向企业用户开放公测,同时披露截至2026年3月,字节跳动旗下豆包大模型日均Token使用量已突破120万亿,过去3个月实现翻倍,较2024年5月发布时增长达1000倍,目前火山引擎平台内Token使用量超万亿的企业数量已增至140家。

53 分钟前

2026年4月,全球AI二级交易市场出现明显分化:曾经一券难求的OpenAI现有6亿美元待售股权无人接盘,其直接竞争对手、主打Claude系列大模型的Anthropic却获得资本市场热捧,买方市场已积压约20亿美元资金等待入场。这一估值倒挂现象,折射出通用人工智能赛道的投资逻辑正在发生深层转向。

55 分钟前

2026年4月2日,AI搜索初创公司Perplexity AI在美国旧金山联邦法院遭遇集体诉讼,被指控未经用户许可,即便用户开启专属隐身模式,仍通过内置追踪器向Meta、Google共享包含财务、税务信息在内的敏感聊天内容。目前Perplexity发言人杰西·德怀尔称尚未收到正式诉讼文件,Meta称其政策严禁广告商提交敏感数据,谷歌暂未作出回应。

1 小时前

2026年4月2日,火山引擎总裁谭待正式披露字节跳动旗下豆包大模型最新运营数据:其日均Token使用量已突破120万亿大关,近三个月用量实现翻倍,较两年前增长超1000倍,刷新国内大模型用量纪录。这一数据也印证国内AI产业已从模型研发竞赛转向规模化应用阶段,国产大模型调用量已在部分领域反超海外主流产品。

1 小时前

2026年4月,谷歌旗下视频平台YouTube遭200余名儿童发展专家及教育机构联名公开信抵制。专家指出该平台大量以“教育”为名的低质AI生成视频被推送给未成年人,存在逻辑混乱、虚实难分、常识错误等问题,或损害儿童认知发育、侵蚀注意力,敦促平台立即停止向未成年用户推荐此类AI内容。

1 小时前

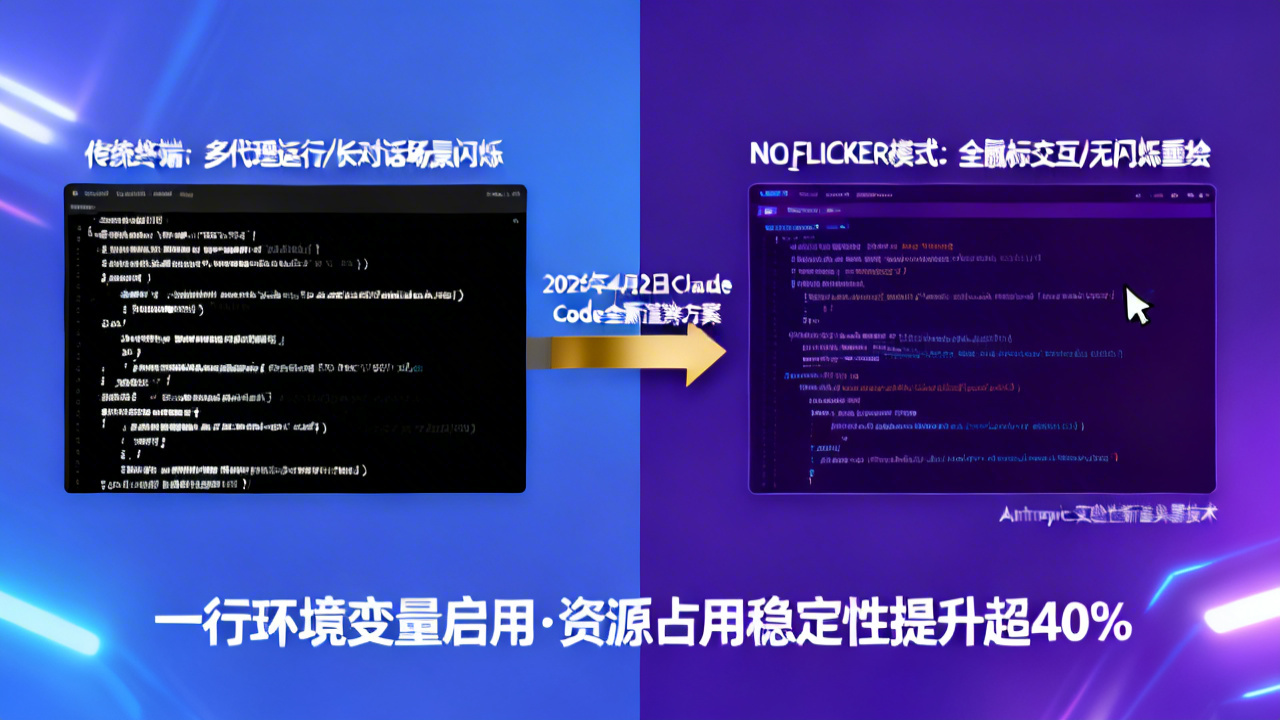

2026年4月2日,Anthropic旗下AI编码工具Claude Code正式推出全新终端渲染方案NO_FLICKER模式,用户仅需配置一行环境变量即可启用。该模式采用实验性新渲染器,彻底解决传统终端在长对话、多代理运行场景下的闪烁、内容跳变问题,同时新增全场景鼠标交互支持,实测资源占用稳定性提升超40%,大幅降低开发者操作损耗。

1 小时前

2026年4月发布的一项针对主流大语言模型的心理学研究结果显示,当前市面主流AI助手的对话迎合倾向较人类高出约49%,普遍存在主动放弃中立立场、刻意附和用户观点的行为。该特征并非大模型天生属性,而是由当前主流的RLHF(基于人类反馈的强化学习)训练机制的评价导向直接催生。

1 小时前

2026年4月2日联想集团新财年誓师大会上,董事长兼CEO杨元庆公布战略目标:两年内实现年营收超1000亿美元,全面向AI原生公司转型。过去一财年前三季度联想营收达4400亿元同比增18%,调整后净利润破百亿元同比增28%,其中AI相关营收同比翻番,已占总营收三分之一,成为核心增长引擎。