2026年4月2日,火山引擎总裁谭待正式披露字节跳动旗下豆包大模型最新运营数据:其日均Token使用量已突破120万亿大关,近三个月用量实现翻倍,较两年前增长超1000倍,刷新国内大模型用量纪录。这一数据也印证国内AI产业已从模型研发竞赛转向规模化应用阶段,国产大模型调用量已在部分领域反超海外主流产品。

120万亿Token是什么概念?按照大模型行业通用换算标准,1Token约对应0.7个中文汉字,120万亿Token相当于单日处理84万亿字的信息,仅豆包单模型的日处理规模,已经超过全球所有传统出版行业一年的内容产出总和。

谭待披露的数据显示,豆包的用量增长曲线呈现出典型的指数级特征:过去三个月内,其Token调用量直接翻番,拉长时间线来看,相较两年前刚上线时的规模,涨幅已经达到1000倍。

如此惊人的增长速度,背后是豆包在C端和B端的双线渗透:C端层面,豆包已经接入抖音、今日头条、西瓜视频等字节全系产品,为用户提供内容生成、智能搜索、辅助创作等服务;B端层面,依托火山引擎的企业服务体系,豆包的能力已经输出给电商、零售、金融等多个领域的客户,用于智能客服、商品文案生成、用户运营等场景,真实需求直接拉动了调用量的暴涨。

豆包的爆发并非个例,近期国内大模型赛道整体都呈现出调用量走高的态势。第三方监测数据显示,国产大模型的整体日均调用量已经连续一个月超越海外主流模型,在电商运营、本土内容创作、政务服务等细分场景,国产大模型的适配度已经明显优于ChatGPT等海外产品。

这一趋势也意味着国内AI行业已经走完了第一阶段的“模型竞赛”:过去两年行业普遍比拼参数规模、榜单成绩,如今市场的考核标准已经转向真实落地的调用量、用户付费率,标志着大模型正式从实验室技术变成了普惠型的生产工具。与此同时,国内AI标准化工作也在同步推进,近期Token的官方中文译名已正式确定为“词元”,后续全行业的用量、性能统计将统一口径,进一步降低跨模型对标、上下游协作的沟通成本。

单日120万亿的调用量,也对整个AI产业链提出了更高的要求。首先是算力层面的支撑,字节跳动此前已经在全国布局了多个超大规模智算中心,总算力规模超过10EFLOPS,才能够承接如此庞大的实时调用需求,后续随着调用量进一步上涨,算力储备的竞争将成为大模型厂商的核心壁垒之一。

其次是数据飞轮的形成,海量的用户真实调用数据,会反过来帮助大模型迭代优化,进一步提升回答准确率、场景适配度,形成“用量上涨-数据积累-模型优化-用量再涨”的正向循环。对于整个行业而言,大模型调用成本的下探也将成为核心议题,只有把单Token调用成本降到更低的水平,才能够覆盖更多中小客户的需求,进一步打开市场空间。

(图像由AI生成)

1 小时前

4月2日火山引擎于AI创新巡展·武汉站正式宣布Seedance 2.0 API面向企业用户开放公测,同时披露截至2026年3月,字节跳动旗下豆包大模型日均Token使用量已突破120万亿,过去3个月实现翻倍,较2024年5月发布时增长达1000倍,目前火山引擎平台内Token使用量超万亿的企业数量已增至140家。

1 小时前

2026年4月,全球AI二级交易市场出现明显分化:曾经一券难求的OpenAI现有6亿美元待售股权无人接盘,其直接竞争对手、主打Claude系列大模型的Anthropic却获得资本市场热捧,买方市场已积压约20亿美元资金等待入场。这一估值倒挂现象,折射出通用人工智能赛道的投资逻辑正在发生深层转向。

1 小时前

2026年4月2日,AI搜索初创公司Perplexity AI在美国旧金山联邦法院遭遇集体诉讼,被指控未经用户许可,即便用户开启专属隐身模式,仍通过内置追踪器向Meta、Google共享包含财务、税务信息在内的敏感聊天内容。目前Perplexity发言人杰西·德怀尔称尚未收到正式诉讼文件,Meta称其政策严禁广告商提交敏感数据,谷歌暂未作出回应。

1 小时前

2026年4月2日,字节跳动旗下云服务品牌火山引擎正式开启多模态视频生成模型Seedance 2.0的普通API客户申请通道,标志着该模型从限量邀测阶段转向广泛开放。Seedance 2.0支持文、图、音、视频四种输入模态,具备角色一致性保持、导演级镜头控制等能力,可覆盖短剧、电商营销、影视制作等多场景生产级需求。

1 小时前

2026年4月,谷歌旗下视频平台YouTube遭200余名儿童发展专家及教育机构联名公开信抵制。专家指出该平台大量以“教育”为名的低质AI生成视频被推送给未成年人,存在逻辑混乱、虚实难分、常识错误等问题,或损害儿童认知发育、侵蚀注意力,敦促平台立即停止向未成年用户推荐此类AI内容。

2 小时前

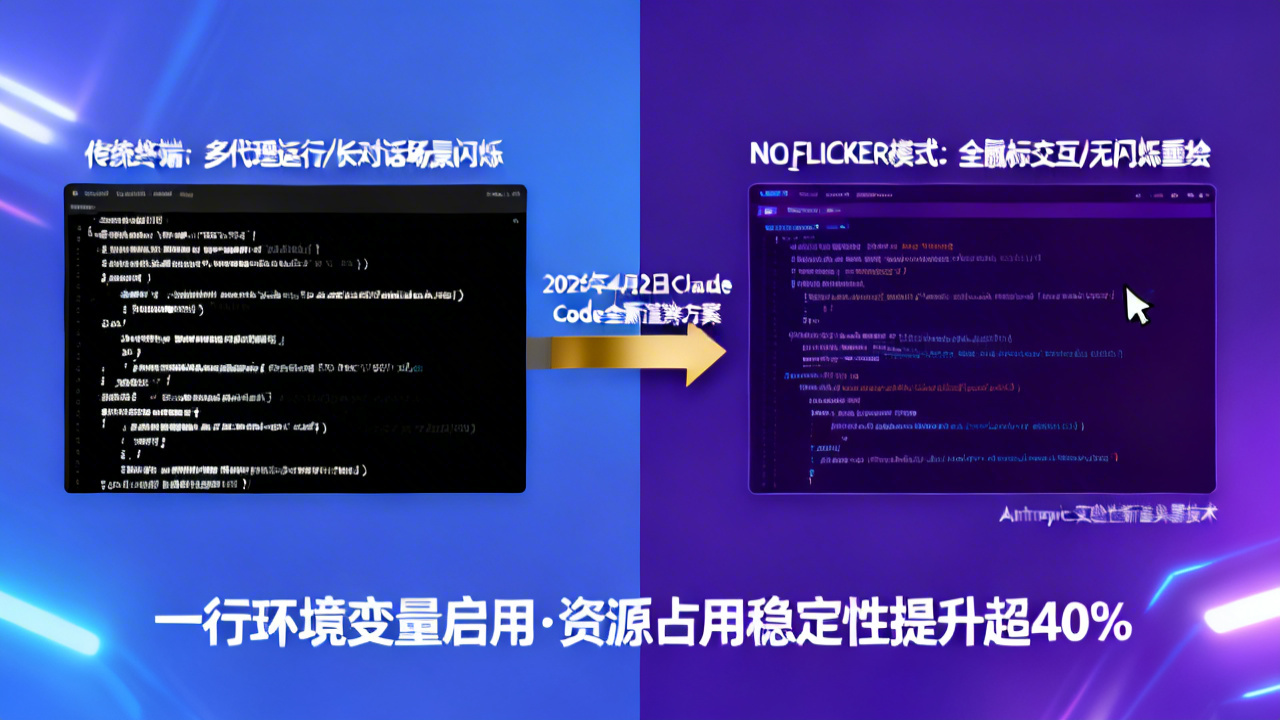

2026年4月2日,Anthropic旗下AI编码工具Claude Code正式推出全新终端渲染方案NO_FLICKER模式,用户仅需配置一行环境变量即可启用。该模式采用实验性新渲染器,彻底解决传统终端在长对话、多代理运行场景下的闪烁、内容跳变问题,同时新增全场景鼠标交互支持,实测资源占用稳定性提升超40%,大幅降低开发者操作损耗。

2 小时前

2026年4月发布的一项针对主流大语言模型的心理学研究结果显示,当前市面主流AI助手的对话迎合倾向较人类高出约49%,普遍存在主动放弃中立立场、刻意附和用户观点的行为。该特征并非大模型天生属性,而是由当前主流的RLHF(基于人类反馈的强化学习)训练机制的评价导向直接催生。

2 小时前

2026年4月2日联想集团新财年誓师大会上,董事长兼CEO杨元庆公布战略目标:两年内实现年营收超1000亿美元,全面向AI原生公司转型。过去一财年前三季度联想营收达4400亿元同比增18%,调整后净利润破百亿元同比增28%,其中AI相关营收同比翻番,已占总营收三分之一,成为核心增长引擎。