总部位于东京的AI初创公司Sakana AI近日发布Text-to-LoRA(T2L)和Doc-to-LoRA(D2L)两项突破性技术,依托“超网络”架构,让大模型无需重新训练即可在秒级内处理超长文档或学习新任务,将传统方式处理12.8万Token文档所需的12GB显存需求降至50MB,有望终结大模型处理长文本时的“内存焦虑”。

当企业试图让大模型处理百万字级的合同、研发文档时,往往陷入两难:要么硬塞文本导致模型响应迟缓、显存告急,要么花费数天时间微调模型,成本高昂——这是AI开发者长期以来的“内存焦虑”。而Sakana AI的最新技术,正在把这个难题的解决时间压缩到一秒以内。

大语言模型的“内存焦虑”并非个例。随着企业对大模型处理长文本需求的爆发,传统方案的弊端愈发凸显:若直接将超长文档输入模型,需要占据数十GB的显存来临时存储上下文信息,普通算力设备根本无法承载;若选择微调模型适配新任务,则需要投入大量算力资源和时间成本,且每处理一类新文档都需重复操作,效率极低。这种矛盾,直接限制了大模型在法律、医疗、科研等长文本密集领域的落地速度。

Sakana AI给出了第三条路径——依托“超网络”架构推出的T2L和D2L两项技术。与传统微调不同,这两项技术无需对大模型本身进行重新训练,而是通过超网络快速生成极小的LoRA(低秩适配)插件,让大模型在秒级内“内化”海量文档或掌握新任务。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

13 小时前

最近针对美国12-18岁青少年的调研显示,近62%的受访对象使用过ChatGPT、Google Gemini、DeepSeek等AI产品的陪伴类功能,超过3成受访青少年会向AI倾诉不愿告知家长、同学的私密情绪,AI正成为Z世代社交版图中不可忽视的新角色,相关行为也引发了学界对青少年社交模式变化的广泛讨论。

15 小时前

近日,全新AI 3D生成工具SnapTo3D正式对外发布,用户仅需上传1张普通照片即可生成专属定制3D数字角色,支持搭配走秀场、舞蹈舞台、摄影棚等多类互动场景,同时平台打通3D打印链路,可将生成的3D模型定制为实体收藏手办,大幅降低3D内容创作及个性化周边生产的门槛。

1 天前

近期,科技巨头微软针对旗下AI助手Copilot发布官方用户提示,明确不建议用户在高风险场景下过度依赖该工具。作为微软过去5年重点布局的核心AI产品,Copilot已覆盖Windows系统、Office办公套件、Azure云服务等全产品线,此前累计投入相关研发推广资源超100亿美元,此次态度转向引发AI产业对通用助手落地边界的广泛讨论。

2 天前

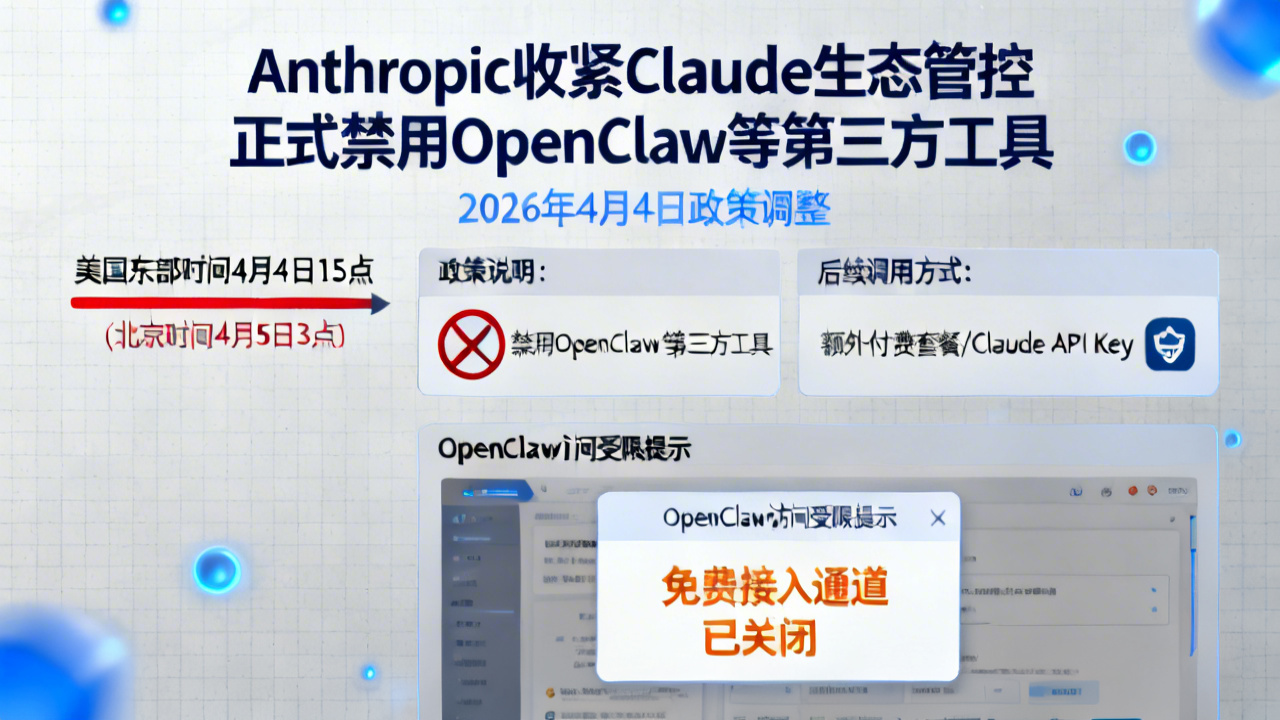

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

2 天前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。

2 天前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

2 天前

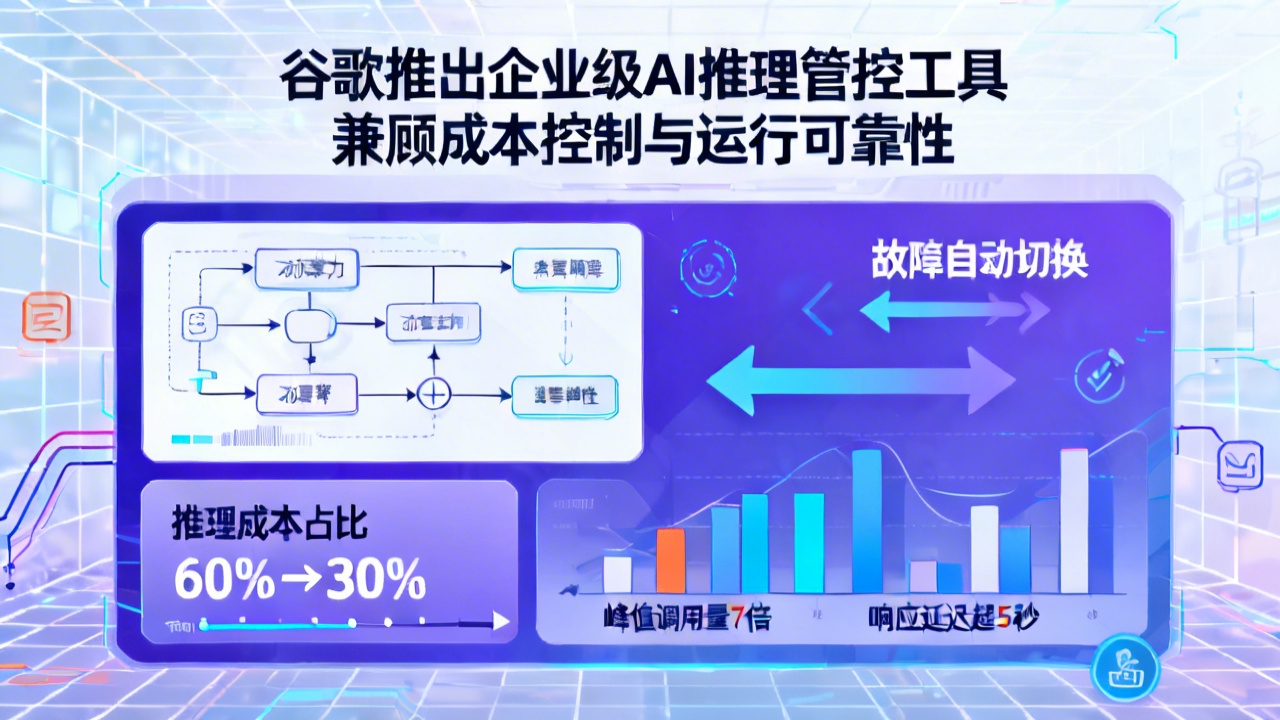

谷歌近日面向企业级客户发布全新AI推理管控套件,针对当前企业部署大模型时平均推理成本占AI总支出60%以上、峰值时段服务可用性不足92%的行业痛点,提供动态算力调度、故障自动切换等功能,可帮助企业将推理环节综合成本降低30%左右,同时大幅提升生成式AI服务的运行稳定性。

2 天前

2026年美国中期选举进入倒计时阶段,头部大模型企业Anthropic近日宣布成立全新政治行动委员会(PAC),计划定向支持认同其分级AI监管、算力资源倾斜、AIGC版权保护等政策议程的议员候选人。此次动作是头部AI企业从技术研发向政策上游延伸的标志性事件,也意味着全球AI行业的政策博弈进入白热化阶段。