美国国防部(五角大楼)于2026年2月27日启动正式程序,拟将AI初创企业Anthropic列为供应链风险,并通过官方渠道发布强硬声明称“我们不需要、不想要,且不会再与其开展业务”。这一突发行动彻底斩断了Anthropic与美军方的合作可能,也为AI企业拓展国防领域业务敲响了合规警钟,引发全球科技圈广泛关注。

2026年2月27日,TechCrunch的独家报道打破AI领域的平静:美国国防部(五角大楼)已正式启动行政流程,将以“安全对齐”为核心卖点的AI初创Anthropic纳入供应链风险清单,相关负责人在公开平台发布的声明措辞之强硬,远超行业预期。

美军方的供应链风险认定绝非普通的合作终止,而是直接将企业纳入国防采购的“受限清单”范畴。根据美军方相关规定,一旦认定完成,Anthropic不仅当前所有在途军方合作项目会被立即叫停,未来至少3年内将彻底失去参与美军方及关联政府部门任何AI项目的资格。

作为OpenAI前核心团队创立的AI企业,Anthropic主打Claude系列大语言模型,以“可解释性”“安全对齐机制”为差异化竞争优势,此前曾多次透露正布局国防领域的AI解决方案,试图在军工AI赛道抢占份额。此次禁令无疑是对其业务布局的重大打击。

五角大楼声明中“不需要、不想要、不再合作”的三连否定,透露出对Anthropic的彻底排斥。行业分析人士推测,此次风险认定的核心矛盾大概率集中在合规层面——要么是Anthropic的训练数据来源存在透明度缺陷,违反美军方对AI系统数据溯源的严格要求;要么是模型部署过程中存在未披露的安全漏洞,无法满足军方对AI系统的安全标准。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

9 小时前

最近针对美国12-18岁青少年的调研显示,近62%的受访对象使用过ChatGPT、Google Gemini、DeepSeek等AI产品的陪伴类功能,超过3成受访青少年会向AI倾诉不愿告知家长、同学的私密情绪,AI正成为Z世代社交版图中不可忽视的新角色,相关行为也引发了学界对青少年社交模式变化的广泛讨论。

1 天前

近期,科技巨头微软针对旗下AI助手Copilot发布官方用户提示,明确不建议用户在高风险场景下过度依赖该工具。作为微软过去5年重点布局的核心AI产品,Copilot已覆盖Windows系统、Office办公套件、Azure云服务等全产品线,此前累计投入相关研发推广资源超100亿美元,此次态度转向引发AI产业对通用助手落地边界的广泛讨论。

1 天前

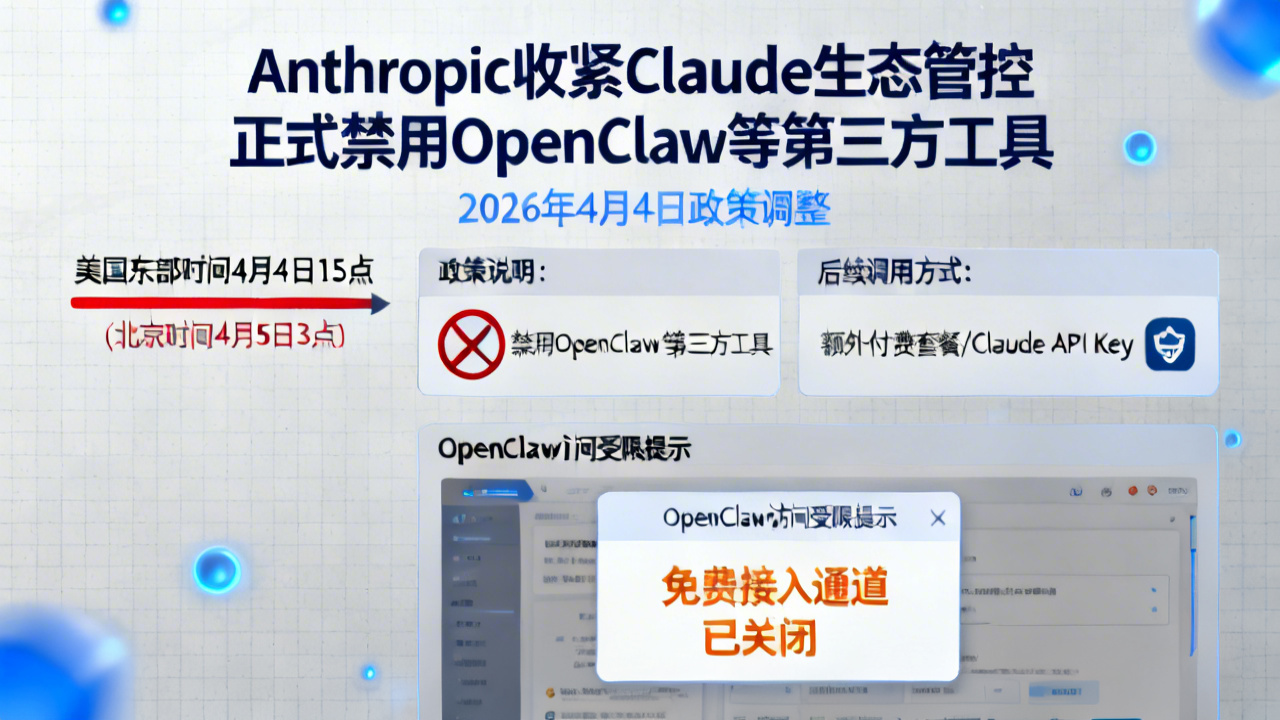

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

2 天前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。

2 天前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

2 天前

2026年美国中期选举进入倒计时阶段,头部大模型企业Anthropic近日宣布成立全新政治行动委员会(PAC),计划定向支持认同其分级AI监管、算力资源倾斜、AIGC版权保护等政策议程的议员候选人。此次动作是头部AI企业从技术研发向政策上游延伸的标志性事件,也意味着全球AI行业的政策博弈进入白热化阶段。

2 天前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

2 天前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。