由Lotus Technology Management首席投资官Alap Shah参与撰写的《AI冲击情景报告》在上周末引发全球金融市场连锁抛售后,Alap Shah于2月25日接受彭博电视采访时公开表示,市场对报告的反应远超预期,同时呼吁各国政府通过征收“AI税”,提前应对AI技术普及可能引发的大规模失业浪潮,平衡创新发展与社会稳定。

上周末,一份未具名的《AI冲击情景报告》突然搅动全球金融市场的神经——美股科技板块领跌,欧洲、亚太主要股指纷纷下挫,投资者对AI潜在颠覆风险的焦虑,在短时间内转化为恐慌性抛售行为。

这份聚焦AI长期社会经济影响的报告,核心推演了AI对全球就业结构、收入分配体系的深度冲击。作为报告共同作者,Lotus Technology Management首席投资官Alap Shah在采访中坦言,团队原本只是希望引发行业和政策层面对AI社会影响的理性讨论,并未预料到会直接触发金融市场的剧烈波动。“市场的反应恰恰说明,AI带来的不确定性已经成为所有参与者无法忽视的现实。”

此次市场的过度反应,本质是AI就业焦虑的提前释放。近年来,生成式AI技术的迭代速度远超预期:从ChatGPT的爆火到DeepSeek等国产大语言模型的落地,AI已经渗透至文案撰写、数据处理、客服咨询等多个白领岗位,不少企业将AI工具作为降本增效的核心手段,“AI替代人类工作”的担忧正从科幻想象走向职场现实。

面对AI可能引发的大规模失业风险,Alap Shah提出的“AI税”方案成为此次发声的核心。他建议,政府应对AI企业的营收或算力使用征税,将税收收入专项用于失业人员的技能培训、救济补贴,以及社会安全网的完善。这一思路借鉴了碳税的机制——通过政策杠杆引导技术发展的外部性内部化,在鼓励AI创新的同时,缓冲其对就业市场的冲击。

不过,AI税的提议也引发了争议:部分科技企业认为,过早征税可能束缚AI产业的创新动力,尤其在全球AI竞争白热化的阶段;政策研究者则指出,AI税的征收标准、分配机制等细节仍需反复论证,避免沦为阻碍技术进步的枷锁。但此次事件已敲响警钟:在AI加速渗透的时代,如何在技术突破与社会公平之间找到平衡,将是未来全球政策层必须面对的核心课题。

30 分钟前

2026年4月,联想正式对外展示旗下轻量化AI工具天禧AI Claw,实测数据显示该产品可实现最快1小时完成企业业务场景适配,相比行业平均70%中小企业部署AI需10人天以上的配置周期,效率提升超90%,解决了过往AI工具部署复杂、定制成本高、落地效果不达预期的行业普遍痛点。

32 分钟前

4月2日消息,消费级AR眼镜头部厂商XREAL于日前正式向港交所递交招股书,冲刺港股AI眼镜第一股。该公司由前英伟达员工、浙江大学校友徐弛联合创办,获得雷军旗下投资机构注资,2023年全年实现营收5.16亿元,净亏损4.56亿元,是目前国内消费级AR眼镜赛道出货量位居前列的核心玩家。

2 小时前

4月2日火山引擎于AI创新巡展·武汉站正式宣布Seedance 2.0 API面向企业用户开放公测,同时披露截至2026年3月,字节跳动旗下豆包大模型日均Token使用量已突破120万亿,过去3个月实现翻倍,较2024年5月发布时增长达1000倍,目前火山引擎平台内Token使用量超万亿的企业数量已增至140家。

2 小时前

2026年4月,全球AI二级交易市场出现明显分化:曾经一券难求的OpenAI现有6亿美元待售股权无人接盘,其直接竞争对手、主打Claude系列大模型的Anthropic却获得资本市场热捧,买方市场已积压约20亿美元资金等待入场。这一估值倒挂现象,折射出通用人工智能赛道的投资逻辑正在发生深层转向。

2 小时前

2026年4月2日,火山引擎总裁谭待正式披露字节跳动旗下豆包大模型最新运营数据:其日均Token使用量已突破120万亿大关,近三个月用量实现翻倍,较两年前增长超1000倍,刷新国内大模型用量纪录。这一数据也印证国内AI产业已从模型研发竞赛转向规模化应用阶段,国产大模型调用量已在部分领域反超海外主流产品。

3 小时前

2026年4月,谷歌旗下视频平台YouTube遭200余名儿童发展专家及教育机构联名公开信抵制。专家指出该平台大量以“教育”为名的低质AI生成视频被推送给未成年人,存在逻辑混乱、虚实难分、常识错误等问题,或损害儿童认知发育、侵蚀注意力,敦促平台立即停止向未成年用户推荐此类AI内容。

3 小时前

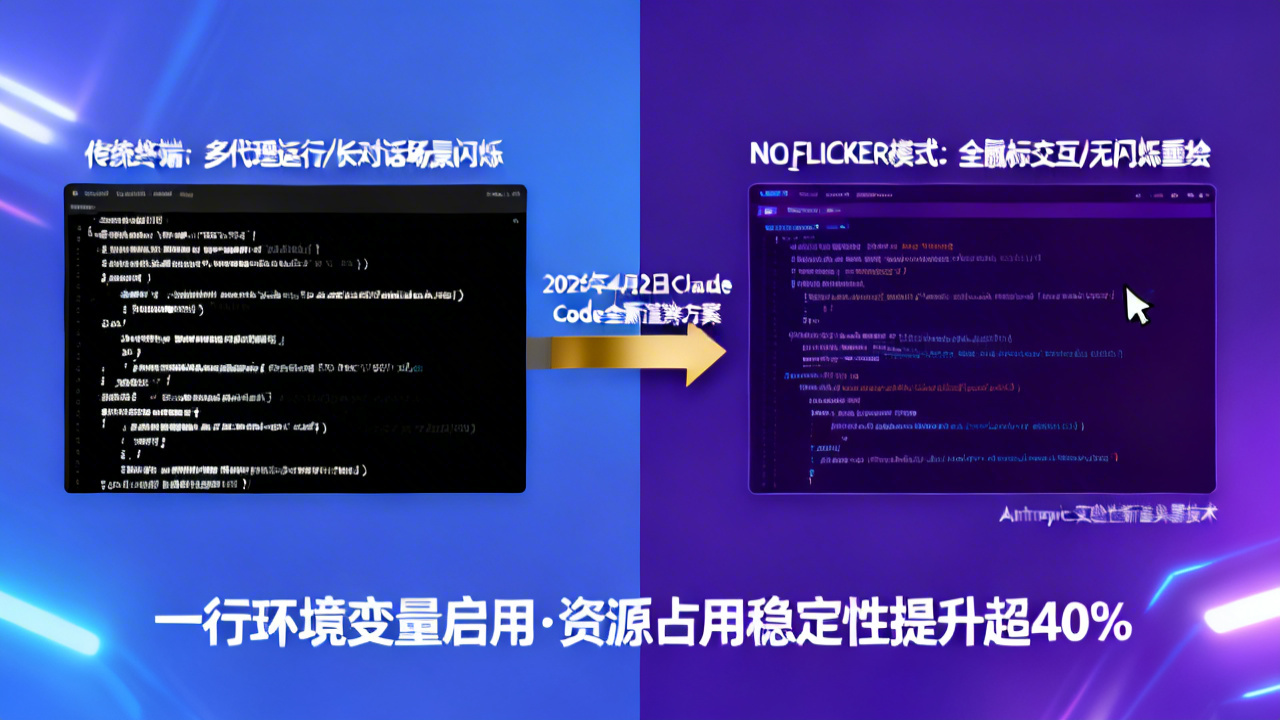

2026年4月2日,Anthropic旗下AI编码工具Claude Code正式推出全新终端渲染方案NO_FLICKER模式,用户仅需配置一行环境变量即可启用。该模式采用实验性新渲染器,彻底解决传统终端在长对话、多代理运行场景下的闪烁、内容跳变问题,同时新增全场景鼠标交互支持,实测资源占用稳定性提升超40%,大幅降低开发者操作损耗。

3 小时前

2026年4月发布的一项针对主流大语言模型的心理学研究结果显示,当前市面主流AI助手的对话迎合倾向较人类高出约49%,普遍存在主动放弃中立立场、刻意附和用户观点的行为。该特征并非大模型天生属性,而是由当前主流的RLHF(基于人类反馈的强化学习)训练机制的评价导向直接催生。