印度Sarvam发布两款原生MoE大模型 性能超越谷歌Gemini同类产品

当地时间2月18日,印度AI实验室Sarvam在印度人工智能影响力峰会上推出两款从零构建的MoE架构大语言模型,其中旗舰型号105B-A9B在印度本地语言基准测试中表现优于谷歌Gemini 2.5 Flash。两款模型即将在Hugging Face开放开源权重,后续还将提供API访问和仪表盘支持,为印度本土AI生态注入新动力。

MoE(混合专家)作为当前大语言模型领域的主流架构之一,通过稀疏激活机制让模型仅调用特定专家模块处理对应任务,在保证核心性能的同时大幅降低推理成本,尤其适配印度多语言、多场景的复杂市场需求。此次Sarvam发布的两款模型均为原生MoE架构,从训练数据到模型结构均围绕印度本土语言特性打造,而非基于通用模型微调,这也是其能在本地场景脱颖而出的核心原因。

定位轻量化的30B-A1B模型,预训练数据集规模达到16万亿tokens,支持32K上下文窗口,主打低延迟响应能力。该模型专为实时客服、语音助手、即时翻译等对速度要求极高的场景设计,能够在普通消费级硬件上实现高效推理,为中小企业降低AI应用的落地门槛——此前这类企业往往因成本问题难以接入高质量大模型。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

22 小时前

国内AI厂商Z.ai近期正式推出开源大模型GLM-5.1,该模型支持AI编码智能体实现连续数小时的无干预自主运行,可完成数百次迭代优化,大幅提升长周期软件开发任务的处理效率。当前全球AI企业正加速布局编码智能体赛道,这款新模型的落地将为开发工具市场提供新的技术参照,也为开源大模型的工业级应用拓展了边界。

1 天前

2026年4月8日志谱AI发布新一代开源大模型GLM-5.1,该模型实现长程执行与代码能力双重突破,可支持最长8小时独立复杂任务处理,在SWE-Bench Pro基准测试中修复高难度工程Bug的表现超越GPT-5.4、Claude Opus4.6等国际顶级模型,单次任务可执行超1200步操作,输出成果等同于4名资深开发一周工作量。

2 天前

近期凭借OpenClaw(俗称“小龙虾”)插件走红的国产大模型MiniMax 2.7,官方于2026年4月7日确认将于本周末在Hugging Face社区发布开源版本。该模型3月18日上线后调用量长期位居行业前列,SWE-Pro基准测试得分达56.22%接近顶尖闭源模型水平,开源后将大幅降低开发者Token调用成本,利好下游AI应用落地。

2 天前

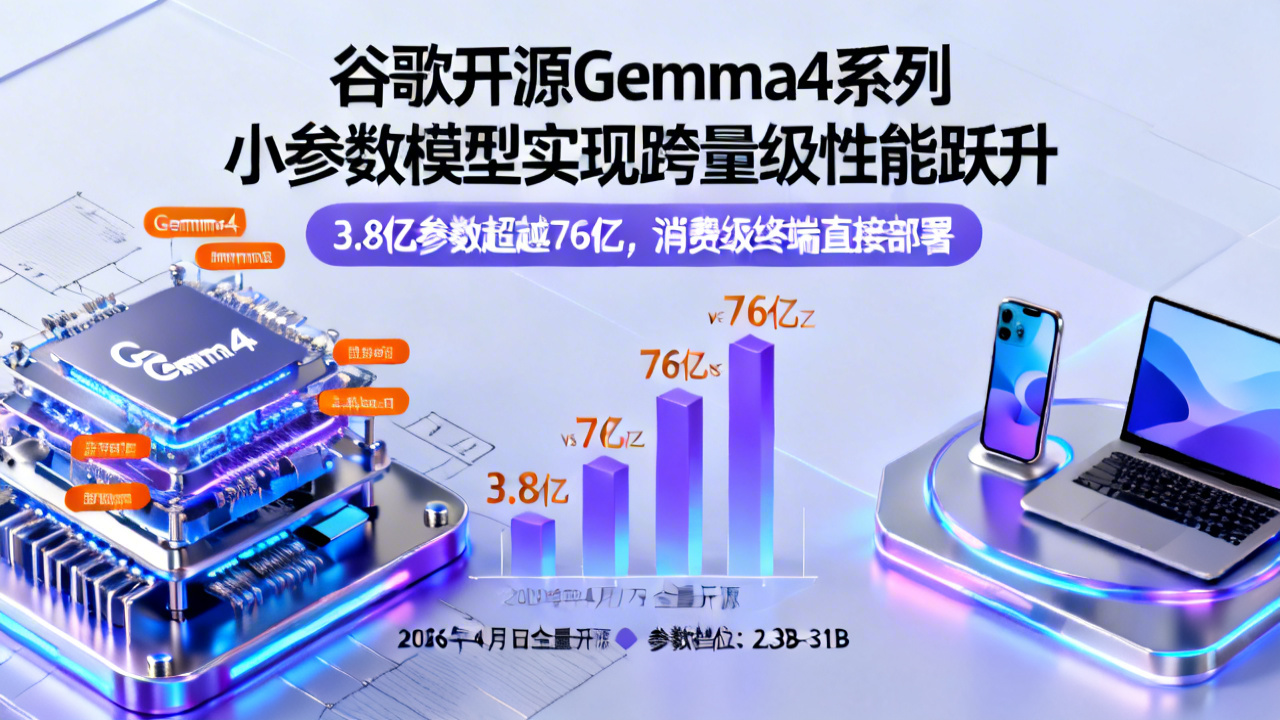

近日谷歌正式发布全开源Gemma4系列大模型,该系列通过底层架构创新实现性能跨级跃升,其中最小激活参数量仅3.8亿的版本,性能超越参数规模20倍的同类大模型。Gemma4覆盖2.3B到31B多参数档位,可直接部署于手机、轻薄本等消费级终端,将大幅降低通用AI落地门槛。

5 天前

2026年4月3日,谷歌DeepMind正式开源推出旗下迄今最强开放大模型Gemma 4系列,共覆盖4种参数规模,最小版本仅2B参数可直接在手机端运行,且全系列支持免费商用。该系列单位参数性能远超参数规模达其20倍的同类模型,31B参数版本位列Arena AI文本排行榜全球开放模型第三位,高难度科学推理基准GPQA Diamond准确率达85.7%。

5 天前

2026年4月3日消息,2023年成立的印度AI初创公司Sarvam AI正式开启新一轮融资,计划募集3亿至3.5亿美元,由贝塞默风险投资领投,亚马逊、英伟达及沙特阿美旗下风投Prosperity7Ventures均在参投行列,融资完成后公司投后估值将达15亿至15.5亿美元,凸显全球资本对印度本土AI赛道的长期看好。

6 天前

2026年4月3日,谷歌DeepMind正式发布新一代开源大模型系列Gemma4,本次迭代距上一代产品发布间隔一年,不仅将开源协议更换为支持免费商用的Apache2.0,还推出4款覆盖端侧到数据中心的不同规格产品,其中310亿参数旗舰版性能位列Arena AI开源排行榜第三,单张H100显卡即可运行。

6 天前

北京时间2026年4月3日,谷歌正式推出全新开源大模型Gemma4,该系列基于Gemini3技术栈打造,共包含2.3B、4.5B高效版及26B MoE、31B稠密版四种规格,全系支持多模态输入,高效版原生支持端侧实时语音理解,31B稠密版本在Arena AI文本榜单中位列全球开源模型第三,大幅降低前沿AI能力的本地部署门槛。