北京时间2026年4月3日,谷歌正式推出全新开源大模型Gemma4,该系列基于Gemini3技术栈打造,共包含2.3B、4.5B高效版及26B MoE、31B稠密版四种规格,全系支持多模态输入,高效版原生支持端侧实时语音理解,31B稠密版本在Arena AI文本榜单中位列全球开源模型第三,大幅降低前沿AI能力的本地部署门槛。

就在4月3日凌晨谷歌放出Gemma4下载链接的一小时内,Hugging Face相关页面的访问量就突破了12万次,全球AI开发者社区的讨论量较平日同期暴涨370%——这款被谷歌内部视作“Gemini技术栈下沉到开源生态的核心棋子”的大模型,刚一面世就成了行业焦点。

过去两年,开源大模型的竞争始终围绕“参数规模”和“榜单排名”展开,随之而来的是部署门槛的水涨船高:排名靠前的大参数开源模型往往需要多块高端算力卡才能运行,而能在端侧部署的小参数模型又普遍存在推理能力弱、功能单一的问题,很难满足复杂智能体的开发需求。

谷歌此前推出的Gemma系列已经凭借稳定的性能表现,成为全球开发者使用率最高的开源大模型产品之一,本次发布的Gemma4正是瞄准了“性能与部署成本平衡”的市场空白,主打单位参数的效率提升,直接切中了中小开发者和企业级用户的核心痛点。

Gemma4全系列四款产品覆盖了从端侧到云端的全部使用场景,核心技术亮点完全贴合不同用户的需求:

2.3B、4.5B两个高效版模型主打端侧部署,原生支持语音输入,可实现毫秒级的实时语音理解,不需要上传数据到云端就能完成交互,在隐私性要求高的移动端、IoT设备场景优势明显;

26B MoE、31B稠密版两个高性能模型则主打云端推理,逻辑推理与函数调用能力足以驱动复杂的自主智能体工作流。其中31B稠密版在Arena AI文本榜单中位列全球开源模型第三,26B MoE版位列第六。

部署门槛上Gemma4也实现了突破性优化,31B稠密版的非量化权重可直接运行于单块80GB H100显卡,4-bit量化版本甚至兼容普通消费级显卡,普通开发者不需要采购集群算力就能体验前沿大模型能力。

在Gemma4发布之前,绝大多数复杂智能体应用都需要调用闭源大模型API才能实现,不仅成本高,数据安全也存在隐患。Gemma4的出现意味着开发者可以通过本地部署开源模型,完成同等水平的智能体开发,整体成本可降低60%以上。

谷歌相关负责人透露,后续还将推出Gemma4的微调工具链和行业适配套件,面向车载、智能家居、企业办公等场景推出预训练版本,进一步降低AI应用的开发门槛。

(图像由AI生成)

23 分钟前

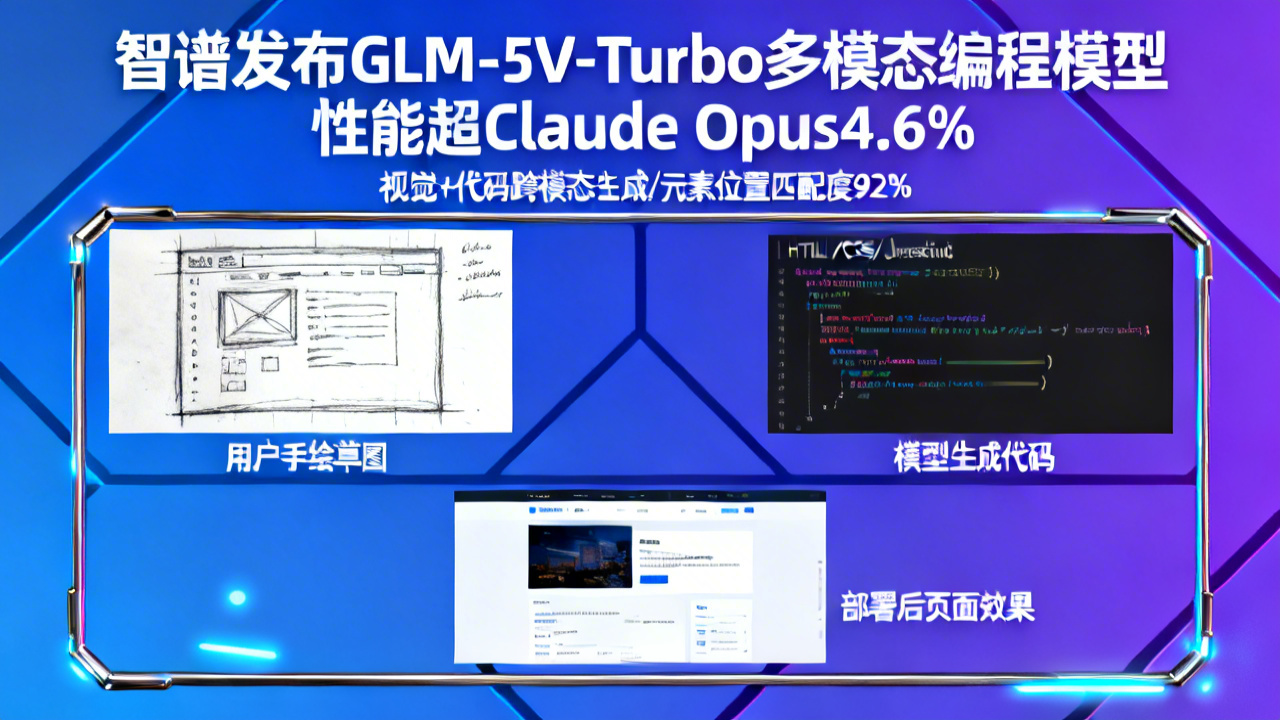

2026年4月2日,国产大模型厂商智谱正式发布旗下首个多模态Coding基座模型GLM-5V-Turbo,该模型具备“视觉+代码”跨模态生成能力,可基于草图、UI设计稿直接生成可运行前端工程,实测视觉编程性能较Claude Opus高出4.6%,是智谱在GLM-5-Turbo之后推出的又一编程类大模型迭代产品。

1 小时前

2026年4月消息,谷歌联合能源公司Crusoe Energy在美国得克萨斯州阿姆斯特朗县投建装机容量933兆瓦的天然气发电厂,为其Goodnight AI数据中心园区供电,项目已于今年1月提交许可并启动建设。电厂投用后年碳排放预计达450万吨,该举动引发行业对谷歌2030年零碳运营承诺能否兑现的广泛质疑。

1 小时前

2026年4月3日,谷歌正式发布新一代开源AI模型Gemma4,放弃此前Gemma系列采用的限制性自定义许可,改用行业通用的Apache2.0开源协议,允许全球开发者自由使用、修改、分发模型并用于商用场景。该模型在性能与生态兼容性上实现双重升级,可大幅降低AI落地的技术与法律门槛。

16 小时前

近日谷歌宣布调整AI Pro订阅服务权益,所有已付费的AI Pro订阅用户无需额外支付费用,即可将原有云存储空间升级至5TB。该订阅服务包含Gemini Advanced大模型使用权限、Google Workspace AI增强功能等权益,本次升级覆盖全球超百万活跃付费用户,预计将进一步提升谷歌AI订阅产品的市场竞争力。

17 小时前

2026年4月2日,智谱正式发布专为视觉编程打造的原生多模态Coding基座模型GLM-5V-Turbo。该模型融合视觉理解与代码生成能力,上下文窗口达200k,可将设计稿、网页界面等视觉信息转化为可运行代码,在多模态编程、GUI Agent等核心基准测试中实现同尺寸模型性能领先,填补了AI Agent从纯字符感知到视觉感知的技术空白。

19 小时前

2026年4月2日,蚂蚁集团AI安全实验室联合清华大学正式开源智能体安全防御插件ClawAegis。该产品是全球首个覆盖OpenClaw全生命周期的安全防护工具,构建了覆盖五大运行阶段的全链路纵深防御体系,可为自主智能体提供多维度、轻量化、即时干预的原生防护能力,系统性解决OpenClaw类框架普及过程中暴露的各类安全风险。

20 小时前

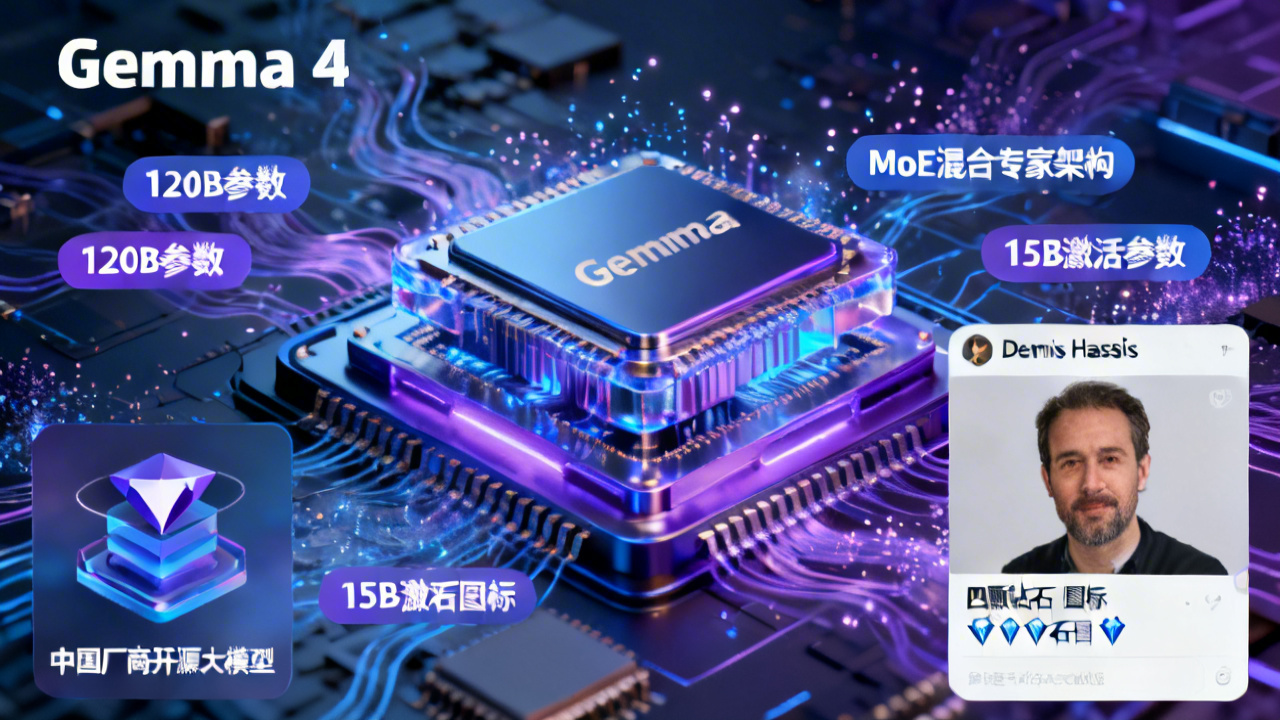

2026年4月,谷歌DeepMind首席执行官Demis Hassabis通过社交平台暗示,新一代开源大模型Gemma 4即将正式发布。该模型参数规模达120B,为上代Gemma 3的4倍,采用MoE混合专家架构,激活参数仅15B,有望在民用级显卡实现本地离线运行。谷歌意在借这款产品,从中国厂商主导的开源大模型市场夺回话语权。

23 小时前

2026年4月2日,字节跳动旗下云服务品牌火山引擎正式开启多模态视频生成模型Seedance 2.0的普通API客户申请通道,标志着该模型从限量邀测阶段转向广泛开放。Seedance 2.0支持文、图、音、视频四种输入模态,具备角色一致性保持、导演级镜头控制等能力,可覆盖短剧、电商营销、影视制作等多场景生产级需求。