2026年4月3日,美团技术团队正式发布原生多模态大模型LongCat-Next,该产品依托自主研发的DiNA(离散原生自回归)架构,突破传统“语言基座+插件”的拼凑式架构局限,实现图像、语音、文本的同源离散Token转化,视觉分词器压缩比达28倍,可原生实现对物理世界的“看”“听”能力,为多模态大模型发展提供了新的技术路径。

在过去两年的多模态大模型研发浪潮中,“语言基座加外挂插件”几乎是所有厂商的标配路线——先用成熟的通用大语言模型做核心,再单独接入视觉、语音的识别模块,通过接口适配实现多模态能力。但这种拼凑式架构的短板也十分明显:模态间数据传输损耗大、跨模态理解精度受限、落地场景的适配成本居高不下。

美团此次推出的LongCat-Next,核心思路就是从底层打破模态之间的壁垒,不再把视觉、语音当成语言基座的外接功能,而是将所有模态的信息统一转化为同源的离散Token,让AI可以用处理文本的同一套逻辑处理图像、语音信息,真正实现原生的“看”“听”能力。

支撑LongCat-Next实现底层突破的核心,是美团自研的DiNA离散原生自回归架构,三大技术特性从根本上重构了多模态建模的逻辑:

一是全模态参数统一,无论输入是文字、图像还是音频,模型都采用同一套参数、注意力机制和损失函数,无需为不同模态单独开发适配模块,大幅降低训练和部署成本。

二是理解与生成能力对称,在统一的数学形式下,模型预测文字Token即为“理解”,预测图像、音频Token即为“生成”,两类任务在训练过程中可形成协同效应,互相提升效果。

三是高保真极致压缩,配套自研的dNaViT视觉分词器支持任意分辨率输入,通过8层残差向量量化实现最高28倍的像素空间压缩,同时完整保留OCR、财报解析等对精度要求较高的任务所需的关键细节,避免压缩导致的信息损耗。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

49 分钟前

近期,由多位OpenAI前核心员工发起的风投基金Zero Shot正式启动,首期基金目标募资规模为1亿美元,目前已完成多个早期项目的投资交割。该基金团队均拥有大语言模型、通用人工智能(AGI)领域的一线研发与产业经验,未来将重点投向AI创新赛道的早期创业项目,填补AGI细分领域的早期投资缺口。

4 小时前

当地时间2026年4月,随着美伊军事冲突持续升级,伊朗方面公开宣称将对与美国存在关联的Stargate AI数据中心发起针对性导弹打击。该事件首次将大规模民用AI算力基础设施直接纳入地缘冲突打击目标范畴,引发全球AI产业对数据中心安全布局的广泛担忧,也对全球AI算力供给稳定性带来潜在冲击。

5 小时前

2026年4月,MIT Technology Review刊发行业报道,经济学家公开呼吁全球启动类“曼哈顿计划”的跨学科专项研究,破解当前AI渗透职场过程中就业影响数据零散、口径不统一的行业痛点,填补大语言模型、生成式AI等技术落地过程中的就业评估空白,为政策制定、企业用工调整、从业者职业规划提供可落地的量化参考依据。

9 小时前

西班牙地理科技创企Xoople近日宣布完成1.3亿美元B轮融资,同步公布与美国国防航天巨头L3Harris的合作协议,双方将联合研发适配Xoople低轨卫星星座的专用光学传感器,打造面向大语言模型、多模态AI训练的高精度全球动态地理数据库,填补AI训练场景下实时高分辨率地理数据供给的市场空白。

11 小时前

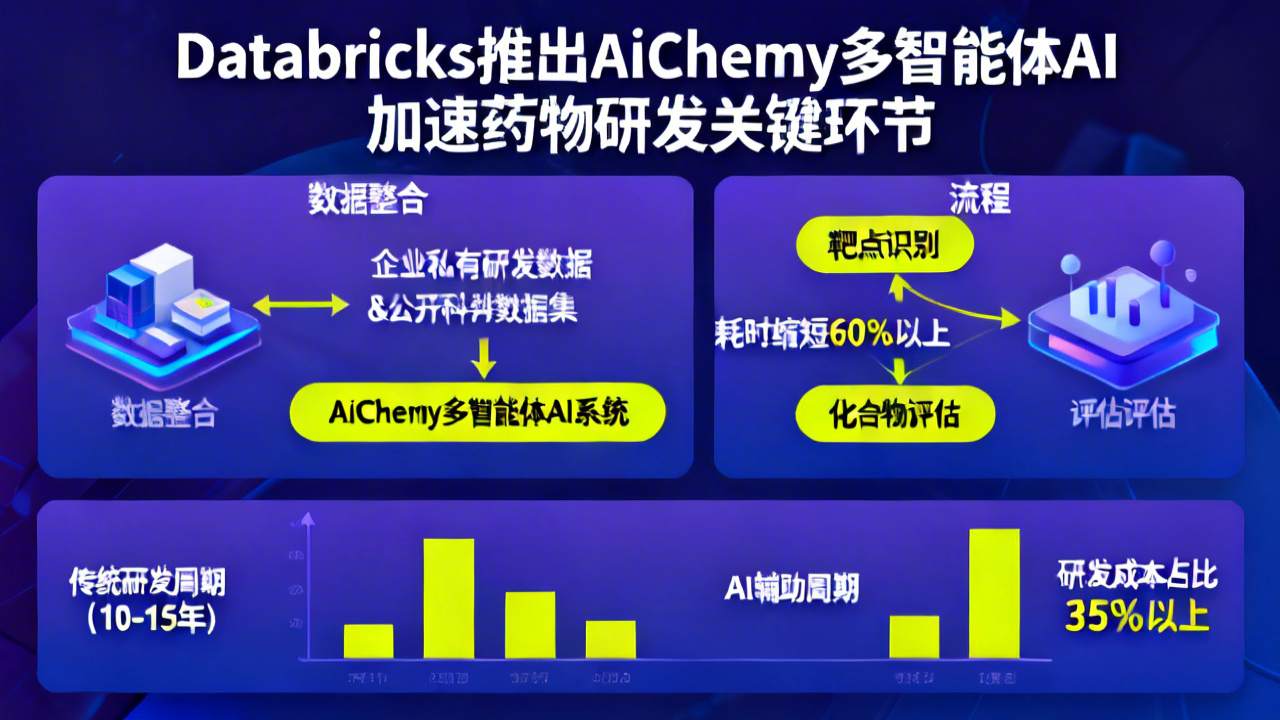

全球数据与AI平台厂商Databricks近日正式推出面向药物研发领域的多智能体AI系统AiChemy,该参考架构可打通企业内部私有研发数据与公开科研数据集,将药物研发早期的靶点识别、化合物评估环节平均耗时缩短60%以上,为生物制药行业的AI落地提供了新的标准化参考方案。

12 小时前

2026年4月最新行业信息显示,阿里巴巴旗下AI选品工具Accio已在美国中小跨境卖家中实现规模化应用,该工具可将原本需要耗时数周的消费趋势调研、竞品分析、供应商筛选等全链路选品工作,压缩至单次聊天对话即可完成,大幅降低卖家运营成本,成为AI落地跨境电商场景的代表性案例。

13 小时前

近期AI领域产业演进趋势显示,多智能体系统正被业内视为继微服务之后的新一代分布式架构范式,类比传统IT领域的微服务架构,多智能体可通过分工协作大幅提升复杂任务处理效率,但调研显示超6成企业在未明确核心业务场景需求的前提下盲目布局,反而额外增加了系统运维与排障成本。

13 小时前

当前生成式AI落地进入深水区,大量企业面临大语言模型(LLM)选型难题,本次梳理的27项核心评估维度,覆盖部署成本、推理性能、场景适配能力、合规性等多个层面,适用于OpenAI、Anthropic、国内厂商等推出的各类LLM产品,可帮助企业快速筛选匹配需求的模型,降低试错成本。