GLM-5全球需求暴增超预期 智谱启动算力合伙人计划

近期全球AI大模型市场热度持续攀升,智谱旗下旗舰大模型GLM-5因全球范围内需求激增,并发访问量突破预设规划上限,引发服务排队、响应延迟及卡顿等问题。为快速破解算力瓶颈、保障用户体验,智谱于2月16日正式对外发布“算力合伙人”招募计划,面向芯片厂商、算力服务商等产业链核心伙伴开放合作通道,试图通过协同布局夯实GLM-5的服务能力。

作为智谱继GLM-4之后推出的下一代旗舰大模型,GLM-5自曝光以来便凭借其在多模态理解、超长上下文处理、复杂逻辑推理等领域的技术突破,吸引了全球企业客户、开发者及AI爱好者的广泛关注。此次需求暴增的背后,既有全球企业加速AI转型、将大模型嵌入业务流程的行业趋势推动,也有GLM-5在预发布阶段展现出的性能优势带来的市场吸引力。据智谱内部人士透露,近期企业用户的API调用量较上月增长超300%,个人用户的对话请求峰值也突破百万量级,远超此前的规划预期,直接导致现有算力集群难以承载,部分场景下用户等待响应时间超过5分钟,严重影响了研发、内容创作、智能客服等多个场景的使用体验。

为快速扭转这一局面,智谱推出的“算力合伙人”计划针对性地瞄准了产业链的两个核心环节。一方面,面向芯片厂商,智谱将开放GLM-5的核心技术接口,邀请合作伙伴共同开展底层优化工作。这意味着芯片厂商可以深度适配GLM-5的推理框架,针对模型的计算逻辑、数据流转路径等进行定制化芯片设计优化,最终打造出软硬一体化的性能标杆。业内人士指出,这种深度合作不仅能提升GLM-5的推理速度、降低单位算力成本,也能为芯片厂商提供旗舰级大模型的真实运行数据,反向推动芯片技术迭代。

另一方面,针对算力伙伴与推理服务商,智谱的合作重点则聚焦于算力资源整合与分发能力提升。拥有大规模、高稳定性算力池的合作伙伴,可将闲置或储备算力接入GLM-5的服务网络,共同承担峰值访问压力;而具备卓越推理分发能力的服务商,则能通过智能调度算法,将用户请求分配至最优算力节点,实现全球范围内的低延迟响应。这种模式打破了传统大模型厂商自建算力集群的单一模式,通过共享算力资源降低了双方的成本投入,同时能更灵活地应对需求波动。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

1 天前

近期微软确认将加大自研AI模型投入,打破此前AI产品线核心能力主要依赖OpenAI技术的合作模式,旗下AI助手Copilot、Azure云AI服务将逐步接入自研大模型,与OpenAI GPT系列、谷歌Gemini系列形成直接竞争。本次自研模型覆盖通用对话、代码生成、多模态处理等场景,预计2025年上半年完成核心产品线适配。

2 天前

2026年4月3日,广汽本田面向纯电车型P7正式推送智导互联4.2.2系统OTA升级,核心升级为全面接入AI大模型,新增支持用户自定义的“声音复刻”功能。升级后车型座舱交互能力大幅提升,可实现旅行攻略自动生成、用车问题智能答疑、自然多轮对话等能力,标志着本田在华纯电车型正式进入大模型原生驱动新阶段。

2 天前

2026年4月3日,小米正式官宣为旗下MiMo大模型推出首个Token订阅套餐,共设Lite、Standard、Pro、Max四档,定价从39元/月到659元/月不等,面向开发者及AI深度兴趣群体提供服务,任意档位订阅均可解锁MiMo家族三大核心模型的调用权限,此举标志着小米AI生态正式进入商业化付费阶段。

2 天前

2026年4月披露的最新规划显示,微软正全面推进AI自主化战略转型,计划2027年推出自研尖端多模态大模型,实现文本、图像、音频处理能力全行业领先,直接对标OpenAI、Anthropic等头部厂商。为支撑该计划,微软已启动英伟达GB200芯片集群部署,未来12-18个月算力将大幅提升,同时仍将维持多元化AI生态布局。

2 天前

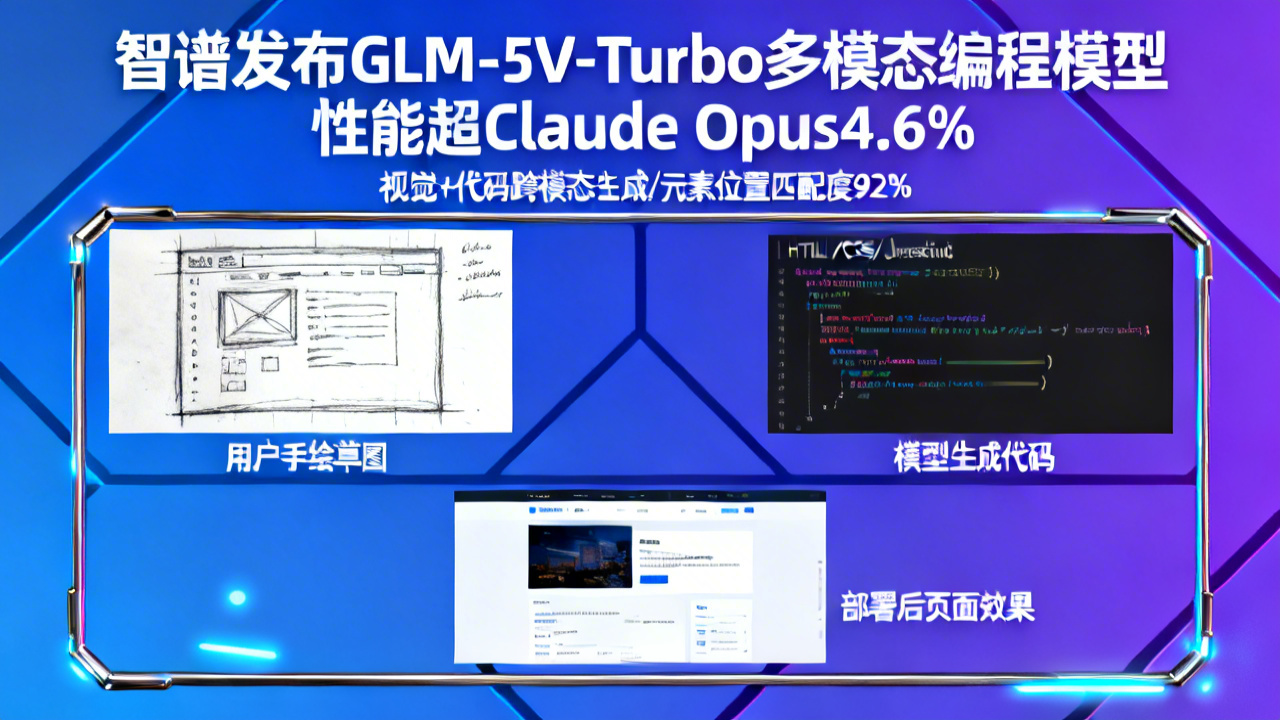

2026年4月2日,国产大模型厂商智谱正式发布旗下首个多模态Coding基座模型GLM-5V-Turbo,该模型具备“视觉+代码”跨模态生成能力,可基于草图、UI设计稿直接生成可运行前端工程,实测视觉编程性能较Claude Opus高出4.6%,是智谱在GLM-5-Turbo之后推出的又一编程类大模型迭代产品。

3 天前

2026年4月2日,智谱正式发布专为视觉编程打造的原生多模态Coding基座模型GLM-5V-Turbo。该模型融合视觉理解与代码生成能力,上下文窗口达200k,可将设计稿、网页界面等视觉信息转化为可运行代码,在多模态编程、GUI Agent等核心基准测试中实现同尺寸模型性能领先,填补了AI Agent从纯字符感知到视觉感知的技术空白。

3 天前

2026年4月2日,国内大模型厂商智谱正式推出专为视觉编程场景打造的多模态Coding基座模型GLM-5V-Turbo。该模型实现视觉与编程能力深度融合,支持图片、视频、设计稿、复杂文档版面识别,上下文窗口达200k,在多模态编程、GUI Agent核心基准测试中性能领先于同类产品,可大幅拓展AI Agent的感知边界。

4 天前

2026年4月,AI大模型研发商Anthropic在清理平台上泄露的自家源代码过程中出现操作失误,提交的下架申请误伤数千个无关GitHub开源仓库。Anthropic高管随后公开承认事故为人为操作导致,已第一时间撤销绝大多数不当下架通知,目前GitHub已逐步恢复所有被误下架仓库的正常访问权限。