2026年3月25日,苹果公司联合威斯康星大学麦迪逊分校发布全新AI训练框架RubiCap,主打优化密集图像描述模型训练流程,通过创新强化学习机制破解传统标注成本高、合成数据泛化能力弱的行业痛点,性能超越体量10倍的同类产品,可应用于视觉语言模型训练、文生图优化、无障碍工具升级等多个领域。

你有没有过这样的体验:用AI工具识别图片内容时,它只会给出“桌子上放着食物”这类模糊的描述,却无法说出“白色瓷盘里装着三块撒了糖霜的柠檬挞、旁边还摆着一杯加了薄荷叶的气泡水”这类细节?这种差距,正是计算机视觉领域长期待补的短板——密集图像描述技术的落地难点。

所谓密集图像描述,是区别于传统单句图像标注的计算机视觉技术:后者只需要生成一句描述图片整体内容的文字,前者则需要识别出图片中的所有局部区域,为每个独立物体、场景细节生成对应的精准文字说明,技术复杂度高出数个量级。

这项技术是当前AI领域的核心基础能力之一,不管是训练多模态大模型、优化文生图的细节准确率,还是升级视障群体使用的无障碍图像识别功能,都离不开高质量的密集图像描述能力。但长期以来,该领域的训练一直面临两难困境:人工标注一张图片需要标注数十个区域,成本是普通图像标注的10倍以上;而用现有大模型生成合成标注的替代方案,又容易出现内容同质化问题,训练出的模型泛化能力极差,遇到陌生场景就频繁出错。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

8 小时前

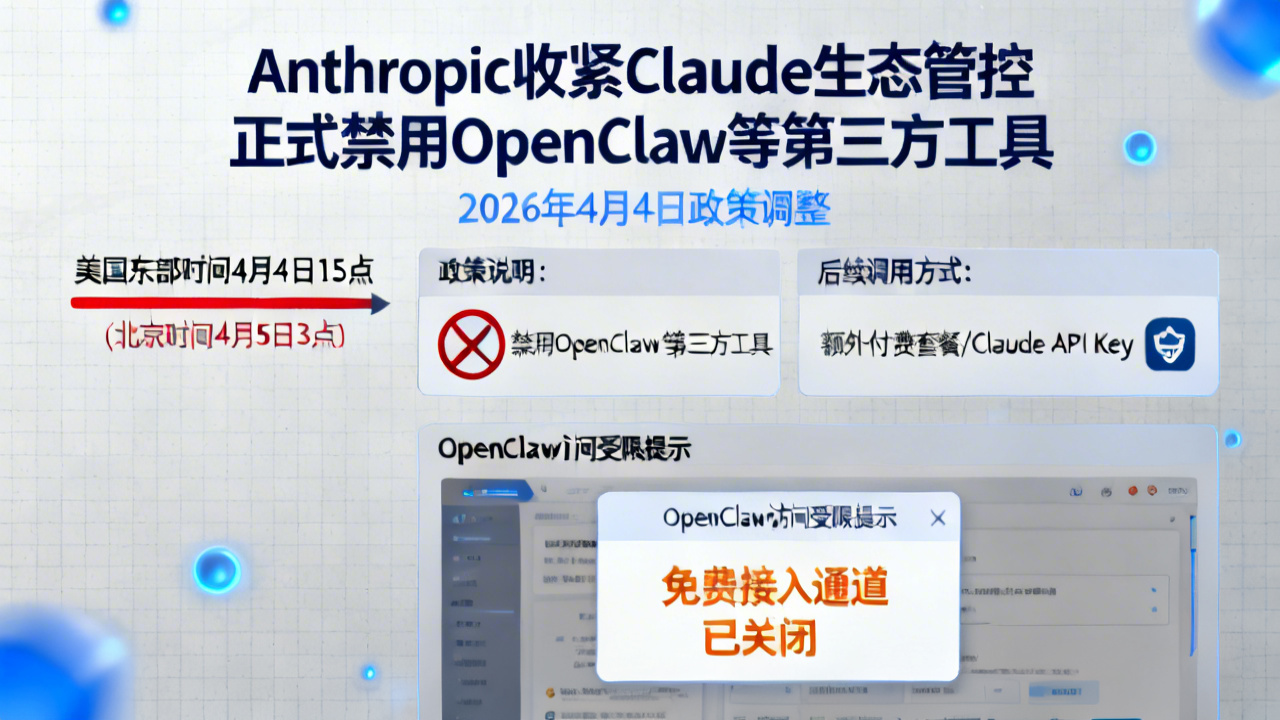

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

14 小时前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

14 小时前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

14 小时前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。

14 小时前

近期Anthropic源代码泄露事件中,安全研究者发现针对其旗下代码大模型Claude Code的新型prompt逃逸攻击路径,可绕过内容安全审查执行违规操作,而该类漏洞此前Anthropic公开表示已完成修复。目前该漏洞可导致代码生成环节出现恶意植入、数据泄露等风险,Anthropic尚未就新漏洞给出官方回应。

14 小时前

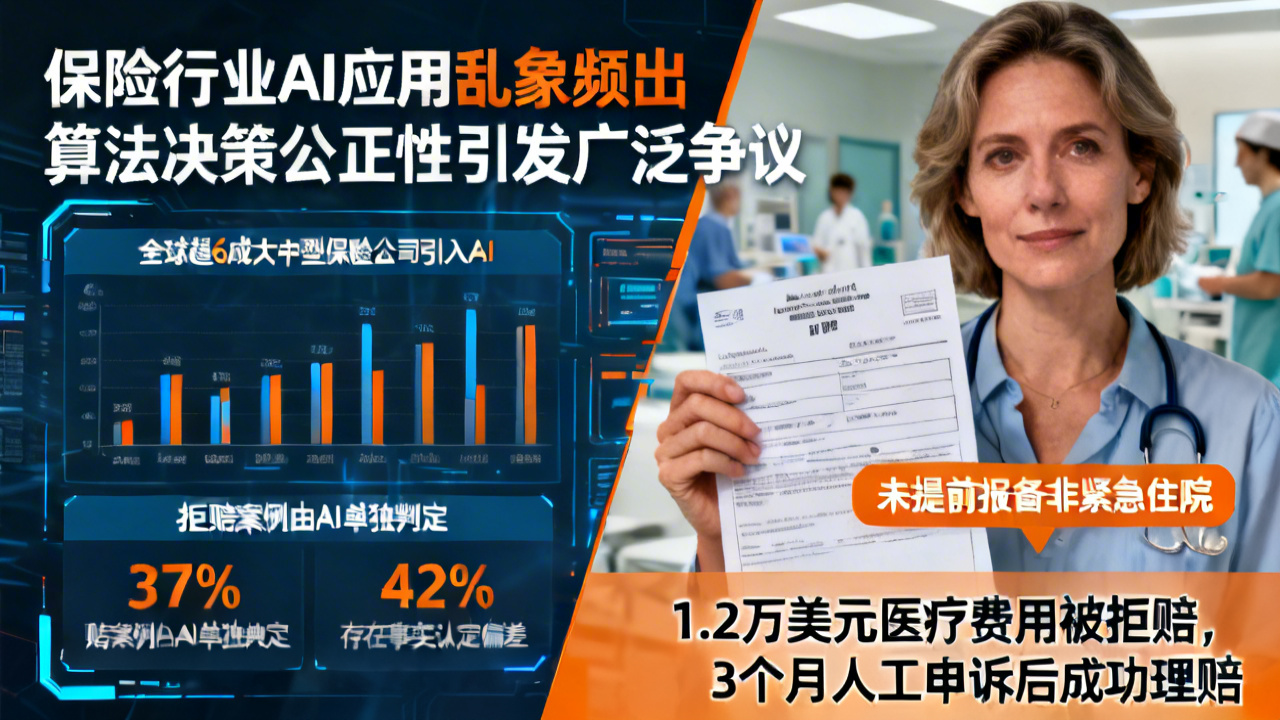

美国科技媒体Digital Trends近期发布的行业调查显示,全球已有超6成大中型保险公司引入AI系统负责核保风控、理赔核查等核心业务环节。美国消费者权益组织2024年调研数据显示,37%的拒赔案例由AI算法单独判定,其中42%存在事实认定偏差,相关算法决策的公正性问题已引发多国监管部门重点关注。

14 小时前

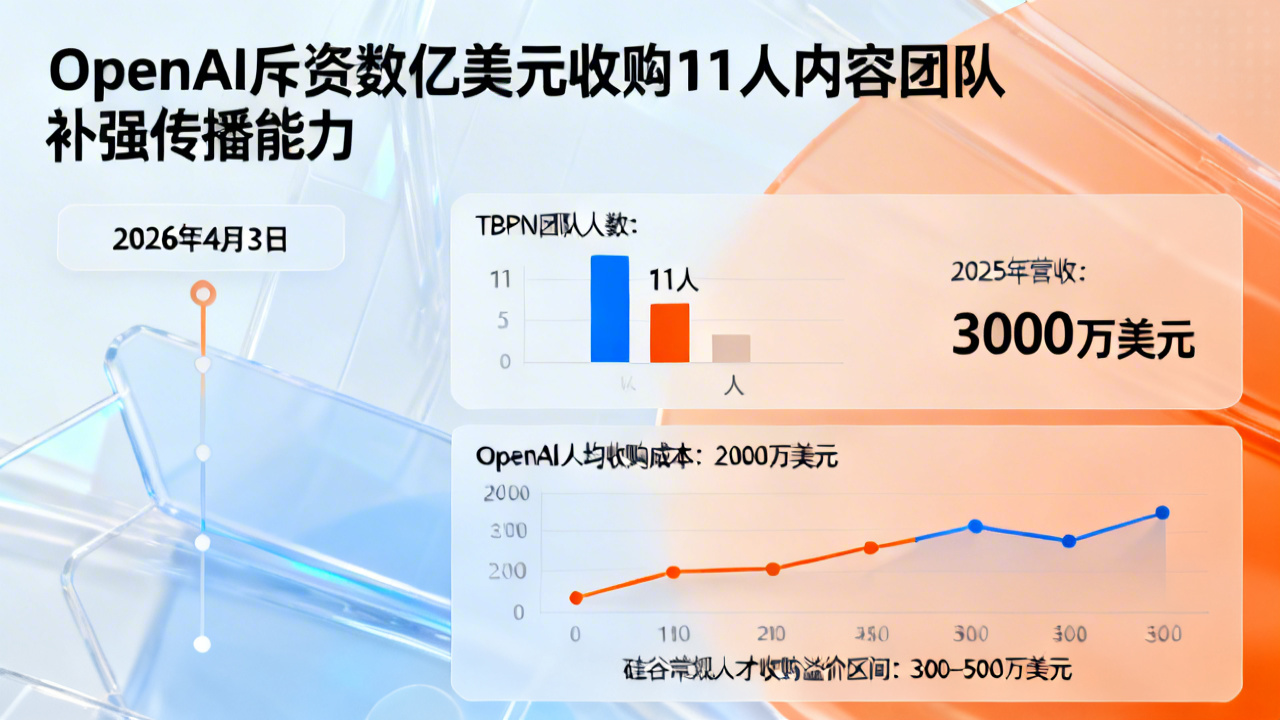

2026年4月3日,全球人工智能头部企业OpenAI宣布完成对美国科技访谈节目运营商TBPN的收购。据英国《金融时报》知情人士披露,本次收购对价达小几亿美元,标的团队仅11人,2025年全年营收达3000万美元。本次交易是OpenAI强化对外传播能力、重塑公众叙事体系的核心战略布局,也是2026年开年以来AI领域金额最高的内容生态类收购案。

14 小时前

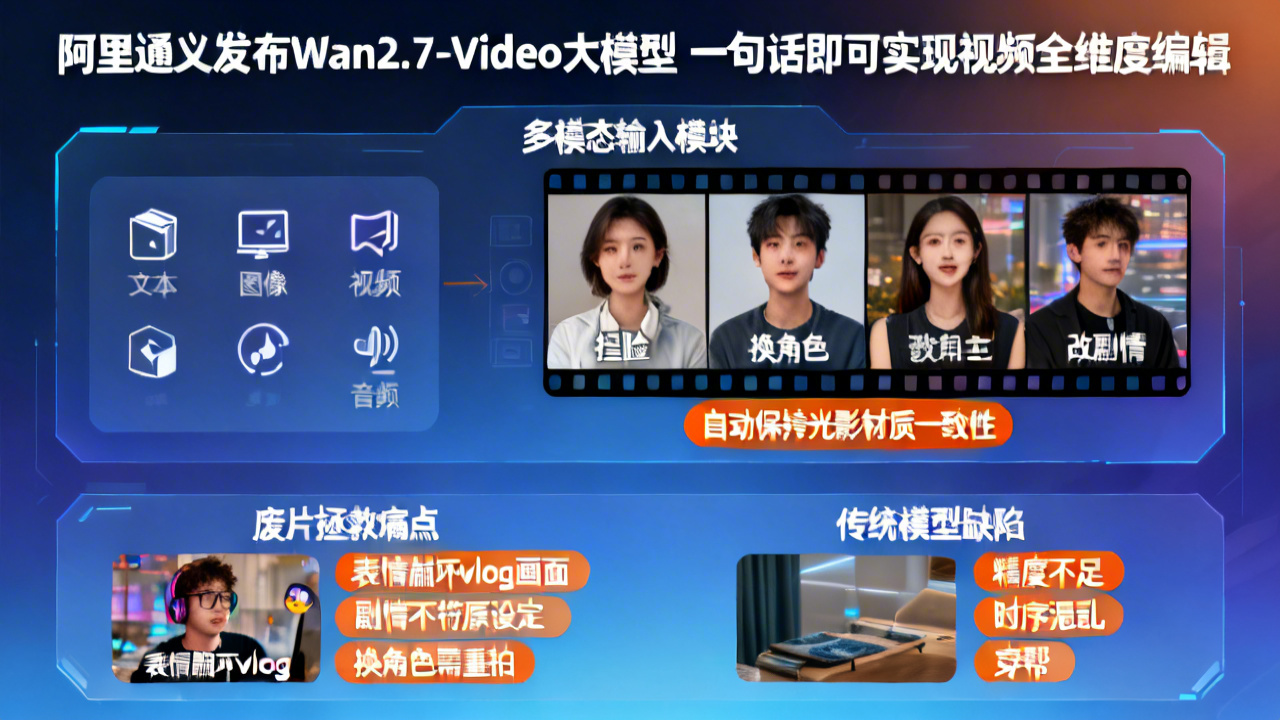

2026年4月3日,阿里通义实验室正式发布视频创作大模型Wan2.7-Video,该模型支持文本、图像、视频、音频全模态输入,可实现从画面结构、局部细节到时序剧情的多维度编辑,用户仅需输入自然语言指令即可完成捏脸、换角色、改剧情等操作,同时自动保持光影材质一致性,大幅降低专业视频创作门槛。