近日科技媒体Techradar发布最新研究报告,针对美、英、加、法、德、西六国超1.2万名消费者的调查显示,滥用生成式AI的深度伪造语音诈骗正全球激增:25%美国受访者过去一年接到过仿冒熟人声音的伪造来电,24%人群无法从听感辨别真伪,55岁以上老年群体人均损失达1298美元,此类诈骗年复合增长率达16%,多国已发布相关风险预警。

“妈,我开车撞了人现在急需要赔医药费,你赶紧转3万块到这个账户里”,不少接到这类电话的中老年用户刚听到子女熟悉的声音就慌了神,压根没想到电话那头的“亲人”,其实是AI生成的伪造语音——这类此前仅在网络安全报告中被提及的新型攻击手段,如今已经成为普通民众身边高频发生的诈骗风险。

和传统话术诈骗需要反复演练、寻找目标人群漏洞不同,AI深度伪造语音诈骗的门槛已经降到了历史低点。诈骗分子仅需花费几十元购买公开的生成式AI语音克隆工具,扒取目标对象发布在社交媒体的1-2分钟公开语音素材,就能生成几乎以假乱真的模拟语音,甚至可以搭配车祸噪音、警方背景音等场景音效,进一步迷惑受害者。

此次调查数据显示,约25%的美国受访者在过去12个月内接到过此类AI伪造来电,24%的受访者明确表示无法通过听感区分真人发音与AI伪造语音,而此类诈骗的案发量正以每年16%的复合增长率持续上升,已经覆盖欧美多个发达国家。

在所有受害群体中,55岁以上的中老年人受到的威胁最大。报告数据显示,这一群体对AI技术的认知程度普遍较低,接到亲属求助类电话时往往优先考虑家人安全,很少主动核实信息真伪,加上该群体的平均储蓄额高于年轻群体,人均经济损失已经达到1298美元,是18-35岁年轻受害者的3倍。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

16 小时前

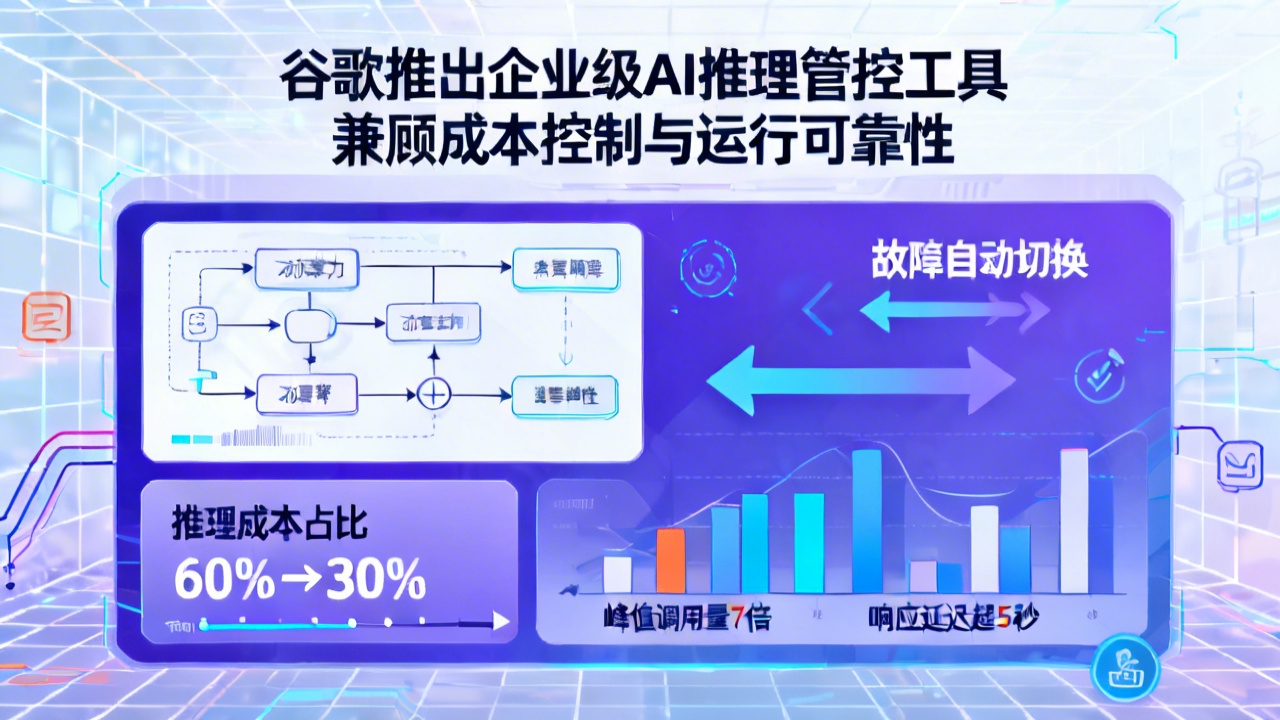

谷歌近日面向企业级客户发布全新AI推理管控套件,针对当前企业部署大模型时平均推理成本占AI总支出60%以上、峰值时段服务可用性不足92%的行业痛点,提供动态算力调度、故障自动切换等功能,可帮助企业将推理环节综合成本降低30%左右,同时大幅提升生成式AI服务的运行稳定性。

16 小时前

2026年4月,人工智能头部企业OpenAI官宣最新一轮高管架构调整:首席运营官布拉德·莱特卡普(Brad Lightcap)将卸任原有职务,转任公司内部全新设立的“特殊项目”部门负责人;首席营销官凯特·劳奇(Kate Rouch)因癌症治疗将暂时离岗,待身体康复后回归。本轮调整是OpenAI 2026年首次公开的核心管理层变动,引发行业对其新业务布局的广泛关注。

16 小时前

前Facebook核心内容安全团队成员创立的AI治理服务商Moonbounce于近日完成1200万美元融资,其核心产品AI控制引擎可将平台内容审核政策转化为统一、可预测的AI行为判定标准,解决当前AI时代多模态内容审核标准混乱、一致性差的行业痛点,该笔融资将主要用于技术研发与客户场景拓展。

1 天前

美国科技巨头微软于2026年4月推出三款全新基础大模型,上述产品由微软旗下成立仅6个月的MAI团队研发,覆盖语音转文字、音频生成、图像生成三大核心能力,直指当前多模态AI赛道主流竞品,旨在进一步扩大微软在全球生成式AI市场的话语权,与OpenAI、谷歌DeepMind等厂商展开直接竞争。

2 天前

国际开源Java开发框架Spring正式推出Spring AI专属开发套件,支持开发者沿用Spring原生开发约定,无需额外学习Python栈AI开发技术,即可快速搭建可落地的Java语言AI Agent,据官方测试数据,同复杂度AI Agent的开发周期可缩短62%,目前该工具包已面向全球开发者开放正式版下载。

2 天前

2026年4月2日,中国广播电视社会组织联合会演员委员会发布严正声明,明确禁止AI换脸、声纹克隆、未经授权抓取演艺数据训练模型等七类AI侵权行为,强调标注“非商用”“个人二创”也不能构成免责依据。此前已有谷江山、边江、季冠霖等近百位配音演员集体抵制AI声音克隆,此次声明标志着演艺行业AI治理进入协同监管新阶段。

2 天前

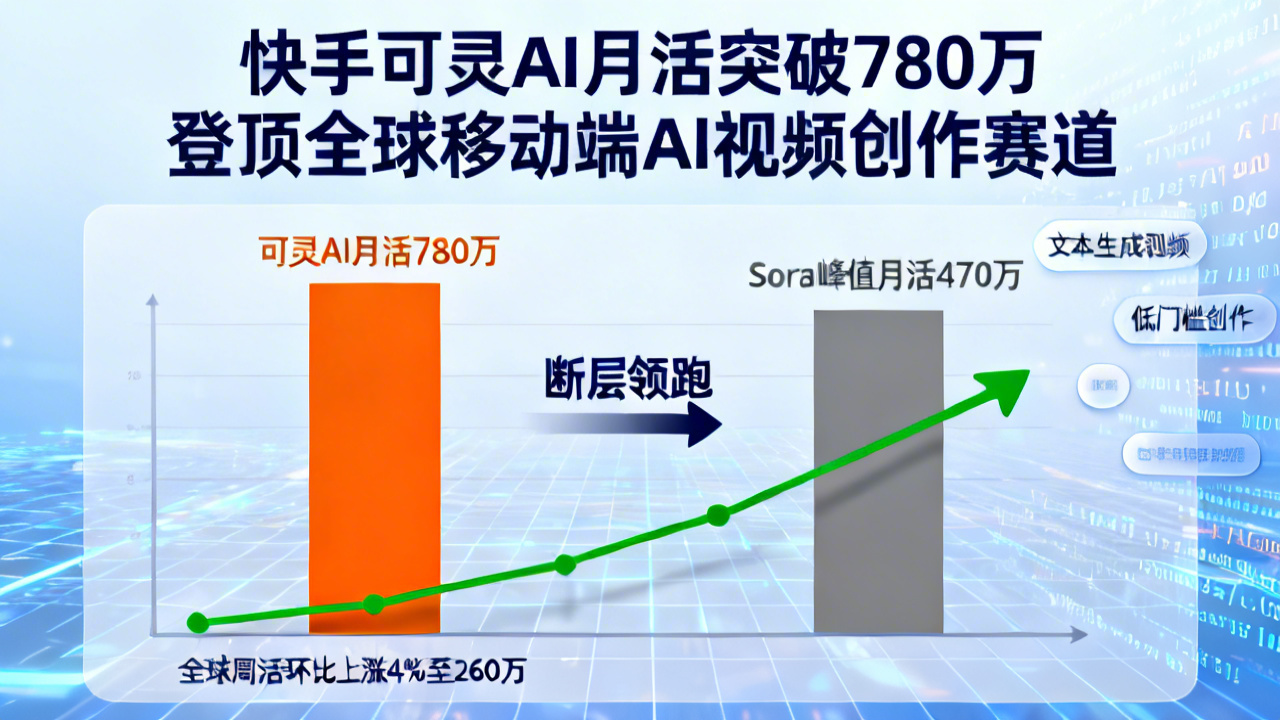

2026年4月第三方机构Sensor Tower公布的最新数据显示,快手旗下AI视频创作工具可灵AI2026年3月移动端月活跃用户达780万,远超OpenAI此前关停的Sora峰值470万月活,断层领跑全球移动端AI视频赛道,仅上周其全球周活环比上涨4%至260万,在Sora离场带来的市场真空下,凭借技术优势和低门槛体验快速抢占C端用户市场。

2 天前

2026年4月2日,知名模特七海Christ公开发声维权,指控短剧《桃花簪》未经授权使用AI换脸技术将其面部移植到剧中反派角色上,相关侵权片段分布在第11至13集,涉及虐待等负面情节,已严重损害其个人名誉与商业价值。目前七海Christ已完成证据保全,要求片方停止侵权、公开道歉并赔偿损失,事件引发行业对AI技术滥用边界的广泛讨论。