美国AI初创企业Anthropic与五角大楼的合作引发广泛争议,TechCrunch旗下Equity播客将其作为典型案例,深度探讨AI国防应用的伦理边界、初创企业追逐联邦合同的潜在风险,以及该事件给全球AI创业圈带来的警示。

在AI创业圈的叙事里,拿下美国联邦政府尤其是五角大楼的合同,一度是技术实力与商业价值的双重证明——不仅能获得稳定的大额资金支持,更能借助官方场景为技术背书,打开To B市场的大门。但Anthropic的遭遇,却让这份“荣耀”露出了残酷的另一面。

当Anthropic宣布与五角大楼达成合作协议时,曾被解读为AI安全技术切入国防领域的标志性突破——这家以“构建可解释、可控的大语言模型”为核心定位的初创,此前一直将AI伦理安全放在首位。然而,合作消息传出后,不仅内部员工发起联名反对,外界也质疑其是否背离了“AI服务人类福祉”的初衷。

TechCrunch旗下Equity播客将这一事件列为近期核心议题,主持人指出,Anthropic的困境并非个例:越来越多AI初创在资本压力下,将联邦合同视为“快速变现”的捷径,却忽略了政府需求与自身技术价值观的潜在冲突。

对AI初创企业而言,联邦合同的诱惑力显而易见:单份合同金额往往是商业订单的数倍,还能获得国防部等机构的技术数据支持,甚至能跳过部分市场验证环节直接落地。但这份“蜜糖”背后,隐藏着多重隐形陷阱。

首先是严苛的合规要求:联邦政府对AI技术的应用场景、数据安全有近乎苛刻的标准,初创企业往往需要投入大量人力物力进行合规改造,甚至可能因此延误核心产品的研发节奏。其次是伦理与舆论风险:一旦技术被用于军事或敏感领域,很容易引发公众对“AI武器化”的担忧,进而影响企业的品牌声誉和商业客户信任。更重要的是,部分联邦合同可能包含“技术独占”条款,限制初创企业将相关技术应用于民用市场,束缚长期发展空间。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

10 小时前

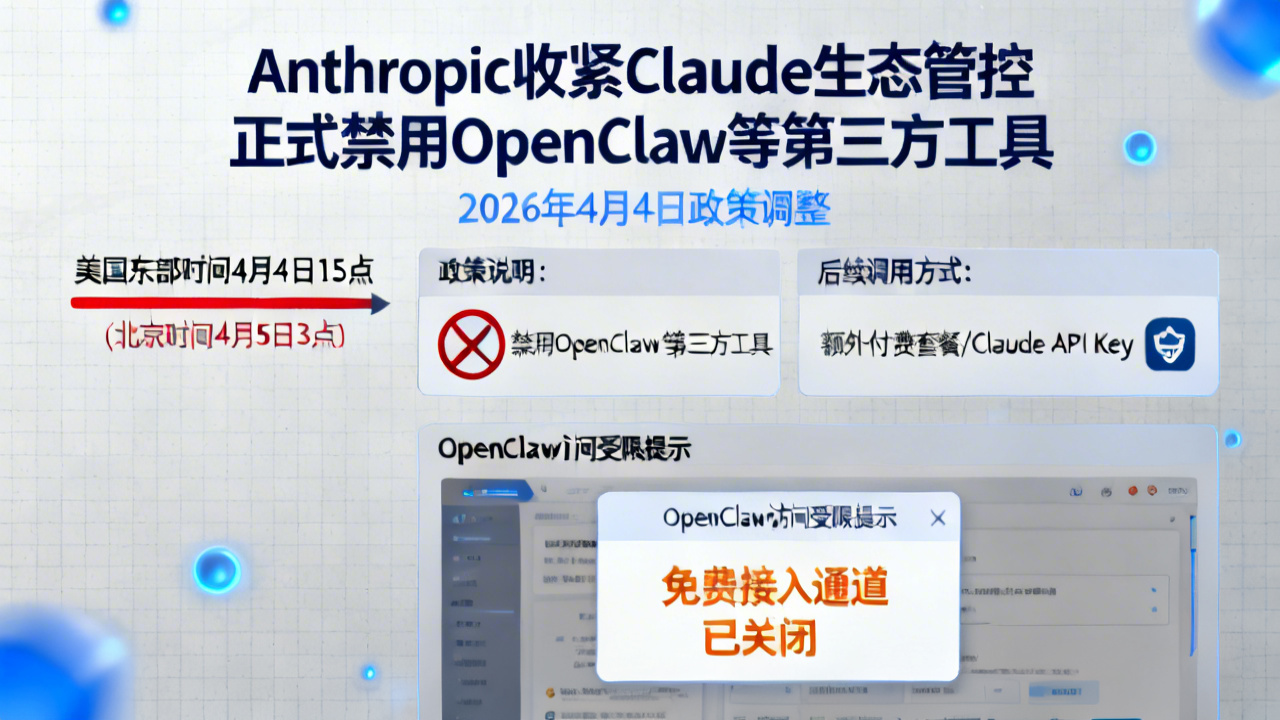

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

11 小时前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。

16 小时前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

17 小时前

2026年美国中期选举进入倒计时阶段,头部大模型企业Anthropic近日宣布成立全新政治行动委员会(PAC),计划定向支持认同其分级AI监管、算力资源倾斜、AIGC版权保护等政策议程的议员候选人。此次动作是头部AI企业从技术研发向政策上游延伸的标志性事件,也意味着全球AI行业的政策博弈进入白热化阶段。

17 小时前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

17 小时前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。

17 小时前

近日,AI大模型企业Anthropic宣布为旗下对话式AI产品Claude推出Windows平台本地交互能力,新版本可直接跨应用调取用户邮件、本地存储的各类文档,还能自主执行系统级任务操作。据官方披露,该功能可将文档整理、日程响应类办公流程的处理效率提升45%,无需用户手动上传文件即可完成复杂指令。

17 小时前

近期Anthropic源代码泄露事件中,安全研究者发现针对其旗下代码大模型Claude Code的新型prompt逃逸攻击路径,可绕过内容安全审查执行违规操作,而该类漏洞此前Anthropic公开表示已完成修复。目前该漏洞可导致代码生成环节出现恶意植入、数据泄露等风险,Anthropic尚未就新漏洞给出官方回应。