Transformer核心作者Illia Polosukhin针对AI智能体凭证泄露等安全痛点,推出全新开源安全框架IronClaw,替代原有存在风险的OpenClaw。IronClaw采用Rust语言开发,通过加密存储凭证、WASM沙箱隔离工具执行、可信执行环境部署等技术,彻底解决AI智能体“裸奔”问题,目前已支持macOS、Linux、Windows多系统本地或云端部署。

当越来越多AI智能体依赖OpenClaw处理凭证与工具调用时,一场安全危机正悄然蔓延——大量用户密码、API密钥等敏感信息直接暴露给LLM,甚至工具执行权限完全不受限制,相当于让AI智能体在网络中“裸奔”。

作为曾经广泛使用的AI智能体基础框架,OpenClaw采用TypeScript开发,设计上存在先天安全缺陷:凭证直接交付给AI智能体、工具在主系统环境中运行,没有任何隔离措施。一旦LLM被恶意诱导,敏感数据可能瞬间泄露,甚至主系统会被恶意工具执行攻击。Transformer核心作者Illia Polosukhin正是注意到这一普遍存在的安全风险,决定从零开始重构一款安全级的替代方案。

IronClaw被定位为OpenClaw的安全重构版本,从底层架构到部署环境全链路强化安全特性,与旧框架形成了本质差异:

核心语言升级为Rust,借助Rust的内存安全特性,从代码层面降低缓冲区溢出、数据越界等常见漏洞风险,为框架筑牢底层安全防线。

凭证处理实现加密隔离,用户密码、API密钥等敏感信息被加密存储在独立区域,LLM完全无法直接访问,仅能通过系统授权后的安全接口调用对应功能,从根源上杜绝凭证泄露。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

4 小时前

近期,科技巨头微软针对旗下AI助手Copilot发布官方用户提示,明确不建议用户在高风险场景下过度依赖该工具。作为微软过去5年重点布局的核心AI产品,Copilot已覆盖Windows系统、Office办公套件、Azure云服务等全产品线,此前累计投入相关研发推广资源超100亿美元,此次态度转向引发AI产业对通用助手落地边界的广泛讨论。

21 小时前

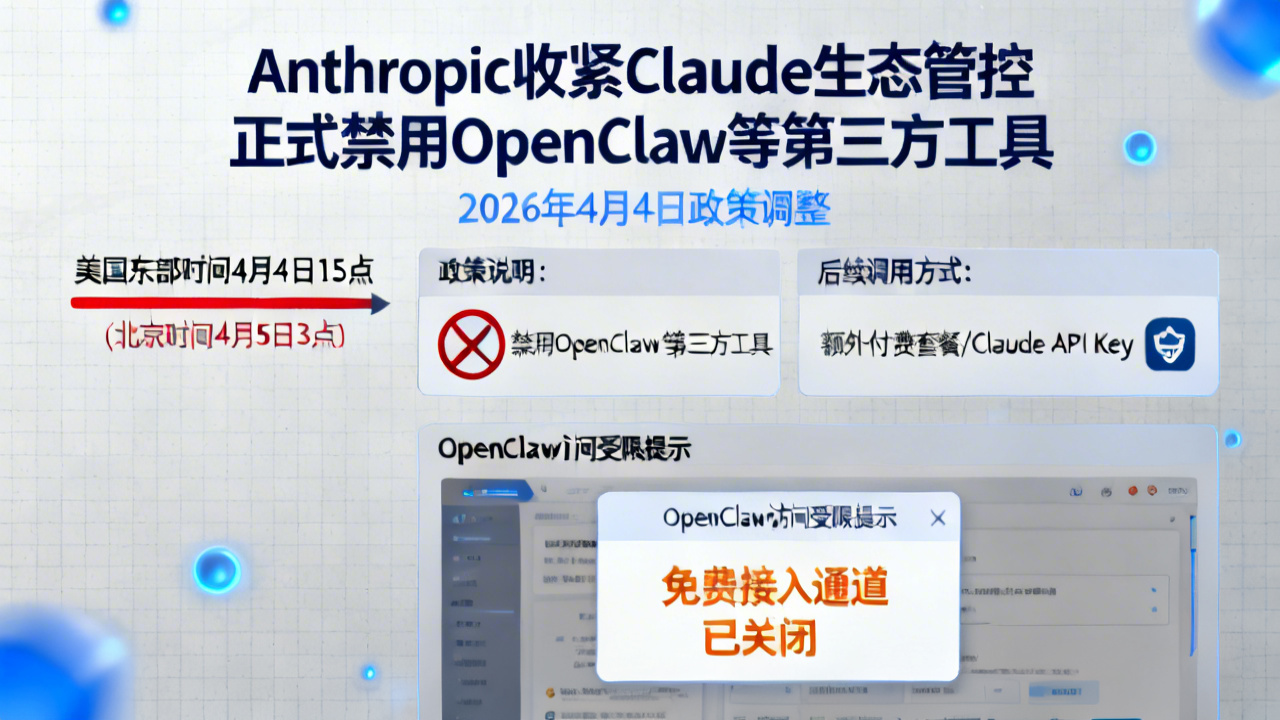

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

23 小时前

2026年4月4日消息,据外媒VentureBeat报道,在2026年RSAC全球顶级网络安全大会上,Cisco、Palo Alto Networks、Cato Networks、CrowdStrike四家头部网安厂商发布AI智能体安全方案,但均未推出企业急需的统一紧急关停功能。当前全球超58万个OpenClaw智能体实例暴露在公网中,现有治理手段仅靠补丁修复,存在极高安全风险。

1 天前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

1 天前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

1 天前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。

1 天前

近期Anthropic源代码泄露事件中,安全研究者发现针对其旗下代码大模型Claude Code的新型prompt逃逸攻击路径,可绕过内容安全审查执行违规操作,而该类漏洞此前Anthropic公开表示已完成修复。目前该漏洞可导致代码生成环节出现恶意植入、数据泄露等风险,Anthropic尚未就新漏洞给出官方回应。

1 天前

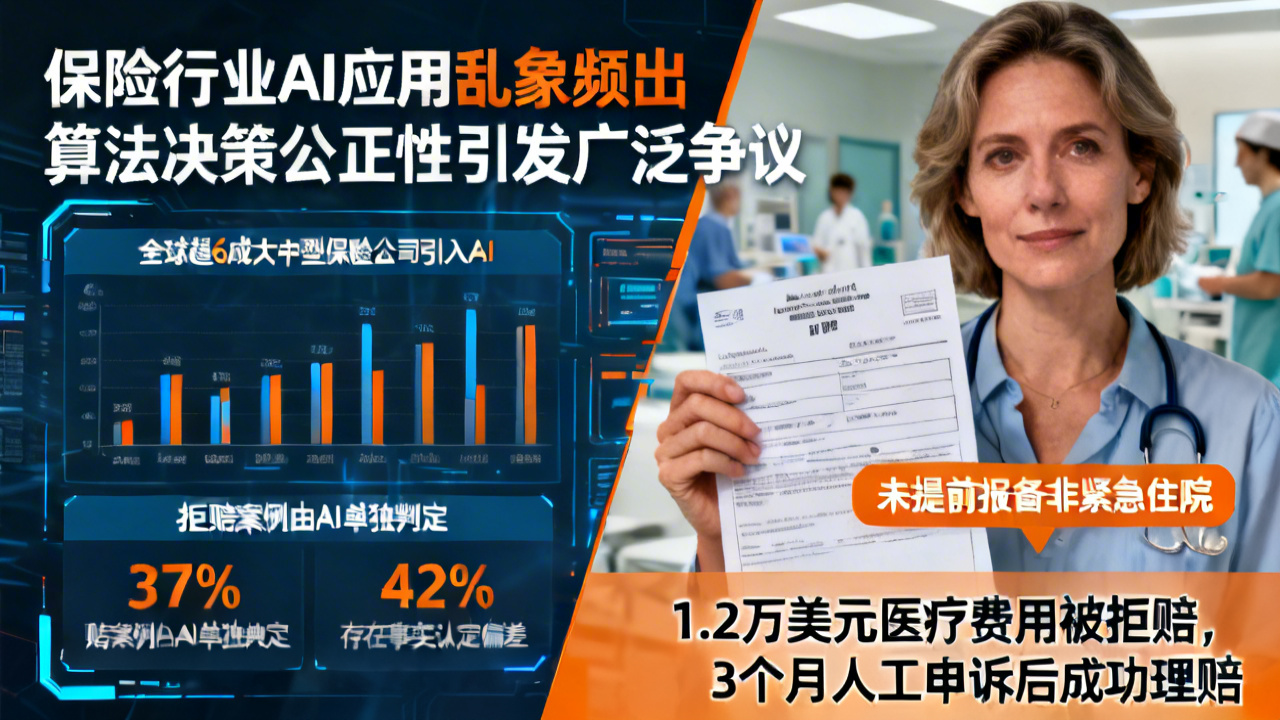

美国科技媒体Digital Trends近期发布的行业调查显示,全球已有超6成大中型保险公司引入AI系统负责核保风控、理赔核查等核心业务环节。美国消费者权益组织2024年调研数据显示,37%的拒赔案例由AI算法单独判定,其中42%存在事实认定偏差,相关算法决策的公正性问题已引发多国监管部门重点关注。