3月2日,阿里通义实验室正式发布Fun-CosyVoice3.5与Fun-AudioGen-VD两款语音大模型,首次支持FreeStyle自然语言指令交互,实现“一句话生成语音”的自由体验。其中Fun-CosyVoice3.5新增4个语种支持,通过强化学习技术将生僻字读错率从15.2%降至5.3%,首包延迟降低35%。

想象一下,无需设置复杂的音色标签、语调参数,只需说出“用慵懒的印尼语念一首热带小诗,背景混着海浪声”,就能直接生成符合要求的语音内容——这正是通义实验室最新发布的FreeStyle语音大模型带来的全新体验。

此前,多数语音生成模型依赖预设的音色、语调、语种等标签参数,用户需要在有限选项中组合调整,难以实现个性化的自由表达。而此次发布的两款模型均支持FreeStyle自然语言指令,用户只需用日常语言描述需求,就能触发深度交互,真正实现“一句话自由生成语音”的愿景。这种模式将语音生成的门槛从“专业参数设置”拉低至“自然语言表达”,为普通用户打开了语音内容创作的大门。

作为语音复刻与多语种表达的核心模型,Fun-CosyVoice3.5在原有基础上完成了两大关键升级。一方面,新增泰语、印尼语等4个语种支持,进一步拓展了多语种语音生成的覆盖范围,满足跨区域内容创作的需求;另一方面,通过引入DiffRO与GRPO强化学习技术,模型的精细化表达能力大幅提升:生僻字读错率从15.2%直接降至5.3%,首包延迟降低35%,既保证了专业文本的朗读准确性,又优化了实时交互的流畅度。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

21 天前

2026年4月2日,阿里通义实验室正式推出大语言模型Qwen3.6-Plus,聚焦解决AI智能体编程任务执行不稳定的核心痛点。该模型现已通过阿里云百炼API开放调用,默认支持100万字符上下文窗口,模型尺寸不足K2.5、GLM-5的一半,在前端生成、代码修复等场景编码能力领先国内同尺寸模型。

22 天前

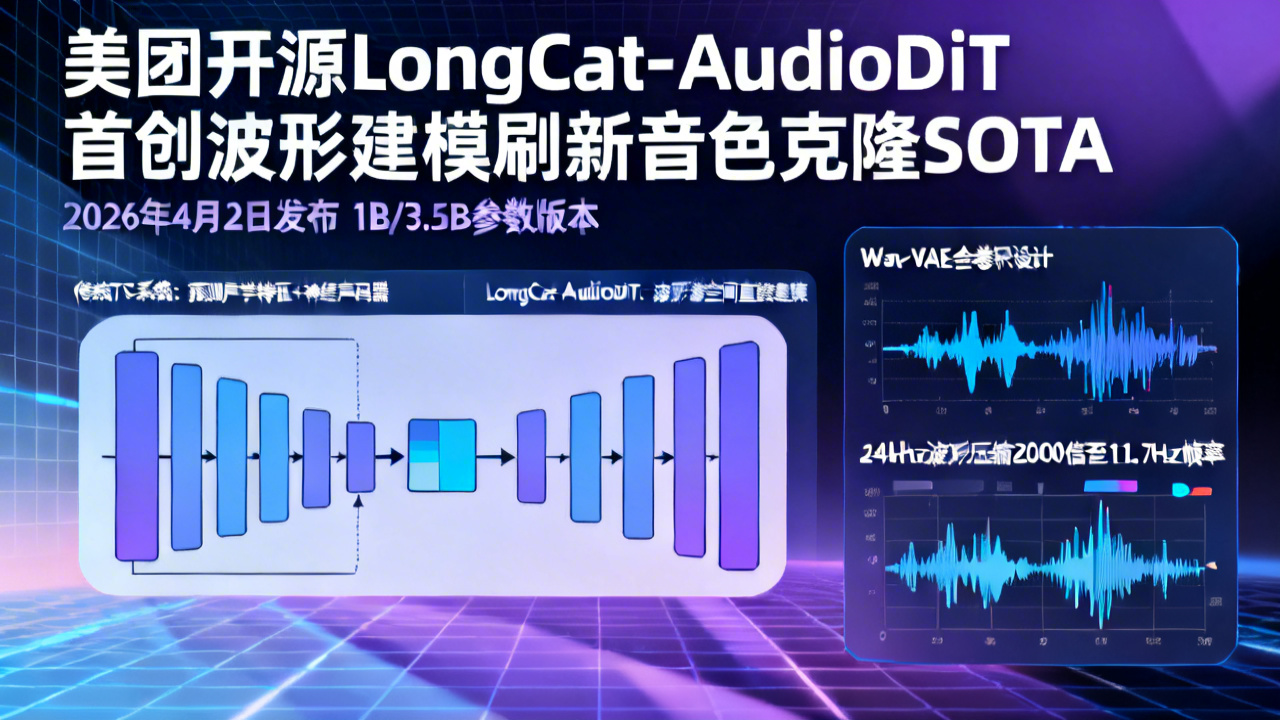

2026年4月2日,美团LongCat团队正式发布并开源端到端音频生成模型LongCat-AudioDiT,提供1B、3.5B两个参数版本。该模型首创波形潜空间直接建模架构,摒弃传统TTS系统的梅尔频谱中间表征,搭载全卷积设计的Wav-VAE可将24kHz波形压缩2000倍至11.7Hz帧率,大幅降低信息损耗与误差累积,成功刷新零样本音色克隆性能SOTA。

24 天前

2026年3月31日,阿里巴巴通义实验室正式推出新一代全模态大模型Qwen3.5-Omni。该模型采用原生全模态架构及Hybrid-Attention MoE底层架构,可无缝处理文本、图像、音频、视频输入,在音视频分析、推理、翻译等多领域测试中拿下215项SOTA,音频理解能力全面超越谷歌Gemini-3.1Pro,推动AI从屏幕助手向物理世界智能体演进。

1 个月前

2026年3月24日,阿里通义实验室正式推出全新视频生成音频框架PrismAudio,通过引入分解式思维链机制,实现AI先解析视频内容逻辑再生成匹配音效,可彻底解决行业长期存在的音画错位、声不对位问题,相关研究成果已被顶级AI学术会议ICLR2026收录,将大幅提升AIGC视频内容的用户沉浸感。

1 个月前

2026年3月16日,IBM正式发布专为边缘计算与企业级部署打造的紧凑型多模态语音大模型Granite 4.0 1B Speech。该模型参数量仅为前代产品的50%,性能实现显著跃升,新增日语自动语音识别、关键词偏置功能,英文转录准确率大幅提升,目前已支持6种主流语言的语音识别与双向互译。

1 个月前

2026年3月16日,阿里云旗下通义实验室正式开源国内首个影视级多场景配音多模态大模型Fun-CineForge。该模型针对传统AI配音情绪表达不足、口型匹配度低、多人对话音色混乱等痛点,实现口型同步、情绪匹配、音色统一、毫秒级时间对齐四大核心能力,首次攻克影视场景多人对话配音的核心难题,可大幅降低影视、动画内容的制作成本。

1 个月前

近日,通义实验室发布两款支持FreeStyle指令生成的语音大模型Fun-CosyVoice3.5与Fun-AudioGen-VD。其中Fun-CosyVoice3.5新增4个语种支持,通过技术优化将生僻字读错率从15.2%降至5.3%,首包延迟降低35%;Fun-AudioGen-VD则聚焦场景化声音建模,两款模型为语音AI的精细化应用与场景拓展提供了新可能。

1 个月前

近日,阿里通义实验室语音团队推出两款全新语音生成模型——Fun-CosyVoice3.5与Fun-AudioGen-VD。其中Fun-CosyVoice3.5升级语音理解力,新增4种语言支持并将首包延迟降低35%;Fun-AudioGen-VD可实现音色定制、角色模拟等功能,两款模型均支持FreeStyle指令,大幅降低语音创作门槛,将为播客、游戏等领域提供AI助力。