近日,AI初创公司DeepSeek正式发布多模态大模型DeepSeek-V2,在MMBench、MMLU等12项全球权威基准测试中跻身Top2,其中跨语言多模态任务得分超越GPT-4V。该模型采用万亿级稀疏参数的MoE架构,支持文本、图像、音频多模态输入输出,将为智能客服、工业质检、内容创作等场景提供高效底层技术支撑。

在MMBench中文多模态测试集上,DeepSeek-V2的准确率达到95.1%,比GPT-4V高出3.2个百分点——这一数据让不少业内人士感到意外,毕竟在此之前,全球多模态大模型的第一梯队长期被OpenAI、谷歌等巨头垄断。

与传统稠密大模型不同,DeepSeek-V2采用了稀疏混合专家模型(MoE)架构,万亿级参数中仅有约1/10的专家会参与单次推理,既保证了模型的能力边界,又大幅降低了推理成本。据DeepSeek技术团队透露,模型在训练阶段融合了10亿+多模态样本,其中近40%为中文本地化数据,包括中文图文配对样本、方言音频文本、工业场景图像等,这也是其在中文场景下表现领先的关键。

此外,DeepSeek-V2还优化了多模态对齐算法,实现了文本与图像的细粒度语义匹配,比如在识别一张带有中文说明书的工业零件图像时,模型能精准提取说明书上的参数要求,并判断零件是否符合标准,这一任务的准确率比GPT-4V提升了9个百分点。

作为一家成立于2022年的AI初创公司,DeepSeek此前凭借代码大模型DeepSeek-Coder打开市场,在GitHub等平台收获了超过100万开发者用户。此次发布多模态大模型,是其从垂直赛道转向通用AI领域的关键一步。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

8 小时前

最近针对美国12-18岁青少年的调研显示,近62%的受访对象使用过ChatGPT、Google Gemini、DeepSeek等AI产品的陪伴类功能,超过3成受访青少年会向AI倾诉不愿告知家长、同学的私密情绪,AI正成为Z世代社交版图中不可忽视的新角色,相关行为也引发了学界对青少年社交模式变化的广泛讨论。

9 小时前

近日,AI智能剪辑工具ClipMake正式启动公开测试,其搭载自研多模态视频理解大模型,可将长素材自动剪辑为适配多平台的短视频内容,剪辑效率较传统人工操作提升82%,支持抖音、小红书、YouTube等12个海内外主流内容平台的尺寸、字幕风格、黄金开头自动优化,公测上线3天累计注册用户已突破2.1万,引发内容创作领域广泛关注。

1 天前

近期,科技巨头微软针对旗下AI助手Copilot发布官方用户提示,明确不建议用户在高风险场景下过度依赖该工具。作为微软过去5年重点布局的核心AI产品,Copilot已覆盖Windows系统、Office办公套件、Azure云服务等全产品线,此前累计投入相关研发推广资源超100亿美元,此次态度转向引发AI产业对通用助手落地边界的广泛讨论。

1 天前

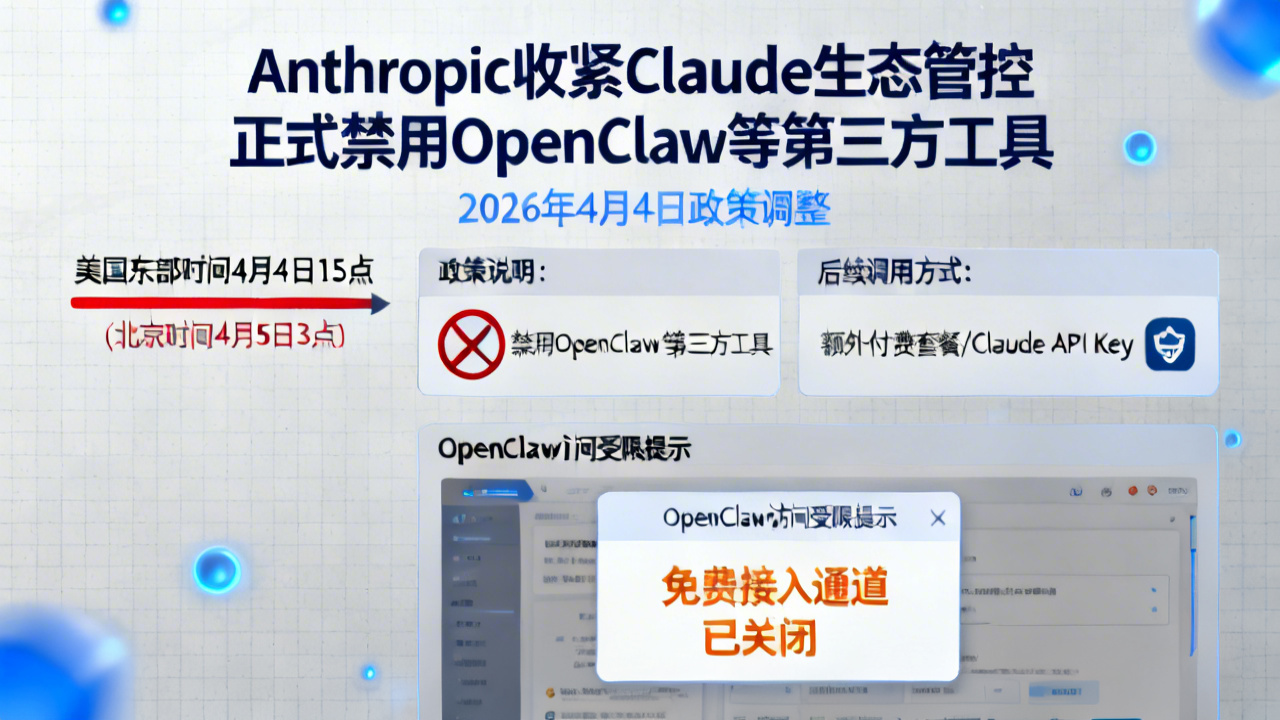

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

2 天前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

2 天前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

2 天前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。

2 天前

近期Anthropic源代码泄露事件中,安全研究者发现针对其旗下代码大模型Claude Code的新型prompt逃逸攻击路径,可绕过内容安全审查执行违规操作,而该类漏洞此前Anthropic公开表示已完成修复。目前该漏洞可导致代码生成环节出现恶意植入、数据泄露等风险,Anthropic尚未就新漏洞给出官方回应。