Taalas硬连线技术破局 跑DeepSeek R1创每秒12000tokens吞吐纪录

近期,成立仅2.5年的AI芯片初创公司Taalas公布一项关键技术突破:其基于“硬连线”技术打造的算力集群,在运行DeepSeek R1大模型时实现每秒12000tokens的吞吐速度,创下行业新纪录。不同于主流芯片厂商依赖SRAM集成的加速路径,Taalas选择将AI模型直接固化在硅片中,试图从底层解决大模型部署的延迟与成本痛点。

在AI智能体应用加速落地的当下,大模型推理的延迟问题正成为行业发展的核心瓶颈。无论是实时对话机器人、智能座舱的语音交互,还是工业场景下的AI决策辅助,动辄数百毫秒甚至数秒的响应延迟,不仅严重影响用户体验,更制约了智能体在高实时性场景的规模化应用。与此同时,依赖GPU集群部署大模型的高昂成本,也让不少中小企业望而却步——据行业测算,训练一个千亿参数模型的成本超千万美元,日常推理的算力开销更是持续走高,成为AI规模化落地的隐形门槛。

正是瞄准这两大痛点,Taalas走出了一条与主流厂商截然不同的技术路线。传统的AI芯片加速方案,比如Cerebras的Wafer Scale Engine或Groq的Tensor Streaming Processor,核心思路是通过集成超大容量SRAM,减少数据在内存与计算单元之间的传输频次,从而提升推理速度。但这类方案本质上仍是通用硬件适配AI模型,无法彻底消除“硬件-软件”适配带来的延迟损耗,在极端实时场景下仍存在性能瓶颈。

而Taalas提出的“硬连线”技术,则是将AI模型的参数与计算逻辑直接固化在硅片的物理电路中。简单来说,就是把大模型的“思考框架”刻进芯片里,而不是让芯片临时加载模型参数进行计算。这种设计跳过了数据在内存和处理器之间的反复搬运,让计算过程更接近“原生硬件级”运行,因此能实现极致的低延迟和高吞吐。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

20 小时前

2025年开年以来,微软Copilot、Google Gemini、Apple Intelligence等头部科技公司AI助手迭代速度较2024年提升47%,DeepSeek、Perplexity、xAI旗下Grok等初创团队产品月活纷纷突破千万级,OpenAI GPT-5相关研发进度也首次进入公开测试阶段,全球消费级AI应用市场正式进入落地竞速期。

1 天前

2026年4月8日,国内大模型厂商DeepSeek正式推送网页端与App端全新对话界面,新增快速模式与专家模式双选项,替代原有单一默认对话模式。其中快速模式支持识别图片、文件文字,最多可同时处理50个文件,但暂不具备原生视觉理解能力,本次专家模式的优异实测表现也引发市场对其V4版本即将发布的猜测。

1 天前

2026年4月,国内大模型厂商DeepSeek旗下新一代基座模型DeepSeek V4开启灰度测试,本次升级覆盖底层架构、交互逻辑与多模态能力三大维度,推出快速版、专业版、视觉版三大分支,其中专业版疑似采用创始人梁文锋团队提出的全新记忆架构,视觉版本可支持图像、视频高精度分析任务。

1 天前

2026年4月8日,国内大模型厂商DeepSeek正式上线全新模式分层功能,推出可自由切换的快速模式与专家模式。前者适配日常对话场景,支持图片、文件文字识别且响应速度快;后者专注复杂专业问题处理,实测token吞吐效率优异,目前暂不支持多模态能力,高峰时段用户可能需要排队等待,另有传闻其尚未公开的视觉模式也在筹备中。

1 天前

全球出行巨头Uber近期宣布扩大与亚马逊云科技(AWS)的合作协议,将把派单算法、运力预测等更多核心网约车业务模块迁移至亚马逊自研AI芯片集群运行。此次合作被行业视作Uber对原有云服务商Oracle、谷歌云的直接替代,也是亚马逊自研芯片在ToB云服务市场拿下的又一标杆客户案例,进一步撼动了英伟达在AI加速硬件市场的主导地位。

2 天前

4月7日,AI大模型厂商Anthropic官方披露其年化收入(ARR)已突破300亿美元,首次反超竞争对手OpenAI同期250亿美元的年化收入水平。该公司2025年末年化收入仅为90亿美元,3个多月内收入规模大涨约210亿美元,同时同步官宣最新AI芯片采购大单,引发全球AI产业对大模型商业化格局的广泛讨论。

2 天前

2026年4月,欧洲头部人工智能企业Mistral AI联合创始人兼CEO Arthur Mensch访韩期间,与三星电子副董事长兼CEO全永铉及核心高层会晤,双方重点围绕AI半导体存储芯片供应链、技术协同方案展开磋商。Mistral AI正寻求稳定XPU算力芯片供应以支撑模型迭代,三星在高带宽内存...

2 天前

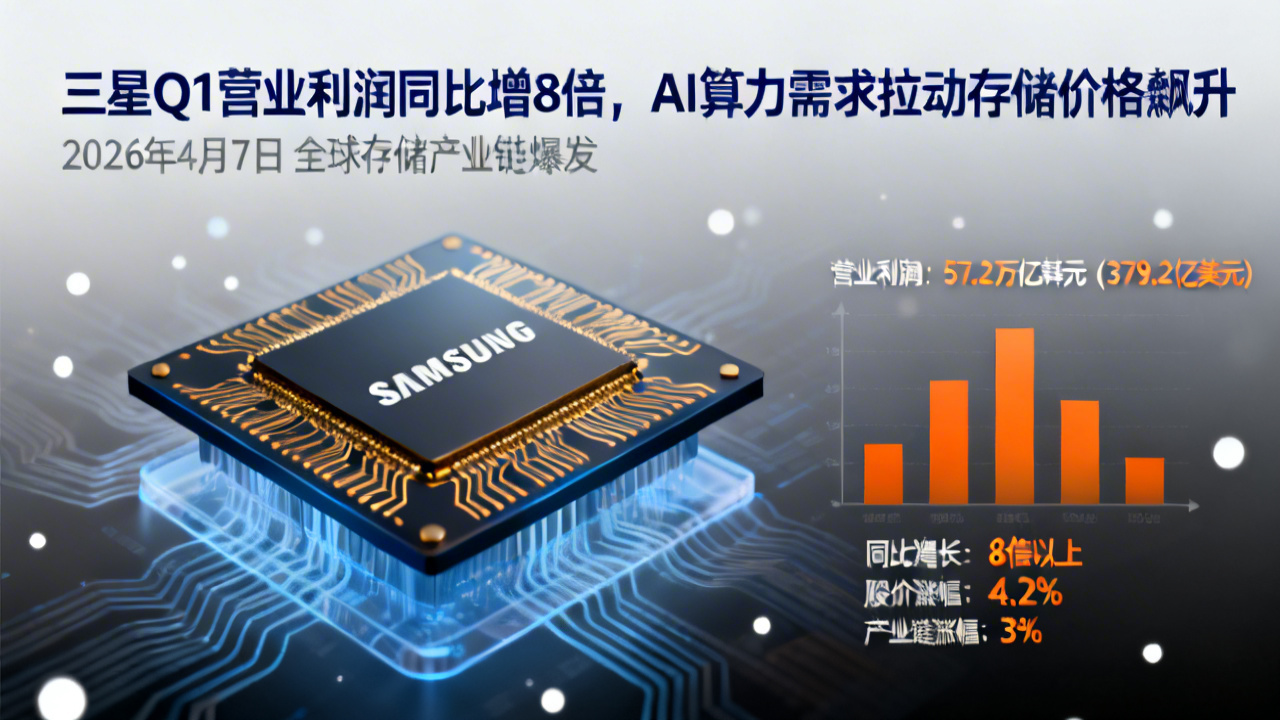

2026年4月7日,全球存储巨头三星电子发布2026年第一季度初步业绩预告,预计营业利润达57.2万亿韩元(约合379.2亿美元),较去年同期增长8倍以上,远超分析师预期的40.6万亿韩元。此轮业绩暴涨核心动力为生成式AI基础设施建设带来的存储芯片需求激增,存储价格大幅上涨推动行业彻底走出此前的下行周期。