京东开源48亿参数JoyAI-LLM-Flash,突破大模型规模化瓶颈

2月14日,京东在全球知名AI开发者社区Hugging Face正式开源最新大语言模型JoyAI-LLM-Flash。这款模型以48亿总参数搭配3亿激活参数的轻量化设计,历经20万亿文本Token预训练,在知识理解、逻辑推理及编程能力上表现突出,更凭借自研FiberPO优化框架突破混合专家模型(MoE)规模扩展不稳定的行业痛点,实现吞吐量1.3-1.7倍的显著提升。

2月14日的开源动作,是京东在大模型高效能落地赛道上的一次重磅输出。不同于行业中单纯追求参数规模或极致轻量化的路径,JoyAI-LLM-Flash选择了“大总参储备+小激活参运行”的平衡策略:48亿总参数让模型得以通过20万亿文本Token的预训练沉淀海量前沿知识,覆盖科技、金融、编程等多个领域;而仅3亿的激活参数,又极大降低了推理阶段的算力消耗,为中小开发者和企业级场景的快速部署扫清了成本障碍。

在核心技术层面,JoyAI-LLM-Flash最引人关注的是全新FiberPO优化框架的应用——这是业内首次将数学领域的纤维丛理论引入大模型强化学习训练。传统MoE模型在规模扩展时,常因不同专家模块的协作失衡出现训练震荡、性能波动的问题,而纤维丛理论为模型的专家分配机制搭建了一套严谨的数学约束体系,让每个输入Token都能更精准地匹配对应专家模块,从底层逻辑上解决了规模化不稳定的顽疾。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

11 天前

2026年3月,苹果iPhone 17 Pro成功实现4000亿参数大语言模型本地运行,该机型仅配备12GB LPDDR5X内存,远低于此类模型常规运行所需的200GB内存门槛。本次突破依托Flash-MoE闪存流转技术与混合专家模型架构实现,目前模型生成速度为0.6 token,为端侧超大模型落地提供了全新技术参考路径。

1 个月前

3月3日,阿里千问核心负责人林俊旸宣布离职,这位32岁的阿里最年轻P10告别其一手主导的Qwen项目。距其离职仅两天,阿里刚完成旗下AI品牌统一为“千问”并开源相关大模型,此次人事变动引发行业热议,此前有分析直指阿里大模型在智能体布局、代码能力及基础设施壁垒层面存在战略误判。

1 个月前

阿里巴巴除夕夜开源千问Qwen3.5 全新架构重塑AI应用效能 2月16日,阿里巴巴对外宣布,新一代通义千问大模型Qwen3.5将于除夕夜正式开源。作为千问系列的核心迭代产品,Qwen3.5最大的突破在于完成了人工智能架构的全面创新,旨在进一步提升AI技术的落地应用效果与场景适配灵活性,此举也...

1 个月前

京东开源48亿参数JoyAI-LLM-Flash,轻量化大模型赛道再迎新玩家 2月14日,京东在全球知名AI开源平台Hugging Face正式推出其最新研发的大模型JoyAI-LLM-Flash。这款总参数达48亿、激活参数仅3亿的轻量化模型,历经20万亿文本Token预训练,凭借独创的Fi...

1 个月前

京东开源JoyAI-LLM-Flash大模型 48B参数配高效激活架构 2月14日,京东在Hugging Face平台开源JoyAI-LLM-Flash大模型,这款模型以48B总参数+3B激活参数的独特设计,在20万亿文本Token预训练底座支撑下,展现出强劲的前沿知识理解、推理及编程...

4 小时前

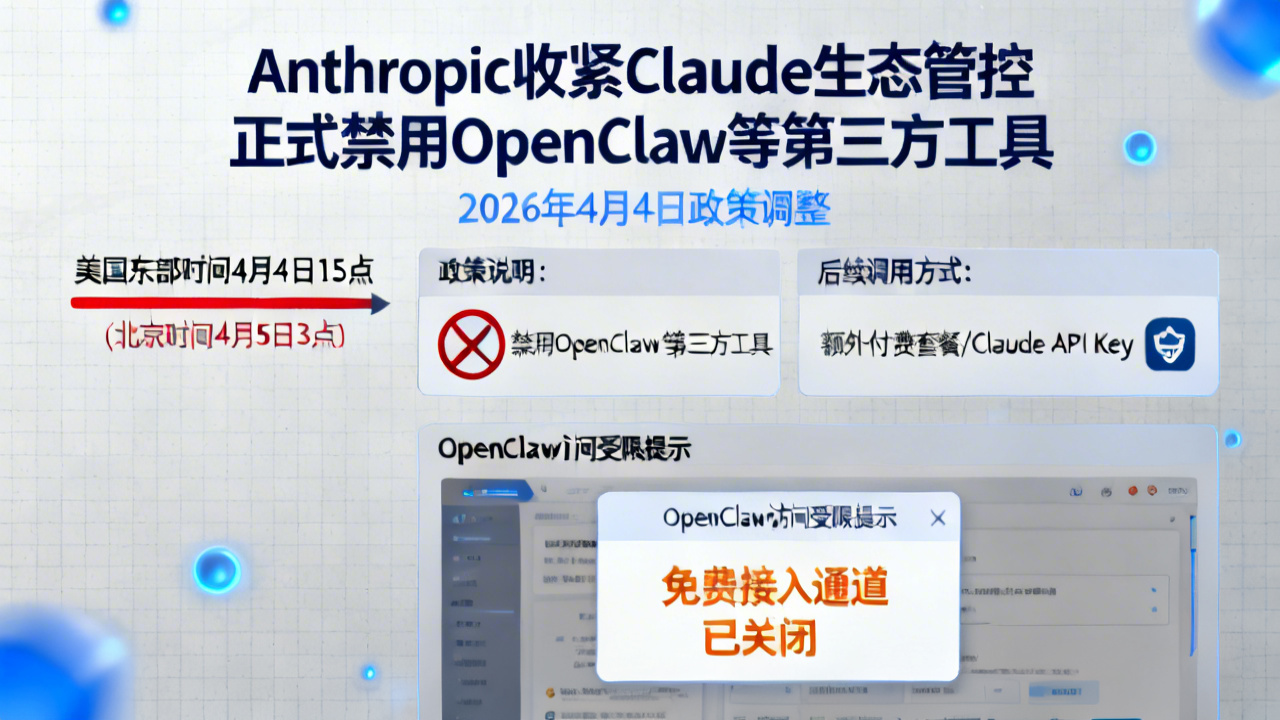

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

5 小时前

2026年4月4日消息,据外媒VentureBeat报道,在2026年RSAC全球顶级网络安全大会上,Cisco、Palo Alto Networks、Cato Networks、CrowdStrike四家头部网安厂商发布AI智能体安全方案,但均未推出企业急需的统一紧急关停功能。当前全球超58万个OpenClaw智能体实例暴露在公网中,现有治理手段仅靠补丁修复,存在极高安全风险。

5 小时前

Rainmaker Securities总裁Glen Anderson最新披露,当前全球私人股权二级市场活跃度创下历史峰值,AI创企Anthropic成为最受追捧的交易标的,同赛道头部企业OpenAI交易热度出现明显下滑,而SpaceX临近的IPO计划,或将对整个一级科技创投市场的资金流向产生颠覆性影响。