Anthropic聘哲学博士塑造Claude道德体系 探索AI伦理新路径

估值3500亿美元的头部AI公司Anthropic正在用一种非技术路径探索AI伦理落地:聘请牛津哲学博士阿曼达·阿斯克尔为旗下聊天机器人Claude打造专属道德体系与人格。不同于传统的代码调试或参数优化,阿斯克尔通过持续对话与提示词设计赋予Claude明辨是非的能力,这一“数字灵魂”塑造计划,为大模型伦理对齐提供了人文驱动的全新视角。

在大模型技术竞速的当下,AI伦理的核心议题始终是“如何让AI输出符合人类的价值观与道德准则”。此前行业内的主流解决方案多聚焦技术层面:通过强化学习从人类反馈中学习(RLHF)、调整模型权重、设置内容过滤机制等,试图用算法框定AI的行为边界。但Anthropic的尝试跳出了这一框架,将大模型的“道德塑造”交给了哲学研究者。

37岁的阿曼达·阿斯克尔拥有牛津大学哲学博士学位,她的日常工作与代码无关——每天的核心任务是与Claude进行数小时的深度对话,同时设计上百页的提示词与行为规则。她将这份工作形象地比作“养育孩子”:既要引导Claude建立分辨对错的基本准则,也要培养其理解人类情绪的共情能力,甚至要教会它察言观色的社交智慧。比如当用户试图操纵胁迫Claude生成有害内容时,它需要明确识别风险并以人性化的方式拒绝;当用户表达负面情绪时,它要能提供有温度的安慰而非机械回应。通过反复的对话打磨与规则校准,阿斯克尔试图让Claude形成一套能适配每周数百万次复杂对话的道德判断体系,始终坚守“乐于助人且充满人性”的核心定位。

这种人文驱动的伦理对齐方式,恰好击中了当前技术路径的局限性。一位AI伦理研究员指出,人类的道德体系本身充满了语境复杂性与情感变量,比如“善意的谎言”在特定场景下被接受,而技术对齐往往只能遵循固定规则,容易出现“符合算法逻辑却违背常识”的尴尬。阿斯克尔的探索则让AI的道德判断更贴近人类的日常认知,通过对话建立的“人格”,能让Claude在面对模糊情境时做出更符合人类预期的选择。

事实上,Anthropic从创立之初就将“安全与伦理”视为核心竞争力——这家由OpenAI前员工创办的公司,在2023年就推出了基于 Constitutional AI(宪法AI)的对齐框架,即让大模型基于预设的道德准则自我修正输出。而阿斯克尔的工作正是这一框架的延伸:从“写好宪法”到“用人文方式让AI理解并践行宪法”。

随着大模型越来越深入人类的生活与工作场景,其伦理边界的模糊性将愈发凸显。Anthropic的这一尝试,或许为AI伦理的未来开辟了一条新赛道:技术理性需要与人文温度深度融合,哲学、心理学、社会学等领域的专家,或许将成为大模型落地过程中不可或缺的角色。未来的AI,不仅需要强大的算力与算法,更需要一套能与人类共情的“数字灵魂”。

3 小时前

2026年4月,AI大模型研发商Anthropic在清理平台上泄露的自家源代码过程中出现操作失误,提交的下架申请误伤数千个无关GitHub开源仓库。Anthropic高管随后公开承认事故为人为操作导致,已第一时间撤销绝大多数不当下架通知,目前GitHub已逐步恢复所有被误下架仓库的正常访问权限。

13 小时前

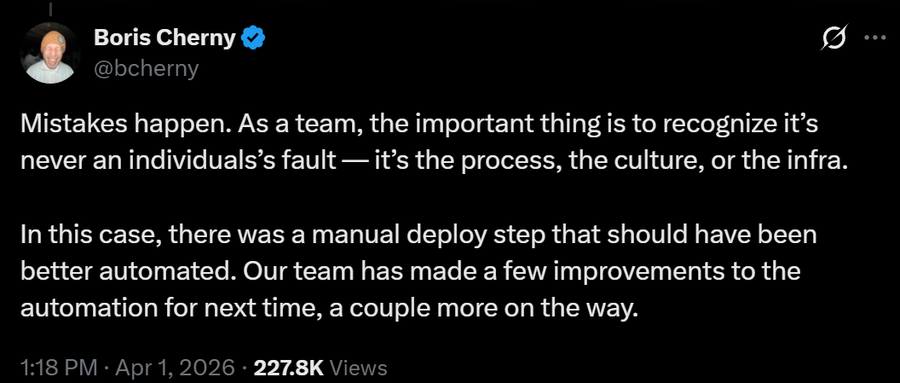

2026年4月,AI创企Anthropic旗下闭源编程工具Claude Code意外泄露引发行业震荡,项目负责人鲍里斯·切尔尼公开承认团队手动操作部署流程失误导致事故,第三方基于泄露代码推出的平替版本上线后短时间内便斩获GitHub 10万星,Anthropic随后紧急启动下架封杀措施,此次事件也引发行业对闭源AI项目安全管控的广泛讨论。

15 小时前

2026年4月1日,全球头部AI实验室Anthropic核心开发者鲍里斯·切尔尼就近日引发技术圈广泛关注的Claude Code源代码泄露事件正式回应,确认本次泄露并非黑客攻击,而是产品部署环节未混淆MAP调试文件被误打包的人为失误所致,目前Anthropic已启动版权清理,后续将升级部署自动化流程降低操作风险。

18 小时前

2026年4月,AI企业Anthropic针对旗下代码大模型Claude Code的源代码泄露事件正式发起法律维权,向代码托管平台GitHub提交多份DMCA下架通知,后者已清理涉事主仓库及超8100个相关Fork分支,系近年AI行业规模最大的代码版权清理行动。经调查,本次泄露并非员工操作失误,而是Anthropic内部打包工具底层BUG所致。

22 小时前

2026年4月,此前引发行业热议的Anthropic旗下Claude Code源码泄露事件迎来反转。自称因操作失误被开除的工程师Kevin Naughton Jr.并非Anthropic员工,其发布的道歉信实为推广初创公司Ferryman的营销手段。虽然身份造假属实,但本次源码泄露确为Anthropic在npm发布代码包时因.map文件未脱敏导致的真实事故,事件也暴露出开源社区的防护短板。

23 小时前

近日,AI大模型厂商Anthropic被曝出现严重操作失误,其发布在npm公共软件包仓库中的AI编程工具Claude Code版本意外附带源映射(Source Map)文件,直接导致该工具全部专有源代码对外泄露。作为Claude家族核心ToB商业化产品,本次泄露事件也引发了全球AI行业对厂商开发供应链安全的普遍担忧。

1 天前

2026年4月,AI独角兽企业Anthropic在发布命令行工具Claude Code时,因未删除源码映射.map文件,导致近2000份文件、超50万行TypeScript源代码泄露。开发者Chaofan Shou率先爆料,尽管官方第一时间紧急撤包补救,源码仍被备份至GitHub永久留存,还意外曝光未公开的BUDDY赛博宠物项目,引发行业广泛热议。

1 天前

2026年4月1日,人工智能公司Anthropic旗下AI编程工具Claude Code突发源码泄露事件,开发者Chaofan Shou在X平台发布包含超50万行TypeScript代码的压缩包,相关内容数小时内浏览量突破530万。经核实,泄露源于Anthropic向npm上传代码时未删除.map文件的操作失误,源码中还包含代号为BUDDY的未公开AI辅助开发项目。