2026年4月举办的CVPR2026学术会议披露,计算机视觉领域正经历核心研究方向的范式转换:行业告别过去单纯追求识别准确率的内卷路径,转向将视觉作为推理、决策与交互的核心中介。本次会议公开的VideoAuto-R1框架提出「按需推理」模式,在保持最优性能的同时将模型平均输出长度缩减3.3倍,标志着视觉智能从「看清世界」向「理解交互」的升级正式落地。

过去十年,计算机视觉领域的迭代路径始终围绕「识别准确率」展开:从ImageNet挑战赛上分类精度的逐年攀升,到扩散模型带来的图像生成质量飞跃,行业的核心目标始终是让机器「看清世界」。但随着模型感知能力逐步逼近人类水平,以往动辄百分之十几的性能提升早已消失,现在哪怕1%的准确率增长都需要投入数倍的算力与数据成本,边际收益已经跌到冰点。

此前十年,整个计算机视觉学术界和产业界的评价体系几乎完全绑定准确率指标:ImageNet排行榜的名次、安防场景的人脸识别精度、自动驾驶的障碍物识别率,所有技术迭代的核心都是提升识别的正确性。但随着基础感知能力的天花板逐步显现,单纯堆参数、堆数据的投入产出比越来越低,不少团队已经陷入“为了0.5%的提升投入半年研发”的低效内卷,行业迫切需要找到新的增长方向。

本次CVPR2026收到的投稿中,仅有不到30%的论文聚焦纯识别准确率提升,超过60%的研究都围绕视觉的下游应用展开,也从侧面印证了行业转向的大趋势。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

1 小时前

2026年4月30日谷歌正式为谷歌相册推出AI衣橱管家功能,依托计算机视觉识别技术自动提取用户照片中的服装单品,按品类完成智能分类搭建数字衣橱,同时支持多场景穿搭组合定制、虚拟试穿效果模拟,解决用户服饰管理效率低、穿搭决策难、线上购衣试穿成本高等痛点,功能已随谷歌相册常规更新向用户推送。

2 天前

2026年4月,阿里巴巴ATH创新事业部推出新一代多模态视频生成模型HappyHorse(内部昵称“神马”),目前已进入灰度测试阶段。该模型在第三方测评平台Arena.ai的文生视频、图生视频、视频编辑三大核心榜单中表现优异,可输出1080P超高清影视级画质,支持800词复杂指令解析、9张参考图输入,生成15秒高质量剧情视频仅需2-5分钟,成为全球AI视频赛道的有力竞争者。

13 天前

2026年4月17日,人工智能厂商Anthropic正式推出新一代旗舰大模型Claude Opus 4.7。该模型较前代Opus 4.6在高级软件工程任务处理、指令执行效率上提升显著,新增自我验证功能优化输出准确率,视觉处理支持最高2576像素边长图像识别,内置网络安全防护模块,定价与前代保持一致。

13 天前

2026年4月17日,Google宣布为旗下AI开发平台Google AI Studio接入Google AI Plans订阅服务,正式打通AI开发工具与订阅服务壁垒。开发者可直接在平台内关联订阅获取更高使用限额、全栈多模态模型访问权限,同时平台新增按请求付费选项,可解锁所有模型与智能体的完整访问权,大幅降低开发者跨平台调用谷歌AI能力的操作成本。

16 天前

2026年4月,微软正式开源全新多模态推理模型Phi-4-reasoning-vision-15B,该模型参数规模仅15B,全程仅用200B高质量多模态token训练完成,主打轻量化路线,在科学推理、复杂视觉任务上实现了优异表现,可为资源受限的部署场景提供低成本多模态AI方案,填补了小参数模型复杂推理能力的市场空白。

27 天前

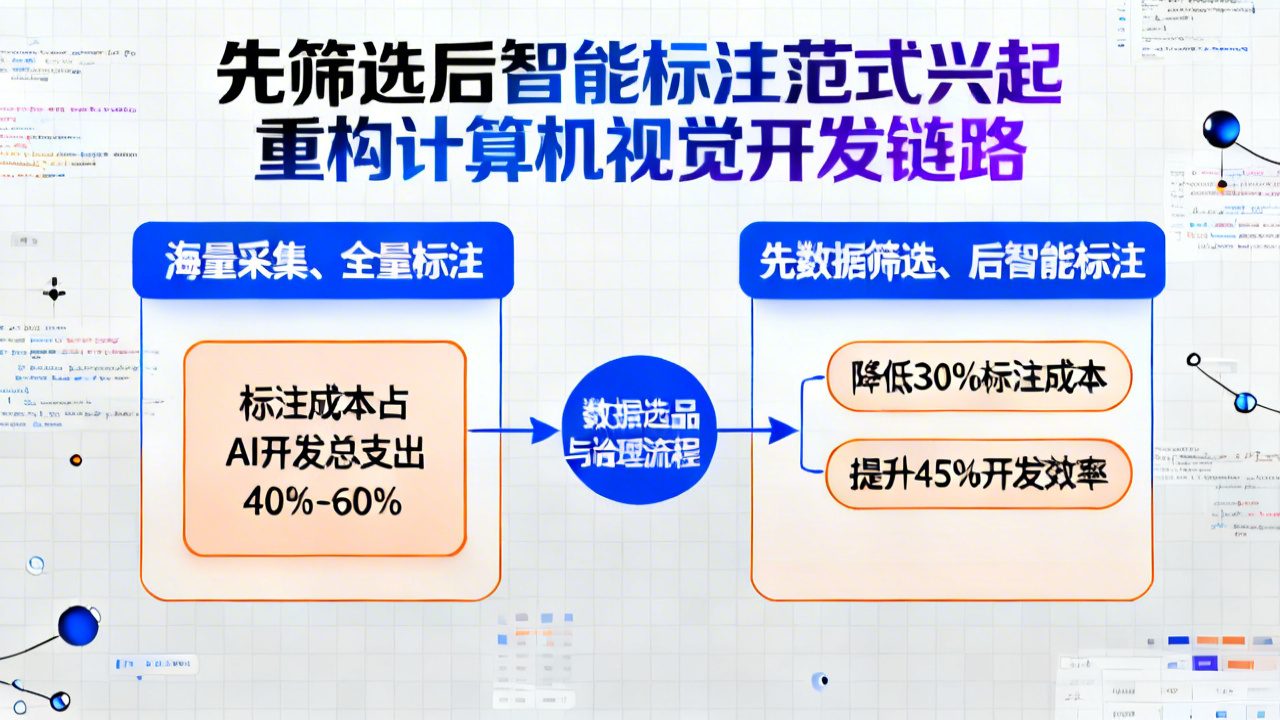

全球科技内容平台InfoWorld最新报道显示,当前计算机视觉领域正兴起“先数据筛选、后智能标注”的全新开发范式,该模式通过策略化数据选品与治理流程,可平均降低30%以上的标注成本,同时将AI模型开发效率提升至少45%,成为计算机视觉落地降本增效的核心路径之一。

1 个月前

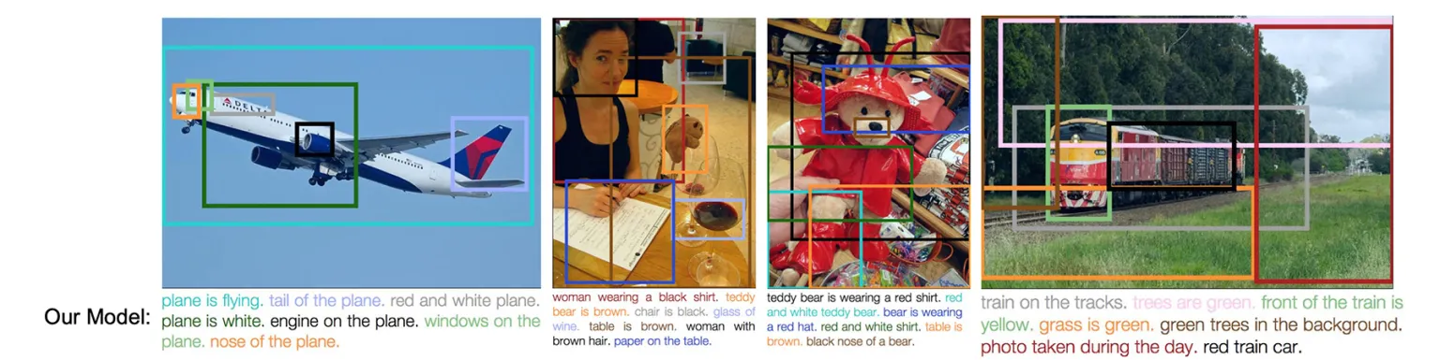

2026年3月25日,苹果公司联合威斯康星大学麦迪逊分校发布全新AI训练框架RubiCap,主打优化密集图像描述模型训练流程,通过创新强化学习机制破解传统标注成本高、合成数据泛化能力弱的行业痛点,性能超越体量10倍的同类产品,可应用于视觉语言模型训练、文生图优化、无障碍工具升级等多个领域。

1 个月前

2026年3月26日,苹果公司联合威斯康星大学麦迪逊分校正式推出专注于密集图像描述的AI训练框架RubiCap。该框架采用创新强化学习机制,引入Qwen2.5担任“裁判”提供训练反馈,可精准捕捉图像细粒度内容,性能反杀参数规模为其10倍的同类型图像描述模型,有效解决了传统图像标注成本高、生成内容幻觉多的行业痛点。