2026年4月3日,阿里通义实验室正式发布AI视频生成工具Wan2.7-Video,针对当前行业普遍存在的内容生成不专业、编辑修改难度高两大痛点,支持文本、图像、视频、音频全模态输入,可实现画面结构、剧情走向、局部细节的精准控制,大幅降低专业内容创作门槛,为视频创作者提供更高的创作自由度与编辑灵活性。

不少视频创作者都有过类似的经历:用AI生成的短视频人物穿模、剧情逻辑断裂,想要删掉画面里误入的路人,只能重新输入prompt反复调试,几秒钟的视频往往要耗上一两个小时才能达到可用标准。而阿里通义实验室最新发布的产品,正是瞄准了这一行业普遍存在的效率卡点。

过去两年AI视频生成技术快速迭代,但距离商业化大规模落地始终存在明显短板。一方面是生成内容的专业性不足,多数模型很难精准把控画面构图、剧情连贯性,输出内容往往需要大量人工剪辑调整才能使用;另一方面是编辑灵活性差,现有模型大多支持单次生成,用户想要修改局部内容只能重新输入指令生成全片,时间成本极高,也很难满足定制化创作需求。

来自国内MCN行业的调研数据显示,目前AI生成视频的后期调整成本占整体制作成本的60%以上,远高于传统拍摄模式的后期占比。

此次发布的Wan2.7-Video直接针对上述两大痛点做了定向技术优化。首先是全模态输入能力,用户可以同时输入文本脚本、参考图像、粗剪视频甚至背景音频,模型会自动整合多维度信息生成符合要求的视频内容,不再局限于单一的文本生成模式。

更核心的升级在于编辑能力的突破。Wan2.7-Video支持指令化的局部修改,用户只需要用文字描述调整需求,就能精准修改视频中的任意元素:框选画面中的冗余路人即可一键删除,选中静物就能替换成指定物品,甚至可以实现季节切换、画面风格转译等复杂操作,调整过程不会影响未修改区域的内容连贯性,相当于把“图层编辑”的逻辑搬到了视频创作领域,用户可以像修改Word文档一样调整视频内容。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

7 分钟前

近期AI领域产业演进趋势显示,多智能体系统正被业内视为继微服务之后的新一代分布式架构范式,类比传统IT领域的微服务架构,多智能体可通过分工协作大幅提升复杂任务处理效率,但调研显示超6成企业在未明确核心业务场景需求的前提下盲目布局,反而额外增加了系统运维与排障成本。

9 分钟前

当前生成式AI落地进入深水区,大量企业面临大语言模型(LLM)选型难题,本次梳理的27项核心评估维度,覆盖部署成本、推理性能、场景适配能力、合规性等多个层面,适用于OpenAI、Anthropic、国内厂商等推出的各类LLM产品,可帮助企业快速筛选匹配需求的模型,降低试错成本。

14 小时前

最近针对美国12-18岁青少年的调研显示,近62%的受访对象使用过ChatGPT、Google Gemini、DeepSeek等AI产品的陪伴类功能,超过3成受访青少年会向AI倾诉不愿告知家长、同学的私密情绪,AI正成为Z世代社交版图中不可忽视的新角色,相关行为也引发了学界对青少年社交模式变化的广泛讨论。

1 天前

近期,科技巨头微软针对旗下AI助手Copilot发布官方用户提示,明确不建议用户在高风险场景下过度依赖该工具。作为微软过去5年重点布局的核心AI产品,Copilot已覆盖Windows系统、Office办公套件、Azure云服务等全产品线,此前累计投入相关研发推广资源超100亿美元,此次态度转向引发AI产业对通用助手落地边界的广泛讨论。

2 天前

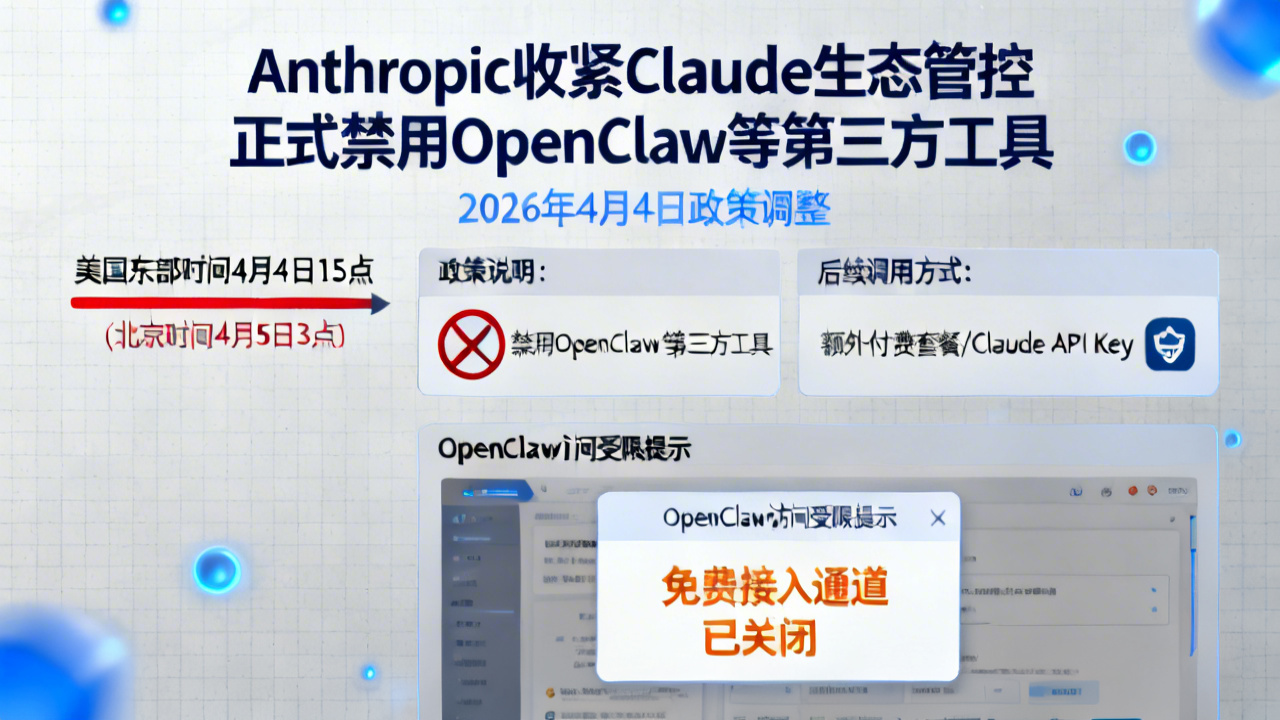

2026年4月4日,大模型厂商Anthropic正式官宣生态政策调整:从美国东部时间4月4日15点(北京时间4月5日3点)起,旗下Claude大模型将禁用OpenClaw等第三方工具,用户后续仅能通过额外付费套餐或Claude API Key调用相关工具。该政策将率先在OpenClaw落地,未来覆盖全部第三方工具链,是大模型厂商收紧生态控制权、加速商业化的标志性动作。

2 天前

近期Meta、微软、谷歌等海外头部科技企业相继公布天然气电厂建设计划,为旗下高速扩张的AI数据中心提供稳定电力支撑。随着生成式AI普及,单座AI算力中心能耗是传统数据中心的3-5倍,现有公共电网已难以满足企业爆发式算力供电需求,化石能源供电方案也引发了业内对碳目标达成、长期运营风险的广泛讨论。

2 天前

据科技媒体The Information及行业分析师Eric Newcomer披露,AI大模型厂商Anthropic已于近期完成对秘密运营的生物科技AI初创公司Coefficient Bio的收购,本次交易为全股票形式,总对价达4亿美元。这是Anthropic首次落地生命科学垂直领域布局,也标志着大模型厂商商业化正加速向生物医药赛道渗透。

2 天前

2026年以来,微软、Meta、Google等全球科技巨头先后启动配套天然气发电厂建设项目,以满足AI大模型训练、推理所需的超算数据中心爆发式增长的能耗需求。行业测算显示,头部AI算力集群的单位能耗是传统数据中心的5-10倍,这一能源布局已引发行业关于碳排放、长期能源结构合理性的广泛讨论。