近期美国加州大学伯克利分校安全研究团队披露新型AI侧信道攻击技术,可在无系统访问权限、无模型调用接口权限的前提下,仅通过采集分析大模型推理阶段的功耗、电磁辐射特征,还原核心权重数据,准确率最高可达99.2%,OpenAI GPT系列、Google Gemini等主流商用大模型均存在被攻击风险。

本次公布的攻击技术相关论文,已入选2024年IEEE国际安全与隐私研讨会的重磅成果名录,研究团队在对照实验中仅使用售价不足1000美元的便携辐射传感器,在距离部署开源Llama 2 7B模型的服务器3米范围内,仅采集2小时运行数据,就成功还原了92%的模型核心权重参数。

传统AI模型的安全防护体系,普遍围绕软件层设计:从接口调用限流、访问权限管控到代码层面的防逆向工程,核心逻辑是阻止未授权用户接触到模型的核心数据。但本次曝光的侧信道攻击完全绕开了所有软件层面的防护,它的核心逻辑是捕捉大模型推理过程中,不同参数运算产生的细微功耗、电磁辐射差异,通过提前训练好的特征匹配模型,反向还原出被攻击大模型的权重数据。

无接触、无权限要求是该攻击最具威胁性的特征,哪怕是完全断网、不对外开放任何接口的私有化部署大模型,只要处于运行状态,就存在被窃取的可能,这类攻击路径此前完全处于行业防护盲区。

研究团队的测试结果显示,目前所有基于Transformer架构的主流大语言模型,包括OpenAI的GPT-4o、Google Gemini Advanced、DeepSeek V3等,都存在被该技术攻击的风险,哪怕是参数规模超过千亿的闭源商用大模型,在无屏蔽环境下的攻击还原准确率也能达到87%以上。

对于金融、政务等对数据安全要求极高的领域而言,该漏洞的影响更为严重:不少机构为了数据安全选择私有化部署大模型,却完全忽略了物理层的安全防护,此前某头部云服务商的内测环境中,已经出现过邻位租户通过功耗侧信道,窃取同物理机上部署的大模型参数的未公开案例。

据了解,研究团队早在2024年6月就已向全球Top10大模型厂商提交了漏洞预警,目前相关的防护方案研发已经进入落地阶段。OpenAI、Google已经在最新的推理优化框架中加入了随机功耗混淆模块,通过在模型推理过程中插入无用运算单元,打乱功耗和电磁辐射的特征规律,可将攻击的准确率降低到10%以下。

国内多家AI服务器厂商也在同步研发带电磁屏蔽功能的专用大模型机柜,预计2025年第一季度就会量产上市。不过业内人士也提醒,短期来看,部署私有化大模型的机构首先要强化机房的物理准入管控,避免无关人员携带电子设备靠近服务器集群,最大程度降低被攻击的风险。

(图像由AI生成)

59 分钟前

2026年4月2日,百度健康正式发布国内首款基于Claw框架打造的医生任务型AI助手“有医助理”,首创“检索+任务”双引擎模式,其检索模块底座整合6000万+专业文献、20万+用药知识图谱、5万+权威指南共识、2万+医学书籍,所有结论可溯源,填补了国内临床专业级医疗AI工具的空白。

1 小时前

4月2日阿里正式推出新一代大语言模型Qwen3.6-Plus,作为Qwen3.6系列首个落地模型,其默认支持100万上下文窗口,重点升级编程、智能体Agent、工具调用三大核心能力,适配主流Agent框架与编程工具,实测可8分钟完成官网开发,后续千问团队工作重心将全面转向Qwen3.6系列的整体发布。

3 小时前

近日谷歌宣布调整AI Pro订阅服务权益,所有已付费的AI Pro订阅用户无需额外支付费用,即可将原有云存储空间升级至5TB。该订阅服务包含Gemini Advanced大模型使用权限、Google Workspace AI增强功能等权益,本次升级覆盖全球超百万活跃付费用户,预计将进一步提升谷歌AI订阅产品的市场竞争力。

4 小时前

2026年3月,受霍尔木兹海峡航运风险抬升、美国对华算力硬件关税调整双重影响,国内AI芯片封装、液冷设备等核心供应商集体预警,下游欧美AI厂商算力部署成本预计同比上浮27%,OpenAI、谷歌DeepMind等巨头已启动备选供应链评估,国内大模型厂商DeepSeek等也调整了2026年的算力集群扩产节奏。

4 小时前

近期,企业级AI服务商Kilo正式推出面向组织的托管平台KiloClaw for Organizations,针对当前企业普遍存在的员工私自部署AI代理引发的「影子AI」安全隐患,将原由员工自主管理的AI代理部署模式升级为集中管控模式,提供分级权限访问、全链路数据审计能力,可有效降低数据泄露、合规违规等多重风险,引发企业服务领域广泛关注。

4 小时前

2026年4月2日,阿里巴巴正式发布新一代大语言模型千问3.6-Plus。该模型配备100万token长上下文窗口,在多项权威编程评测中位居国产模型首位,整体编程能力接近全球标杆Claude系列,可自主完成前端开发、复杂仓库任务、设计稿转网页等需求,被业内称为当前最强国产编程大模型。

4 小时前

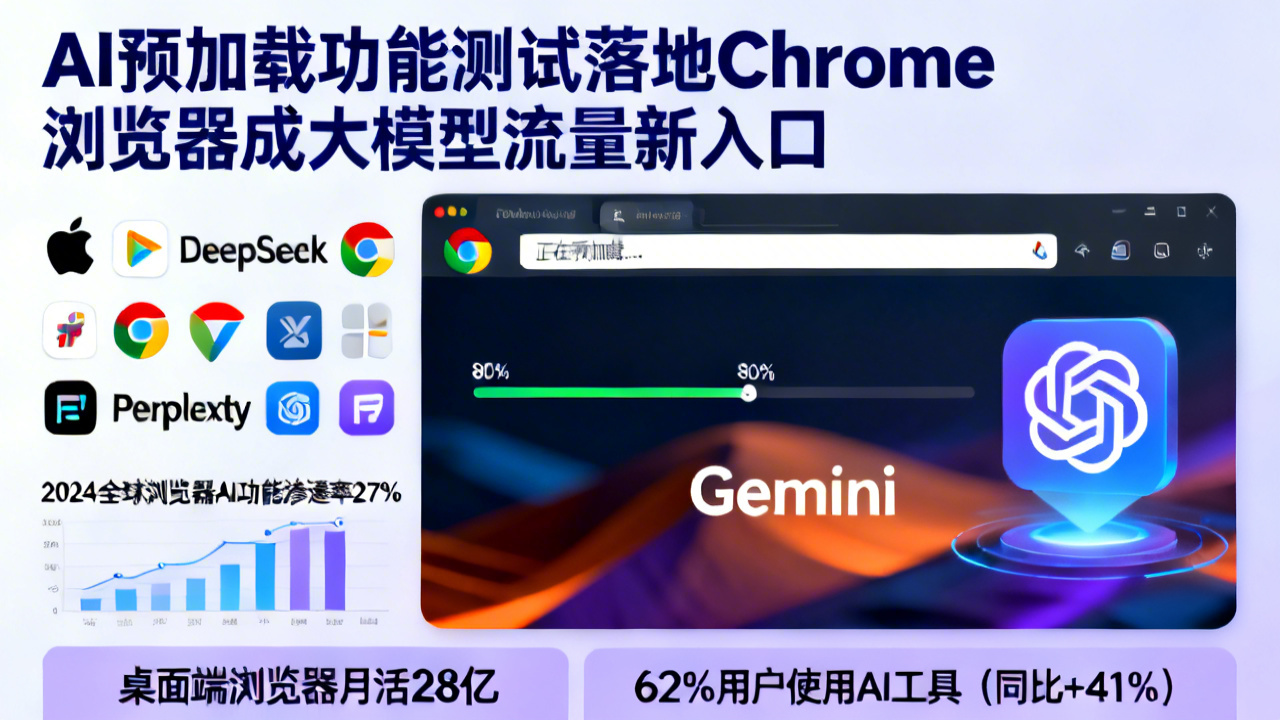

近期Google被曝正在Chrome浏览器中测试AI驱动的智能预加载功能,依托旗下Gemini大模型的用户行为预测能力,该功能可使常用网页加载速度提升32%左右。与此同时,苹果、DeepSeek、Perplexity等厂商也在加速布局浏览器端AI入口,2024年全球浏览器AI功能渗透率已突破27%,赛道竞争进入白热化阶段。

4 小时前

近期海外科技媒体InfoWorld发布企业级语音AI Agent落地调研报告,指出当前68%的企业用户弃用内置语音AI工具的核心原因是交互体验生硬,而非功能不足,办公场景下语音AI的「拟人化」交互体验优化优先级已远超算法迭代,成为厂商争夺企业级AI市场的核心赛道。