Chainlit是一款面向开发者和企业的AI应用开发工具,核心定位是帮助研发团队搭建稳定可靠的对话式AI应用,同时提供LLM应用的可观测性与数据分析服务。不同于偏底层的通用AI开发框架,它聚焦对话类大模型应用的全生命周期开发支持,专门解决对话式AI开发过程中效果评估、运行观测的需求,能够帮助团队快速交付功能完善的AI应用项目,降低对话式AI从开发到上线迭代的门槛,适配从小型创业团队到大型企业的各类LLM应用开发需求。

从官网展示的对话式AI交互案例来看,用户可以直接通过自然文字输入指令,比如输入“生成上月运营销售报表”,工具就能快速输出对应结果。整个交互流程符合常规对话式AI的使用逻辑,处理步骤清晰可见,还支持用户留下反馈,方便后续优化AI模型的输出效果。输出结果直观呈现,交互流程流畅,能够清晰展示对话式AI应用的运行状态,满足日常业务类对话AI的交互需求。

聚焦对话式LLM应用的全链路需求,不仅提供应用搭建能力,还集成了上线后的可观测性与数据分析能力,不需要开发者对接多个不同工具就能完成从开发到迭代的全流程,适配各类规模的开发团队。针对对话类AI的交互特性优化了开发流程,能够有效降低开发与运维迭代的成本,帮助团队更快交付可靠的AI产品。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

5 天前

全球最大的前端开源软件仓库npm近期检出两款恶意开发包pgserve、automagik,两类包伪装成常规开发工具,可窃取用户数据、账号凭证与核心密钥,还会感染所有基于其开发的软件包,极端情况下可造成企业级系统完全接管。当前大量AI应用依赖npm生态组件,风险已传导至生成式AI产品落地全链路。

8 天前

近日AI团队灵光推出定位“AI应用版GitHub”的新型开发协作平台,引发AI开发领域关注。资深科技记者陈骏达分析指出,当前AI Coding已经历三轮演进,从代码补全、对话生成代码发展到Agentic Coding自动生成完整项目,写代码正快速商品化,但AI应用仍未实现大规模爆发,核心痛点卡在应用部署与分发环节。

14 天前

近日开发者JeecgBoot在Mac Studio M4Max设备上完成Claude Code对接本地大模型的实测,测试采用社区魔改蒸馏的gemma-4-26b-a4b-it-claude-opus-heretic-ara模型,对比官方原版Gemma 4,生成速度实现5~6倍提升,最高可达78tok/s,该模型采用稀疏激活MoE架构,支持256K上下文,为本地AI开发提供了新的实践参考。

15 天前

2026年4月,一批疑似AI公司Anthropic的内部开发截图在社交平台X泄露,内容显示该公司正在其主力大语言模型Claude中,研发代号为“Lets ship something great”的全栈应用构建器。相关曝光帖发布24小时内获得超170万次浏览、5000余次点赞,引发全球开发者社区广泛...

25 天前

2026年4月3日,谷歌正式发布新一代开源AI模型Gemma4,放弃此前Gemma系列采用的限制性自定义许可,改用行业通用的Apache2.0开源协议,允许全球开发者自由使用、修改、分发模型并用于商用场景。该模型在性能与生态兼容性上实现双重升级,可大幅降低AI落地的技术与法律门槛。

26 天前

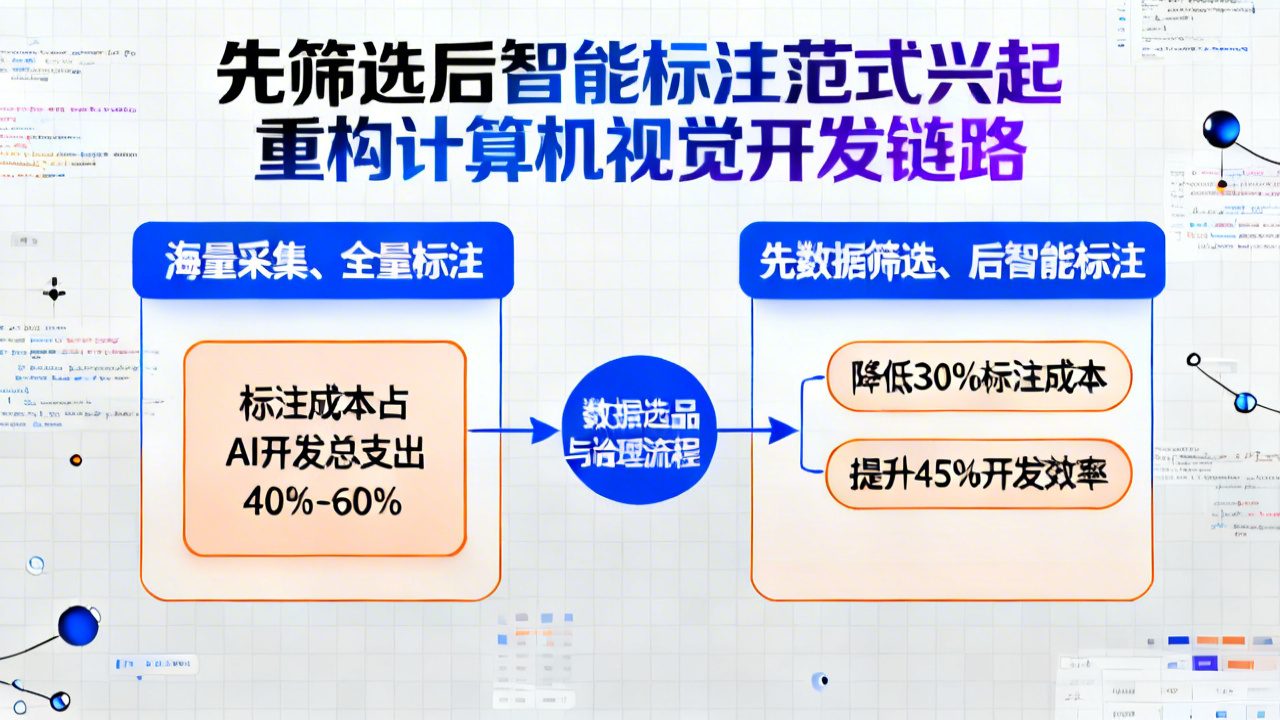

全球科技内容平台InfoWorld最新报道显示,当前计算机视觉领域正兴起“先数据筛选、后智能标注”的全新开发范式,该模式通过策略化数据选品与治理流程,可平均降低30%以上的标注成本,同时将AI模型开发效率提升至少45%,成为计算机视觉落地降本增效的核心路径之一。

1 个月前

近期,微软宣布将旗下主流代码编辑器Visual Studio Code(简称VS Code)的稳定版发布节奏从过往的月度更新调整为每周更新。此次调整正值AI应用开发井喷期,目前全球超70%的开发者、超80%的AI领域开发者将VS Code作为主力开发工具,新的发版节奏将大幅提升AI相关功能的落地效率,降低开发者的适配等待成本。

1 个月前

AI初创公司Anthropic正式上线Claude Builder计划,面向开发者与企业开放全栈AI开发生态。该计划依托Claude系列大模型(Opus、Sonnet、Haiku),整合Claude Code、Chrome/Slack/Office插件等功能,覆盖编码、客服、金融、医疗等多行业场景,...