2026年3月25日,谷歌研究院正式发布全新极端压缩算法TurboQuant,针对大语言模型普遍存在的KV Cache内存瓶颈实现核心技术突破,实测可将AI内存占用锐降至原有水平的1/6,推理速度最高提升8倍。该技术有望重塑AI运行效率体系,对下游AI部署、存储芯片市场均将产生深远影响。

对于很多尝鲜本地大模型的用户来说,“爆显存”几乎是长文本生成、多轮对话场景下的标配痛点:哪怕是搭载24G显存的高端消费级显卡,跑70B参数的大模型最多也只能支持32k上下文窗口,再长就会因为内存不足直接崩溃。这一问题的核心根源,就是占大模型显存开销七成以上的KV Cache缓存。

KV Cache是大语言模型生成文本时的高速缓存机制,通过存储历史计算结果避免重复计算,是大模型提升生成速度的核心技术,但随着上下文窗口从4k一路扩展到128k、256k,KV Cache的内存占用也呈线性增长,成为制约大模型性能的首要瓶颈。

此前行业普遍采用高维向量量化技术压缩KV Cache,但这类技术需要为每个微小数据块计算、存储独立的量化常数,额外引入的内存开销抵消了近四成的压缩收益,始终无法实现根本性突破。云厂商的大模型推理成本中,显存开销占比已经超过60%,消费级设备跑大模型的门槛也始终居高不下。

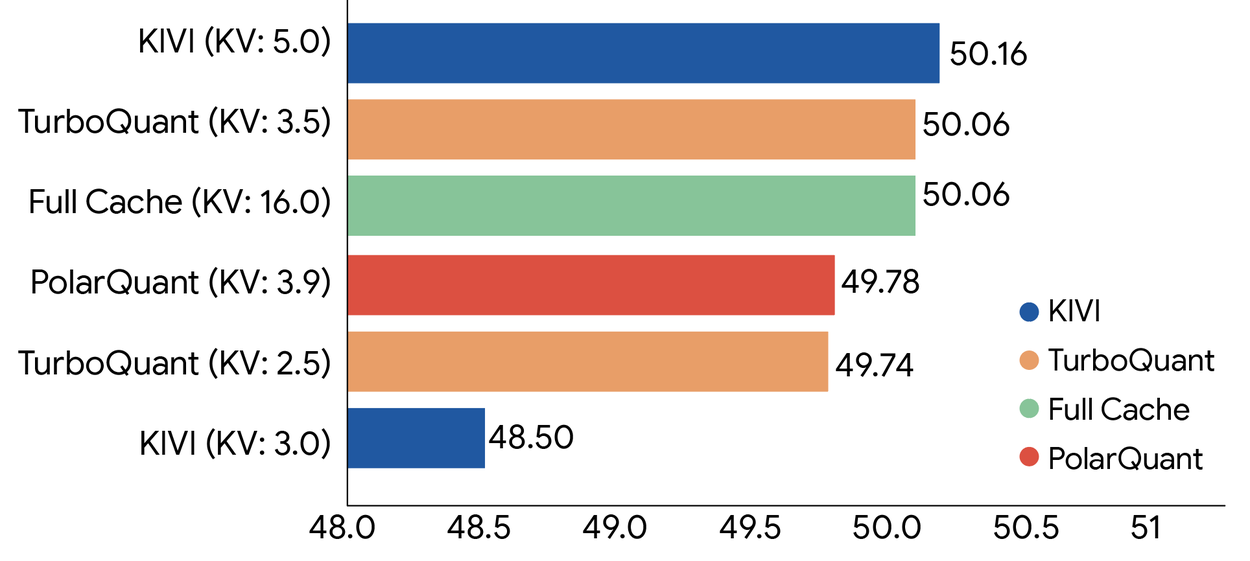

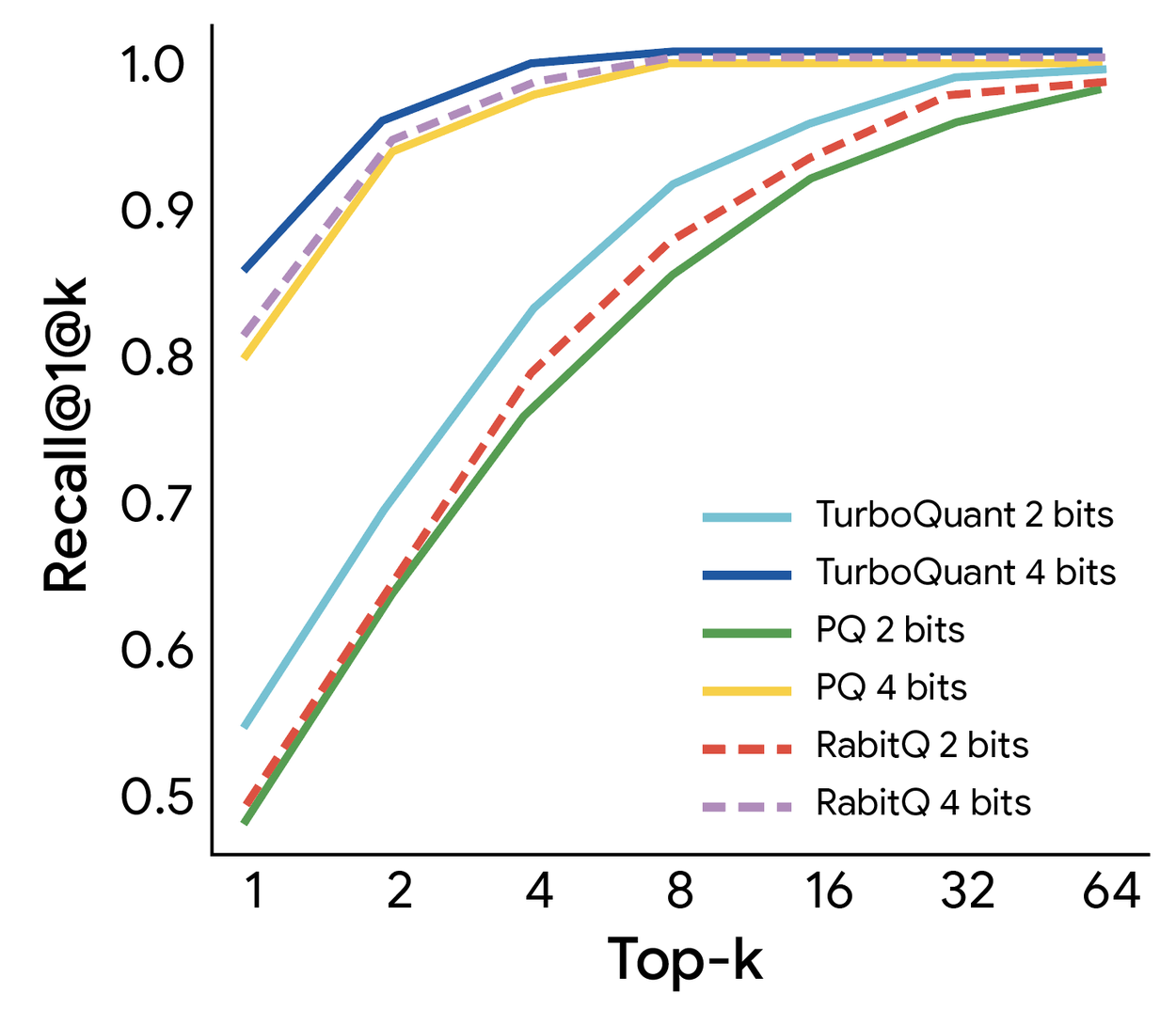

此次谷歌研究院推出的TurboQuant,直接放弃了传统分块量化的技术路线,采用全局动态量化校准机制,仅用极少量的全局参数就能实现对高维向量的无损压缩,完全消除了传统方案的额外内存开销,量化精度反而较行业主流方案提升12%。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

13 小时前

2026年以来,美国加州AI算力集群用电需求同比上涨42%,带动全州平均电价上浮18%。此前长期为硅谷度假胜地太浩湖供电的太平洋燃气电力公司合约将于今年年底到期,受AI用电缺口挤压,其续约报价较此前上涨37%,迫使太浩湖市政部门启动新一轮能源供应商招标,优先考虑可稳定供电的清洁能源服务商。

15 小时前

2026年5月,OpenAI正式推出ChatGPT个人理财专属功能,支持用户绑定个人银行及证券、支付账户,后台将自动聚合用户的投资组合表现、日常消费、订阅服务、待支付账单等多维度财务数据,为用户生成统一的可视化财务看板,这是大语言模型首次规模化落地C端个人理财垂直场景。

17 小时前

2026年5月15日,人工智能公司xAI正式推出Agentic命令行工具Grok Build早期测试版,该产品定位智能开发助手,可实现项目结构分析、代码编写、错误调试、开发任务自动化等功能,目前仅向SuperGrok Heavy订阅用户开放,用户可通过x.ai/cli申请体验,后续将根据用户反馈快速迭代优化。

17 小时前

2026年5月15日,千问APP正式宣布与国家药监局信息中心达成深度战略合作,全面接入覆盖药品、化妆品、医疗器械三大类别的数百万份国家级权威数据,可通过权威数据源实时校核大幅降低健康咨询类回答的幻觉问题,将为平台数千万用户提供精准用药指导、成分检索等服务,标志着国产大模型垂直领域专业化、合规化建设取得关键进展。

17 小时前

2026年5月行业监测数据显示,埃隆·马斯克旗下由SpaceX与xAI合并而成的SpaceXAI正遭遇严重人才危机,2026年2月至今已有超50名顶尖研发人员离职,覆盖编程助手、世界模型、Grok语音交互、预训练等核心团队,近20名离职人员转投Meta、Thinking Machines Lab等竞品,引发行业对其技术迭代能力的广泛质疑。

17 小时前

AI编码初创企业Cursor于2026年5月宣布启动全球化扩张进程,未来半年将在亚太地区招聘200名技术及市场类员工,新加坡办事处由资深科技高管Simon Green负责。此前该公司已与SpaceX达成重磅合作协议,SpaceX拥有600亿美元收购Cursor的权利,若未触发收购则需支付100亿美元采购其研发成果,充足资金加持下Cursor正加速技术出海落地。

17 小时前

2026年5月15日,百度正式宣布成立作为大模型战略最高决策与协调机构的百度模型委员会(BMC),该机构由深度参与文心大模型多代迭代的青年研究员组成,基础模型研发部、应用模型研发部将直接向其汇报,实现大模型从底层技术研发到上层产品落地的全链路统一管理,标志着百度大模型竞争正式进入体系化作战阶段。

17 小时前

2026年5月,OpenAI正式宣布将AI编程模型Codex集成至ChatGPT的iOS及Android移动端应用。本次更新针对手机使用场景做了专属交互适配,支持开发者在通勤、线下休闲等非办公场景快速完成代码审批、逻辑调试等碎片化编程任务,标志着AI编程工具正式从桌面生产力阶段迈入全时伴随的发展新阶段。