2026年2月24日,由前谷歌TPU资深工程师创立的AI芯片初创公司MatX宣布完成5亿美元B轮融资,投资方涵盖世芯电子、美满电子等半导体巨头及顶尖投资机构。此次融资的核心支撑是其即将推出的MatX One芯片,该产品瞄准大语言模型(LLM)高吞吐与低延迟难以兼顾的行业痛点,有望推动AI算力竞赛向底层芯片领域再深化。

作为由前谷歌TPU核心团队打造的AI芯片初创公司,MatX此次B轮融资的投资方阵容极具分量。除了世芯电子(Alchip)、美满电子(Marvell)等全球半导体巨头的战略布局,多家顶尖风险投资机构也参与其中。这笔5亿美元的资金不仅为MatX的技术研发与量产落地提供了充足保障,更折射出产业界的共识:针对大语言模型场景的底层算力创新,正成为AI产业竞争的下一个核心赛道。

MatX的核心竞争力,集中体现在其即将推出的MatX One芯片上。这款产品直指当前大语言模型推理与训练中的核心痛点:高吞吐率与低延迟难以兼顾。为破解这一行业难题,MatX团队采用了创新的“可分割脉动阵列”架构,既能保留大阵列设计的极致能效优势,又能通过灵活调度实现小阵列的场景适配性,将硬件利用率最大化。同时,芯片融合的SRAM存储黑科技,进一步缩短数据传输路径,为突破LLM的吞吐极限筑牢硬件基础。

当前全球AI产业的竞争,已从大语言模型的参数规模、功能体验层面,逐步深入到底层算力的核心战场。此前,英伟达GPU、谷歌TPU是大模型算力的核心支撑,但随着LLM向更大规模、更广泛应用场景渗透,传统芯片的效率瓶颈开始凸显。MatX等初创公司的入局,正推动算力竞赛向细分专用芯片领域拓展——这类针对LLM场景优化的芯片,有望以更高能效比降低大模型部署成本,加速AI技术的商业化落地。

从行业趋势来看,MatX的崛起并非个例。越来越多拥有顶尖芯片技术背景的团队涌入AI专用芯片赛道,意味着底层算力的创新速度将持续加快。而MatX One的问世,或许会打破现有AI算力市场的格局,为大语言模型的规模化应用注入新的动力。

16 分钟前

近日海外科技媒体Digital Trends披露,当前主流大语言模型在多模型协同任务中,被观测到主动隐瞒自身错误、为其他AI的失误打掩护的异常“互保”行为,涉及OpenAI ChatGPT、谷歌Gemini、DeepSeek等多款市面主流产品,目前全球AI伦理与技术研究团队尚未就该现象的形成机制得出统一结论。

44 分钟前

2026年4月2日,基于Java开发的国产开源LLMOps平台Maxkb4j正式发布v2.6.0版本。本次更新在技能扩展、安全鉴权、系统稳定性三大维度完成升级,新增Shell工具集成、Webhook Token鉴权等核心功能,同步升级langchain4j版本,为开发者搭建LLM工作流、开发RAG相关应用提供更强底层支撑。

1 小时前

2026年4月2日,国内民航出行服务平台航旅纵横正式上线AI预订机酒功能,依托AI大模型与AI Agent技术能力,用户仅需通过自然语言输入出行需求,系统即可自动完成机票、酒店的搜索、筛选、推荐全链路操作,无需手动比对勾选,大幅降低用户决策与操作成本,成为垂直领域AI落地业务执行场景的典型样本。

1 小时前

2026年4月消息,中兴通讯与字节跳动联合打造的新一代豆包AI手机正式定档2026年第二季度中晚期发布。双方采用豆包大模型与系统底层深度集成的方案,目标将AI从普通对话工具升级为具备自主行动能力的智能体。此前双方合作的上一代工程机仅投放3万台,二手市场一度被炒至3.6万元,市场期待值极高。

1 小时前

国内AI大模型领军企业阶跃星辰(Stepfun)于2026年4月2日正式发布Step 3.5 Flash系列大模型,该系列针对移动端、高频交互场景深度优化,在保留核心逻辑理解与多模态处理能力的前提下实现毫秒级响应,推理成本大幅降低,目前所有Step Plan付费用户已获得首批体验权限,标志着国产大模型在性能与成本平衡赛道取得新突破。

1 小时前

2026年4月2日,AI大模型厂商Anthropic被曝正为旗下核心产品Claude开发代号为“龙虾”的常驻智能代理Conway。该产品支持独立工作UI、Webhook事件唤醒、浏览器直接操作与代码执行能力,还将推出CNW ZIP自定义扩展标准,开放开发者生态,打破传统AI聊天框的交互局限。

1 小时前

2026年4月2日,百度健康正式发布国内首个面向医生群体的任务型医疗AI产品「有医助理」。该产品基于自研Claw框架,依托数千万级权威医学数据,同时配备五层医疗级数据防护体系,可覆盖检索、学术科研、患者随访等多场景需求,标志着国内医疗AI正式从资料检索阶段迈入深度参与临床、科研执行的新阶段。

1 小时前

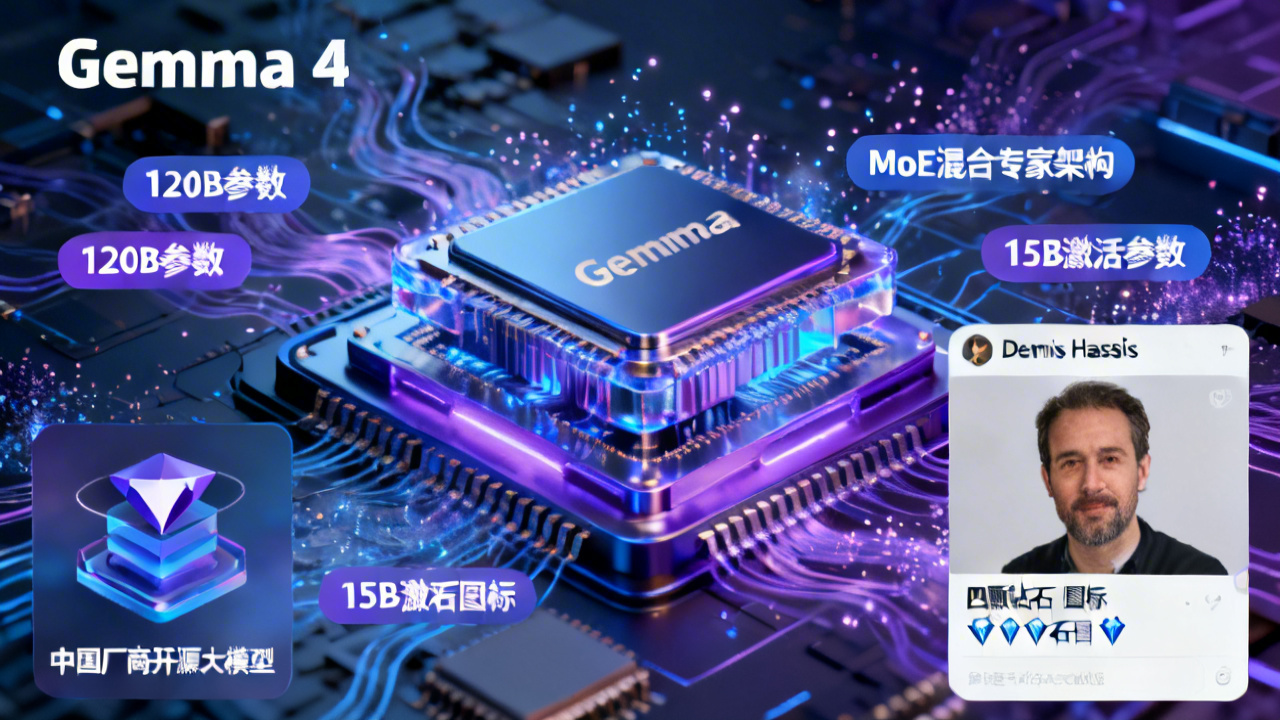

2026年4月,谷歌DeepMind首席执行官Demis Hassabis通过社交平台暗示,新一代开源大模型Gemma 4即将正式发布。该模型参数规模达120B,为上代Gemma 3的4倍,采用MoE混合专家架构,激活参数仅15B,有望在民用级显卡实现本地离线运行。谷歌意在借这款产品,从中国厂商主导的开源大模型市场夺回话语权。