2026年3月26日,谷歌研究团队正式推出全新向量量化压缩算法TurboQuant,依托PolarQuant与QJL两项创新技术,可将大语言模型推理环节的键值缓存(KV Cache)内存需求降低至少6倍,在英伟达H100 GPU上实现注意力计算最高8倍提速,且测试显示全程零精度损失,无需额外训练即可落地,有望大幅压低大模型部署成本,推动长上下文应用普及。

大语言模型处理长序列内容时,需要存储由键、值向量组成的KV Cache(键值缓存)来降低重复计算量,支撑注意力机制快速运转。但随着行业普遍将上下文窗口从数千token扩容至数十万乃至百万token,KV Cache的内存开销呈线性暴涨,已经成为挤占GPU算力、拉高推理成本的核心障碍。据行业测算,运行百万上下文级别的大模型时,KV Cache的内存占用甚至可达到模型参数本身的2-3倍,多数中小厂商难以负担相关部署成本,也直接限制了长上下文能力的普及速度。

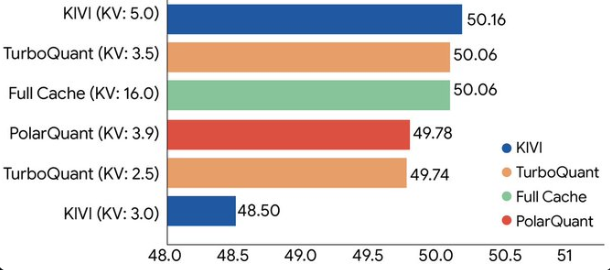

此次谷歌推出的TurboQuant算法,跳出了业内过往“压缩必损精度”“提速需额外预训练”的固有路径,通过创新的PolarQuant极坐标量化技术与QJL量化跳转逻辑,无需对模型进行任何额外微调训练,即可实现KV Cache至少6倍的压缩率。在英伟达H100 GPU上的实测数据显示,其注意力计算速度最高可提升8倍,在MMLU、LongBench等多项主流长上下文能力基准测试中,输出结果精度与未压缩版本完全一致,没有出现任何性能衰减。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

6 小时前

北京时间2026年5月19日,大模型独角兽Anthropic正式宣布对旗下两款核心AI产品Claude Design、Claude Code完成重磅功能升级。本次调整覆盖Pro、Max、Team、Enterprise全量订阅套餐,将所有付费用户的Token使用上限直接翻倍,同时将Claude Code快速模式的底层模型默认切换为最新Opus 4.7,不加价的前提下大幅降低创作者与开发者的使用门槛。

6 小时前

2026年5月,亚马逊正式为其大模型重构的新一代语音助手Alexa+推出名为Alexa Podcasts的AI定制播客功能,该功能首批面向美国地区用户开放公测,用户仅通过一句简单语音指令,无需上传素材、编写脚本,即可在数分钟内获得完全匹配个人兴趣的专属播客内容,大幅拓展了消费级AI语音助手的落地边界。

6 小时前

2026年5月,谷歌分拆企业SandboxAQ宣布与大模型厂商Anthropic达成深度合作,将自研科学AI模型集成至Claude平台,无需专业计算背景即可调用药物研发工具。背靠前谷歌CEO埃里克·施密特担任主席的团队,SandboxAQ已累计融资超9.5亿美元,此次合作直指传统药物研发平均耗时十年、耗资数十亿美元的行业痛点。

6 小时前

国内头部大模型创业公司月之暗面(旗下拥有Kimi大语言模型)近期完成股东名单重大更新,国智投、北京人工智能基金等国资机构及中国移动正式入局,总额20亿美元的新一轮融资已步入收尾阶段,不到半年其累计融资额突破39亿美元,最新估值较去年11月的43亿美元实现4倍增长,成为国内资本关注度最高的AI创业项目之一。

6 小时前

近日谷歌旗下整合了新一代Gemini大模型的秘密终端项目GoogleBook引发全行业热议,据上游供应链披露的不完全参数显示,该设备可实现70%的AI运算本地离线完成,近期第三方调研机构针对120名AI行业分析师的问卷显示,仅38%受访者看好其成为现象级产品,本文将拆解该项目的市场机会与现存争议。

6 小时前

2026年5月19日腾讯云正式官宣,旗下智能体开发平台ADP搭载的两款核心大模型Hy3preview、DeepSeek-V4-Pro,将于2026年5月27日10点结束全用户免费公测,全面转入正式商业化运营,后续采用实际调用量按量计费规则,配套四档梯度订阅套餐覆盖不同规模用户需求,为国内智能体落地的成本体系划定了新的参考标尺。

6 小时前

以OpenAI为代表的全球大模型厂商当前算力缺口年增速超70%,多地超大型集中式数据中心落地因能耗、用地争议持续受阻,资深AI基础设施分析师张辰近期提出全新落地构想,将家庭闲置的AI边缘设备组网形成分布式算力池,可降低30%以上新增算力投入成本,快速填补集中式算力的供给缺口。

6 小时前

亚马逊本月正式为旗下智能语音助手Alexa的付费升级版本Alexa+上线AI播客生成功能,用户无需手动操作,仅通过语音指令就能在数秒内获得任意主题的定制化播客内容,目前该服务已在北美地区面向所有订阅Alexa+会员的用户开放,是生成式AI落地智能家居交互场景的最新标杆级案例。