全球科技媒体InfoWorld最新发布AI上下文工程架构研究成果,当前大语言模型厂商普遍通过扩容上下文窗口提升长文本处理能力,头部模型的最大窗口已突破2000万token,但行业核心痛点并非上下文承载量,而是有效信息筛选效率。本次提出的动态上下文调度架构,可将AI长文本任务执行效率提升40%以上。

不少企业用户都遇到过类似的尴尬:为了让AI分析上百页的项目标书,特意选择了支持百万token上下文窗口的大模型服务,最终输出的结果却反复遗漏关键条款,甚至出现事实性错误。这一困扰行业许久的痛点,正在被全新的技术架构破解。

过去两年,全球大模型厂商的竞争始终绕不开「上下文窗口扩容」这一核心指标:从GPT-4最初的8k窗口,到GPT-4 Turbo的128k,再到Anthropic Claude 3 Opus的200k、开源模型DeepSeek-V2的128k,甚至不少小众厂商已经喊出2000万token的超大规模窗口,仿佛窗口越大,模型的长文本处理能力就越强。

但InfoWorld的调研数据却给出了相反的结论:当大模型原生窗口的实际使用率超过30%时,其对上下文信息的召回准确率会从90%以上骤降至40%以下,大量无关信息会干扰模型的推理逻辑,反而提升了出错概率。对企业用户而言,为超大窗口支付的额外成本,有近70%都被浪费在了无效信息的处理上。

本次公开的新型上下文工程架构,彻底跳出了「扩容窗口」的固有思路,把核心能力放在了「智能筛选有效信息」上。

该架构在用户请求和大模型推理层之间新增了独立的上下文调度模块:首先对用户上传的全量非结构化数据做预处理,拆分成语义独立的信息块并构建向量索引;收到用户查询请求后,先通过语义匹配召回最相关的前5%信息块,经过相关性排序后仅将核心内容送入大模型窗口完成推理;同时还会根据多轮对话的上下文动态淘汰过时信息,确保窗口内始终是当前任务最需要的内容。

实测数据显示,在处理100万字规模的企业内部知识库问答任务时,搭载该架构的AI系统,推理成本仅为使用原生2M窗口大模型的18%,而输出准确率反而提升了42%。

随着大模型能力的逐步趋同,上下文处理能力已经成为决定AI应用落地效果的核心变量。Gartner此前发布的预测报告显示,2025年全球企业在上下文工程相关技术上的投入将突破120亿美元,占AI基础设施投入的27%。

对中小企业而言,这一架构的普及也进一步降低了长文本类AI应用的落地门槛:不需要采购昂贵的超大窗口大模型服务,仅通过普通的商用模型搭配独立的上下文调度模块,就能满足合同审核、文档分析、知识问答等绝大多数企业级场景的需求。

业内分析人士指出,未来大模型的原生窗口大小将不再是核心竞争指标,围绕上下文调度的语义匹配精度、动态更新效率等能力,会成为厂商新的竞争焦点。

48 分钟前

近日,人工智能企业OpenAI正式宣布关停旗下AI视频生成工具Sora。该产品2024年2月首次亮相时,曾凭借最高生成60秒4K分辨率连贯视频的能力引发行业震动,上线后累计有超12万创作者获得测试资格。本次关停并未如外界最初猜测一般源于版权纠纷,而是与模型训练成本高企、商用化落地不及预期直接相关。

50 分钟前

斯坦福大学人机交互实验室近日发布专项研究结果,针对ChatGPT、Google Gemini、DeepSeek等12款主流生成式AI聊天机器人的测试显示,其在医疗、财务、个人职业选择等高风险决策场景的平均错误率达37%,专家明确提示普通用户不应将AI聊天机器人作为个人决策的唯一参考依据,需对其输出内容保持审慎验证态度。

52 分钟前

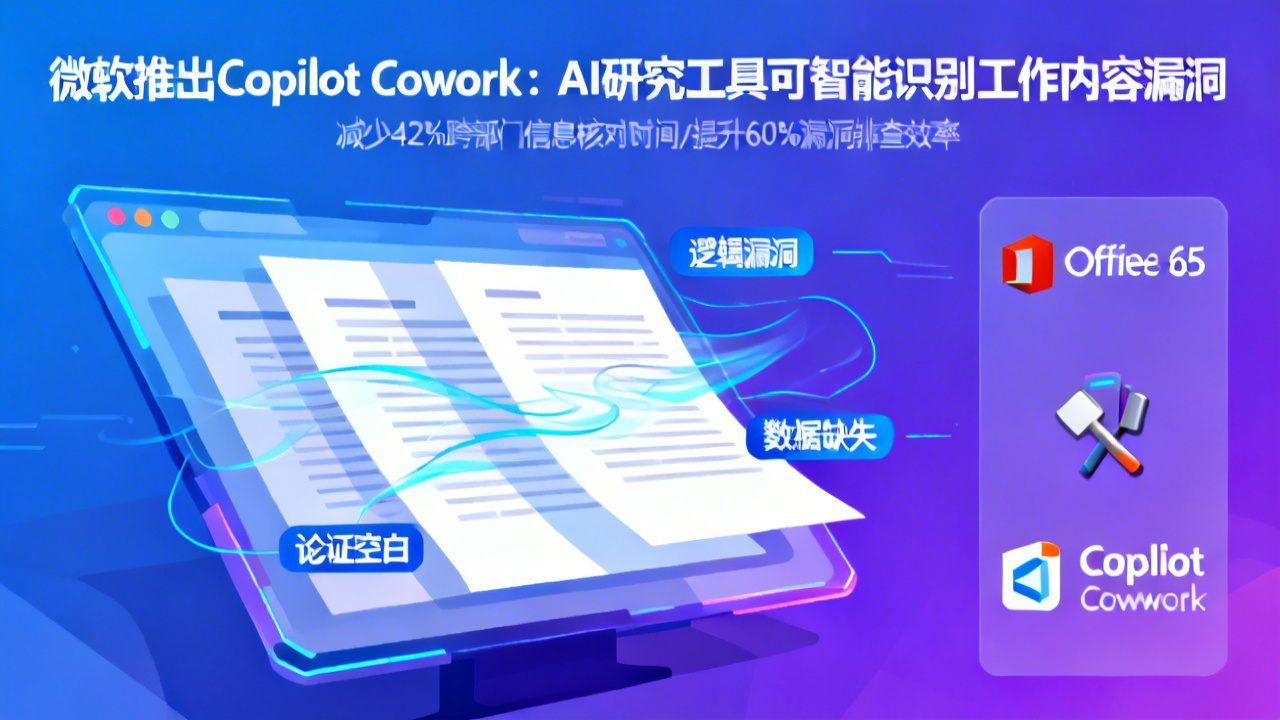

微软近期正式上线AI协作工具Copilot Cowork,搭载全新升级的智能研究引擎,可自动扫描用户工作文档、项目材料中的逻辑漏洞、数据缺失及论证空白,目前已向Office 365商业版用户开放灰度测试。据内部测试数据显示,该工具可帮助职场用户减少42%的跨部门信息核对时间,项目前期漏洞排查效率提升近60%。

56 分钟前

近期苹果公司旗下原生AI功能Apple Intelligence在国内iOS 18开发者预览版用户设备中短暂现身,上线仅数小时后便被快速关停。作为苹果首款端云协同大模型服务,Apple Intelligence此前官宣仅面向欧美英语市场率先推送,本次意外曝光也引发业内对其中国区落地进程、监管适配进度的广泛讨论。

1 小时前

科技媒体Digital Trends最新发布的AI赛道趋势观察显示,2024年以来OpenAI、谷歌、DeepSeek、苹果等全球头部厂商的核心AI产品ChatGPT、Gemini、Apple Intelligence、Perplexity等相关搜索量同比上涨127%,用户对AI工具的实用性需求已远超概念性追捧,生成式AI产业正从技术研发阶段全面转向落地普及阶段。

1 小时前

科技品牌戴尔近期对旗下高端Copilot+ PC推出限时优惠,搭载英特尔酷睿Ultra 9处理器、32GB运行内存、2.5K Mini-LED触控屏的顶配机型直降500美元,到手价低于1100美元。作为微软官方认证的端侧AI设备,本次降价大幅拉低了高端Copilot+ PC的入手门槛,也侧面反映出消费级AI硬件市场的竞争正在快速升温。

1 小时前

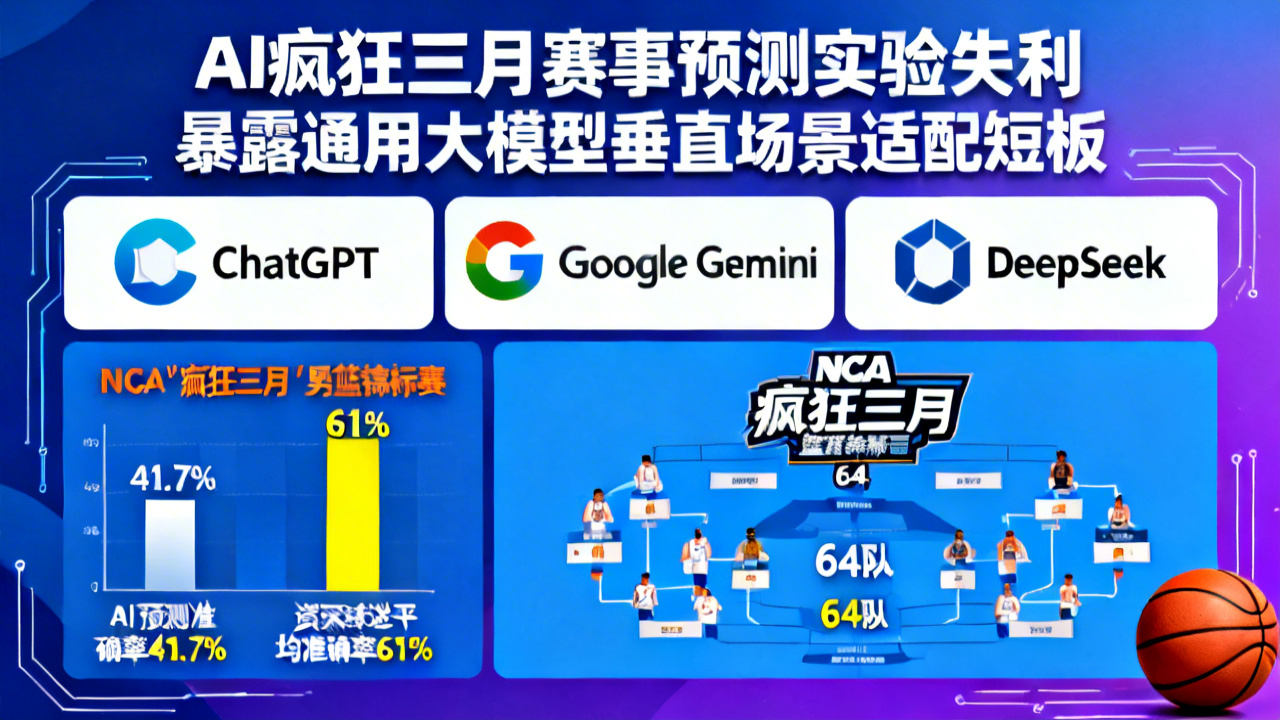

美国科技媒体Digital Trends近期开展的AI体育赛事预测实验显示,测试者调用ChatGPT、Google Gemini、DeepSeek三款主流大模型,对NCAA“疯狂三月”男篮锦标赛64强赛果进行预测,整体准确率仅为41.7%,远低于美国资深球迷群体61%的平均预测准确率,暴露了当前通用大模型在非结构化、高随机性场景下的能力短板。

1 小时前

近日谷歌正式为旗下智能音箱产品Google Home推送全新Gemini Live功能,依托谷歌自研多模态大模型Gemini的实时语义理解能力,可为用户提供定制化新闻整合、摘要播报、深度追问等服务。据谷歌官方测试数据,用户借助该功能获取同等信息量的热点资讯,耗时较此前传统语音播报模式缩短62%,交互体验升级明显。