2026年3月18日,OpenAI正式推出GPT-5.4 mini、GPT-5.4 nano两款轻量化大模型,主打高频低延迟场景需求。其中GPT-5.4 mini运行速度较前代提升2倍以上,多项基准测试成绩逼近满血版GPT-5.4;GPT-5.4 nano为旗下体积最小、成本最低的大模型版本,可适配代码辅助、实时图像推理等多元端侧场景。

在大模型落地成本高企、端侧实时响应需求持续攀升的行业背景下,小模型正在成为AI巨头争夺的新赛点,OpenAI此次发布的两款新品,直接拉高了全球轻量化大模型的性能天花板。

过去两年,大模型的性能迭代已经进入相对平稳期,行业的核心痛点逐渐从“能不能用”转向“能不能便宜用、快速用”。不管是开发者需要的实时代码辅助、企业级的批量数据处理,还是C端用户常用的截图解析、实时语音交互,都对AI的响应延迟、调用成本提出了极高要求。此前参数规模庞大的满血版大模型虽然性能优异,但推理成本高、响应速度慢,很难覆盖这类高频轻量化场景,也催生了市场对高性能小模型的迫切需求。

此次OpenAI推出的两款小模型,针对不同场景做了精准的性能调校,实现了轻量化与高能力的罕见平衡。

其中GPT-5.4 mini主打高性能轻量化需求,运行速度较上一代同级别小模型提升2倍以上,在代码编写、逻辑推理、多模态理解三个核心维度的表现远超前代产品。根据官方公布的基准测试数据,这款模型的综合得分已经逼近体积是其数倍的满血版GPT-5.4,完全可以胜任复杂数据库导航、前端代码生成、实时截图解析这类此前只有大模型才能完成的任务。

而GPT-5.4 nano则主打极致性价比,是目前OpenAI旗下体积最小、调用成本最低的大模型版本,专门针对文本分类、结构化数据提取、简单交互辅助等标准化轻量场景设计,适合开发者嵌入到各类轻量化应用、端侧设备中使用,无需消耗高额算力就能实现稳定的AI能力输出。

事实上,在OpenAI此次发布之前,包括Anthropic、DeepSeek在内的多家AI厂商都已经推出了自己的小模型产品,争夺轻量化场景的市场份额。OpenAI此次将小模型的性能提升到接近满血版大模型的水平,无疑会进一步拉高行业的竞争门槛,也会推动小模型技术的快速迭代。

对于产业端而言,高性能小模型的普及会直接降低AI的使用成本,大量此前因为算力成本过高无法落地的场景,比如线下零售的实时商品识别、工业设备的实时异常检测、嵌入式设备的语音助手等,都将迎来规模化落地的机会。而普通用户也会在各类日常应用中感受到更快的AI响应速度、更稳定的功能体验。

57 分钟前

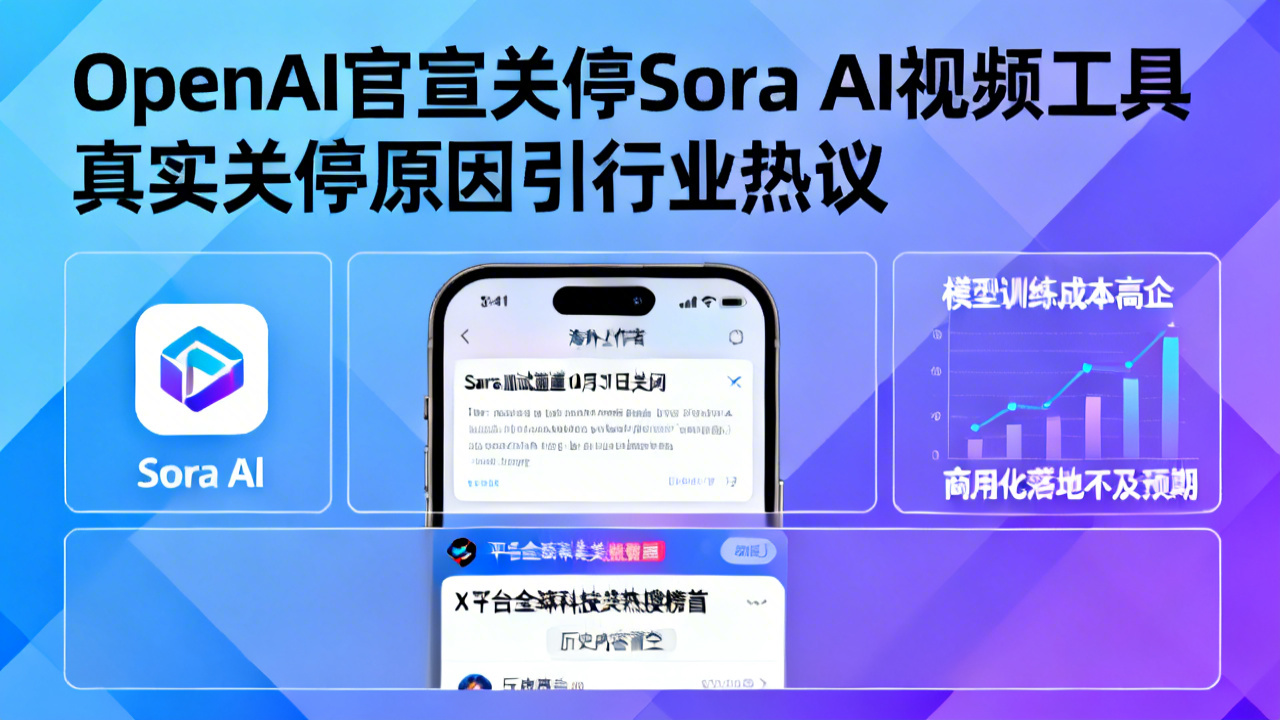

近日,人工智能企业OpenAI正式宣布关停旗下AI视频生成工具Sora。该产品2024年2月首次亮相时,曾凭借最高生成60秒4K分辨率连贯视频的能力引发行业震动,上线后累计有超12万创作者获得测试资格。本次关停并未如外界最初猜测一般源于版权纠纷,而是与模型训练成本高企、商用化落地不及预期直接相关。

59 分钟前

斯坦福大学人机交互实验室近日发布专项研究结果,针对ChatGPT、Google Gemini、DeepSeek等12款主流生成式AI聊天机器人的测试显示,其在医疗、财务、个人职业选择等高风险决策场景的平均错误率达37%,专家明确提示普通用户不应将AI聊天机器人作为个人决策的唯一参考依据,需对其输出内容保持审慎验证态度。

1 小时前

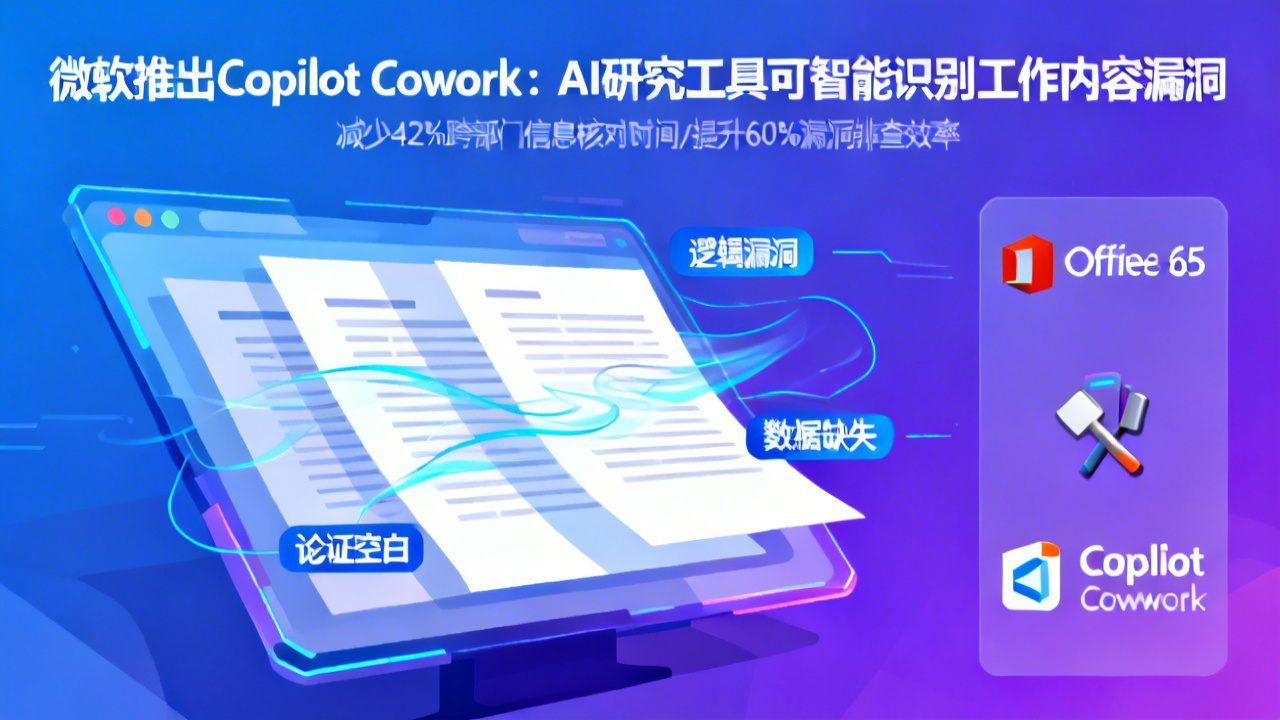

微软近期正式上线AI协作工具Copilot Cowork,搭载全新升级的智能研究引擎,可自动扫描用户工作文档、项目材料中的逻辑漏洞、数据缺失及论证空白,目前已向Office 365商业版用户开放灰度测试。据内部测试数据显示,该工具可帮助职场用户减少42%的跨部门信息核对时间,项目前期漏洞排查效率提升近60%。

1 小时前

近期苹果公司旗下原生AI功能Apple Intelligence在国内iOS 18开发者预览版用户设备中短暂现身,上线仅数小时后便被快速关停。作为苹果首款端云协同大模型服务,Apple Intelligence此前官宣仅面向欧美英语市场率先推送,本次意外曝光也引发业内对其中国区落地进程、监管适配进度的广泛讨论。

1 小时前

科技媒体Digital Trends最新发布的AI赛道趋势观察显示,2024年以来OpenAI、谷歌、DeepSeek、苹果等全球头部厂商的核心AI产品ChatGPT、Gemini、Apple Intelligence、Perplexity等相关搜索量同比上涨127%,用户对AI工具的实用性需求已远超概念性追捧,生成式AI产业正从技术研发阶段全面转向落地普及阶段。

1 小时前

科技品牌戴尔近期对旗下高端Copilot+ PC推出限时优惠,搭载英特尔酷睿Ultra 9处理器、32GB运行内存、2.5K Mini-LED触控屏的顶配机型直降500美元,到手价低于1100美元。作为微软官方认证的端侧AI设备,本次降价大幅拉低了高端Copilot+ PC的入手门槛,也侧面反映出消费级AI硬件市场的竞争正在快速升温。

1 小时前

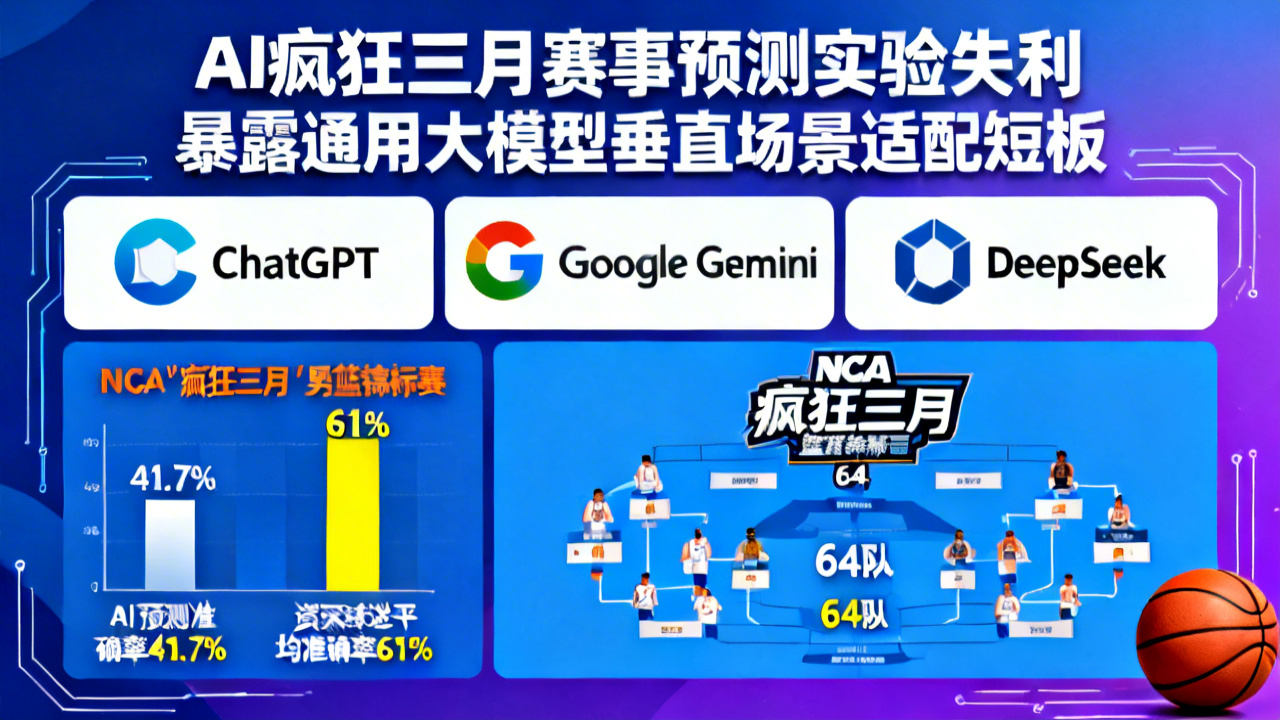

美国科技媒体Digital Trends近期开展的AI体育赛事预测实验显示,测试者调用ChatGPT、Google Gemini、DeepSeek三款主流大模型,对NCAA“疯狂三月”男篮锦标赛64强赛果进行预测,整体准确率仅为41.7%,远低于美国资深球迷群体61%的平均预测准确率,暴露了当前通用大模型在非结构化、高随机性场景下的能力短板。

1 小时前

近日谷歌正式为旗下智能音箱产品Google Home推送全新Gemini Live功能,依托谷歌自研多模态大模型Gemini的实时语义理解能力,可为用户提供定制化新闻整合、摘要播报、深度追问等服务。据谷歌官方测试数据,用户借助该功能获取同等信息量的热点资讯,耗时较此前传统语音播报模式缩短62%,交互体验升级明显。