2026年3月11日谷歌正式推出旗下首个原生多模态嵌入模型Gemini Embedding 2,不同于专注内容生成的Gemini 3系列,该模型可将文本、图像、视频、音频、文档五类数据统一映射至同一向量空间,支持100种语言语义识别,跨模态匹配精度较行业现有方案提升47%,为搜索、内容管理等场景带来全新技术解决方案。

在AI应用体系中,嵌入模型一直是低调的“幕后功臣”——不同于频繁出现在公众视野里的生成式大模型,它负责将各类非结构化数据转化为机器可识别的向量,是搜索、推荐、内容管理等功能的核心底座。过去数年,行业内的嵌入模型始终受困于单模态局限,跨媒体内容理解的误差率长期居高不下,直到谷歌本次的新品发布,才给这一痛点带来了彻底的解决方案。

此前主流嵌入模型大多只适配单一数据类型,文本嵌入模型无法识别图像内容,视频嵌入模型也无法匹配语义相关的文档,若要实现跨模态检索,只能通过多个模型拼接的方案实现,不仅计算成本高,多次转换带来的误差还会让最终匹配精度下降30%以上。这一短板也直接限制了多个场景的体验升级:比如通用搜索引擎无法直接用一张图片搜索语义相关的视频片段,企业内部知识库检索时也难以关联不同格式的同类内容。

本次发布的Gemini Embedding 2是谷歌首个原生训练的多模态嵌入模型,核心突破在于实现了五类异构数据的统一向量空间映射——无需拆分调用多个单模态模型,就可以直接处理文本、PNG/JPEG格式图像、最长120秒的MP4/MOV视频、原生音频文件以及最多6页的PDF文档,将所有内容的语义特征转化为同一坐标系下的向量。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

1 小时前

近期GitHub、Stack Overflow等全球开发者平台监测数据显示,AI编码工具普及后开发者人均编码效率提升超220%,但低质量重复“垃圾代码”占比同比上涨47%。包括OpenAI ChatGPT、GitHub Copilot、DeepSeek Coder在内的主流AI编码工具均被指易生成冗余、兼容性差的代码,给长期项目维护埋下风险,引发全球开发社区广泛热议。

2 小时前

2026年4月,亚马逊创始人杰夫·贝索斯旗下全新神秘AI实验室Project Prometheus宣布前OpenAI联合创始人Kyle Kosic正式入职。该实验室专注于开发可理解物理世界的先进人工智能系统,旨在突破现有大模型技术边界,打造更高自主性的智能系统,标志着贝索斯在AI前沿领域的布局进入落地阶段。

4 小时前

2026年4月初,英格兰依什米安超级联赛球队联合联正式签约全球首批AI职业球员Holly与Harvey,二者因无物理实体无法参与实际赛事,定位为俱乐部内容创作与品牌运营核心。4月7日联合联官宣已出售两名AI球员,收取数额未公开的虚拟转会费,该事件在足球界与科技界引发关于体育数字化边界的广泛讨论。

4 小时前

2026年4月国际大模型API分发平台OpenRouter公布的最新榜单显示,阿里旗下千问3.6 Plus登顶全球大模型周调用量榜首,且已连续4天霸榜日榜,该模型也成为平台上线以来首个单日调用量突破1万亿Token的大模型,标志着国产大模型凭借技术迭代、高性价比优势在全球市场的竞争力进一步提升。

4 小时前

印度人工智能初创企业Rocket于近期正式发布全新智能咨询平台,该平台跳出传统AI工具聚焦代码生成的限制,整合战略规划、产品搭建、竞争情报三大核心能力,可输出对标麦肯锡等头部咨询公司的专业分析报告,而服务成本仅为传统咨询的几分之一,大幅降低了中小微企业获取专业决策支持的门槛。

6 小时前

根据全球大模型聚合平台OpenRouter2026年4月发布的监测数据,2026年3月30日至4月5日中国AI大模型周调用量达12.96万亿Token,环比增长31.48%,是美国同期调用量的4倍以上。全球大模型周调用量榜单前六均为国产模型,阿里旗下Qwen3.6系列、小米MiMo-V2-Pro分列前三,凸显中国AI应用端的规模领先优势。

6 小时前

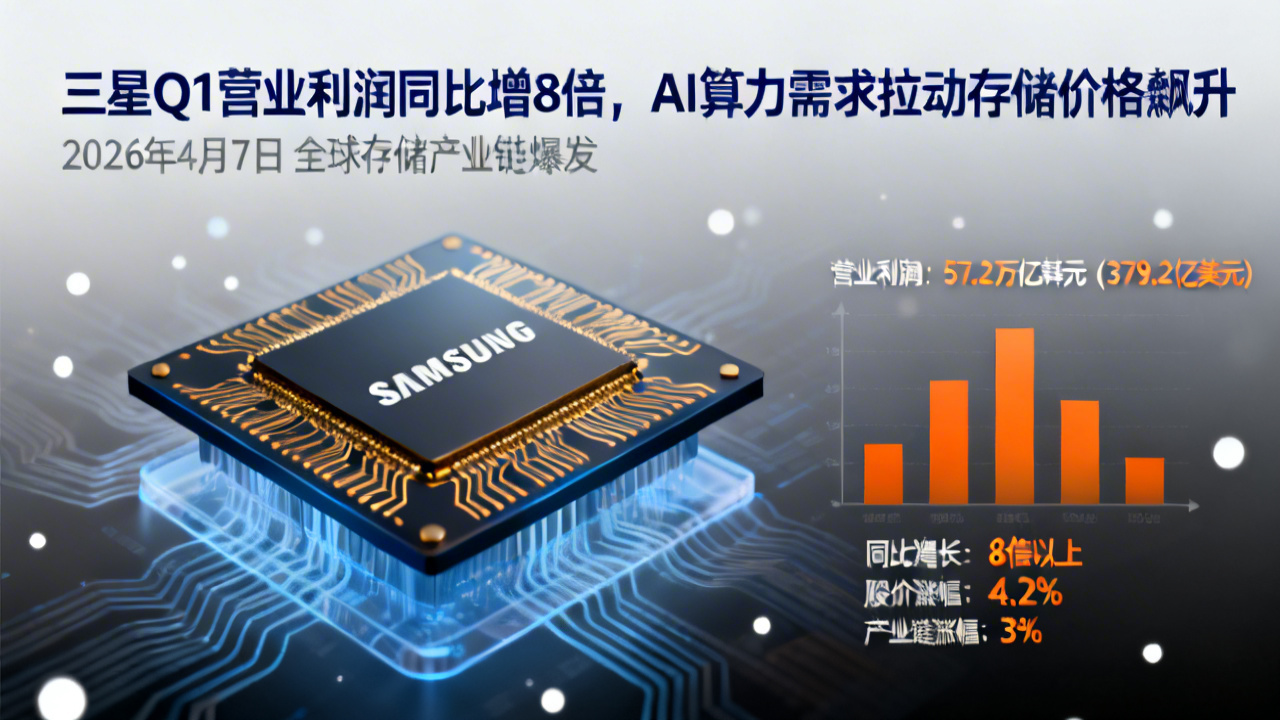

2026年4月7日,全球存储巨头三星电子发布2026年第一季度初步业绩预告,预计营业利润达57.2万亿韩元(约合379.2亿美元),较去年同期增长8倍以上,远超分析师预期的40.6万亿韩元。此轮业绩暴涨核心动力为生成式AI基础设施建设带来的存储芯片需求激增,存储价格大幅上涨推动行业彻底走出此前的下行周期。

6 小时前

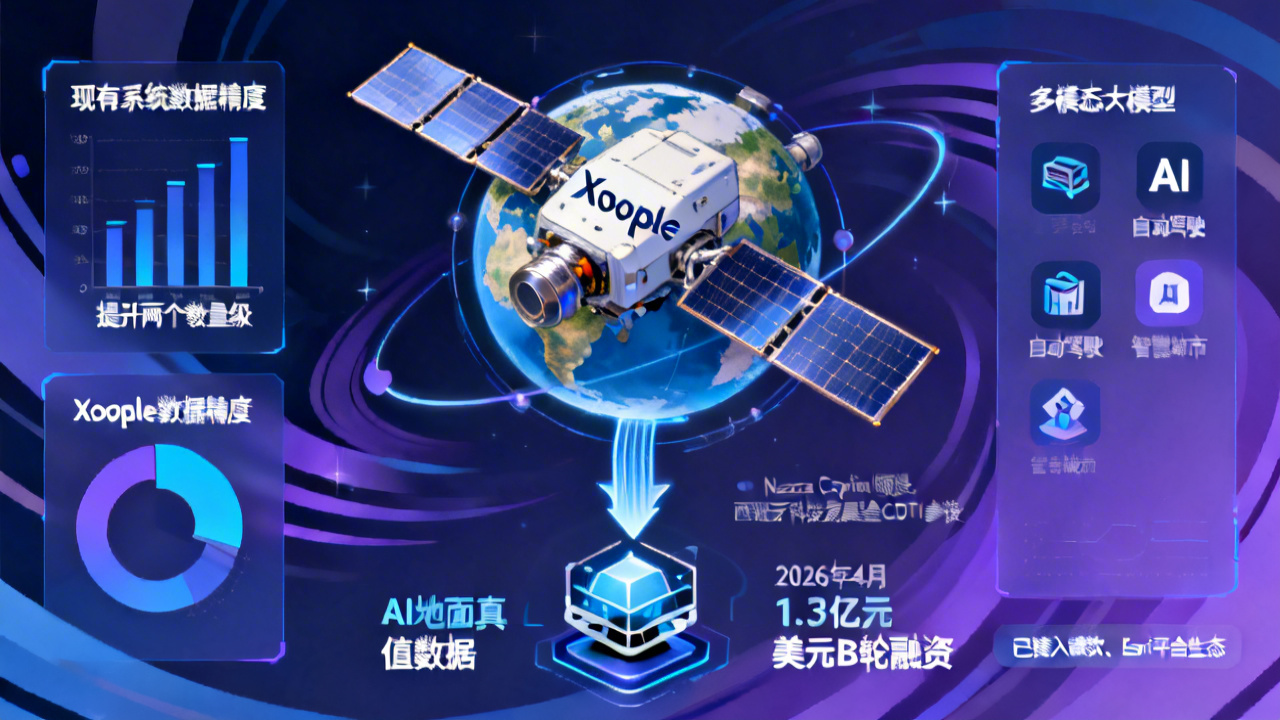

2026年4月,西班牙卫星初创公司Xoople宣布完成1.3亿美元B轮融资,本轮由Nazca Capital领投,西班牙科技发展基金CDTI等机构参投。公司专注为AI模型提供地面真值数据源,CEO Fabrizio Pirondini称其专用卫星星座采集的数据精度较现有系统提升两个数量级,目前已接入微软、Esri等企业级平台生态。