2026年4月1日,阿里正式发布新一代图像生成与编辑统一模型Wan2.7-Image,首次将文生图、图生组图、图像指令编辑、交互式编辑整合到同一架构下,主打可定制五官骨相的千人千面捏脸、精准色彩控制、最高3K token超长文字渲染、像素级区域编辑四大核心能力,直击AI图像生成同质化、可控性弱等行业痛点。

在过往的AI图像生成体验中,“千人同脸”“文字乱码”“编辑只能推翻重生成”是不少用户吐槽的高频问题——不少设计师甚至调侃,用AI做图花在调试prompt、修BUG的时间,比自己手动做图还要久。阿里本次推出的新模型,正是瞄准这些行业长期存在的痛点进行的技术迭代。

从2022年Stable Diffusion开源引爆AI图像生成赛道以来,国内外厂商的技术迭代长期聚焦于“生成质量”的提升,先后解决了图像分辨率低、人物结构崩坏、风格单一等问题,但“可控性不足”始终是制约行业落地的核心短板。

对普通用户而言,要生成符合预期的定制化内容往往需要反复调试prompt,最终效果依然差强人意;对电商、设计、游戏等专业领域客户而言,AI生成内容的色彩偏差、文字乱码、无法局部修改等问题,更是让其难以直接落地商用,整个赛道都在等待更高可控性的技术方案。

本次阿里发布的Wan2.7-Image最大的架构创新,就是将图像生成和编辑能力整合到同一套模型体系中,用户不用在多个工具间切换,就能完成从内容生成到细节修改的全流程操作,核心能力覆盖四大场景:

其一就是引发行业高度关注的千人千面捏脸功能,用户可以通过文字描述直接调整人物的五官、骨相、肤质特征,不需要额外训练LoRA模型,就能生成完全不重复的定制化人脸,彻底解决过往AI生成人物“换皮不换骨”的同脸问题。

其二是精准色彩控制的“调色盘”功能,用户可以直接指定生成内容的色彩配比、色值参数,模型就能1:1还原预期色彩,不会出现过往生成内容偏色、色差大的问题,完全满足品牌设计的色彩规范要求。

登录后解锁全文,体验收藏、点赞、评论等完整功能

立即登录

27 分钟前

根据全球大模型聚合平台OpenRouter2026年4月发布的监测数据,2026年3月30日至4月5日中国AI大模型周调用量达12.96万亿Token,环比增长31.48%,是美国同期调用量的4倍以上。全球大模型周调用量榜单前六均为国产模型,阿里旗下Qwen3.6系列、小米MiMo-V2-Pro分列前三,凸显中国AI应用端的规模领先优势。

29 分钟前

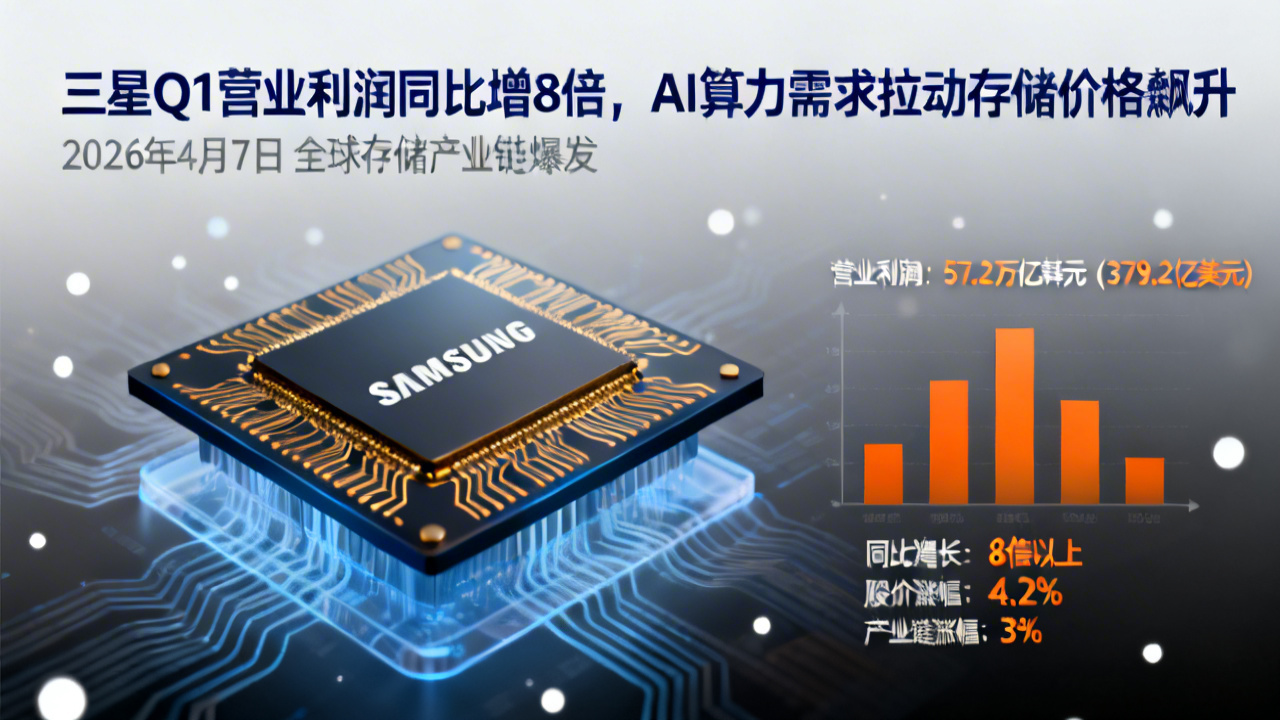

2026年4月7日,全球存储巨头三星电子发布2026年第一季度初步业绩预告,预计营业利润达57.2万亿韩元(约合379.2亿美元),较去年同期增长8倍以上,远超分析师预期的40.6万亿韩元。此轮业绩暴涨核心动力为生成式AI基础设施建设带来的存储芯片需求激增,存储价格大幅上涨推动行业彻底走出此前的下行周期。

51 分钟前

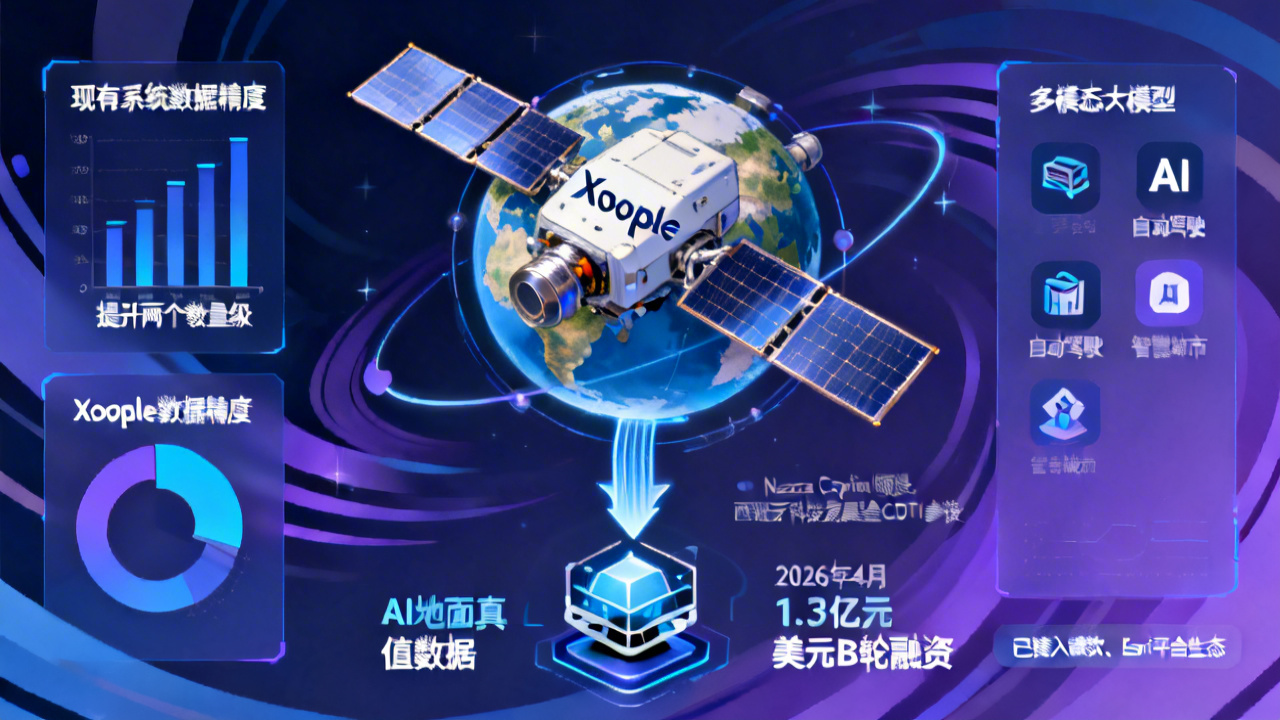

2026年4月,西班牙卫星初创公司Xoople宣布完成1.3亿美元B轮融资,本轮由Nazca Capital领投,西班牙科技发展基金CDTI等机构参投。公司专注为AI模型提供地面真值数据源,CEO Fabrizio Pirondini称其专用卫星星座采集的数据精度较现有系统提升两个数量级,目前已接入微软、Esri等企业级平台生态。

57 分钟前

根据全球AI模型分发平台OpenRouter2026年4月7日发布的监测数据,中国AI大模型周调用量已连续五周超越美国,2026年3月30日至4月5日当周达12.96万亿Token,环比增长31.48%,占全球总调用量近五成。阿里巴巴Qwen系列、小米MiMo-V2-Pro等产品表现突出,中国厂商包揽全球大模型周调用量榜单前六位。

1 小时前

2026年4月,Ted Entertainment、Matt Fisher、Golfholics三家YouTube频道共同发起集体诉讼,指控苹果、亚马逊、OpenAI绕过平台反爬虫机制,非法下载数百万条视频数据用于AI模型训练,争议核心为包含数千万训练样本的Panda-70M数据集,本次诉讼也被视为AI音视频训练数据版权纠纷的标志性案件。

2 小时前

谷歌近期正式推出旗下全新免费AI听写应用,基于Gemini大模型语音模块训练优化,支持多语种混合识别、离线输入等功能。该产品被业内认定为付费听写工具Willow的核心替代选项,上线首周全球下载量突破120万次,92%的首批用户给出四星以上评分,有望改写消费级语音输入工具的现有市场格局。

2 小时前

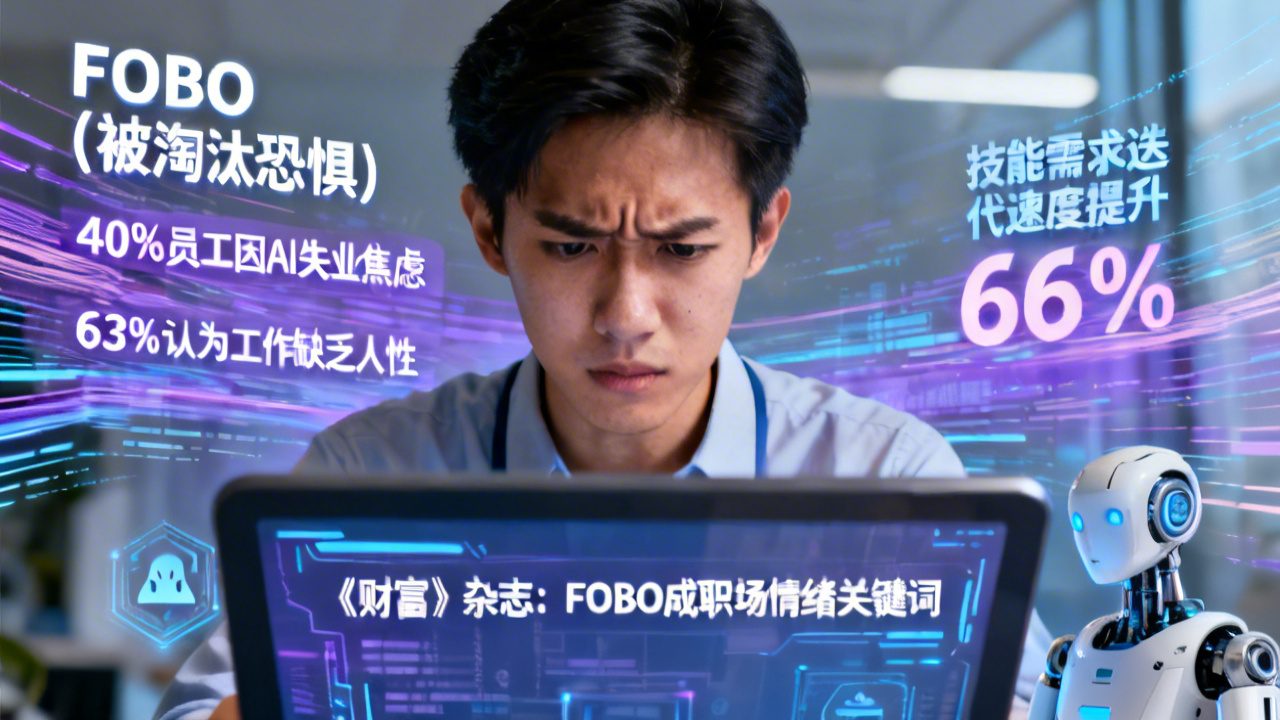

2026年美国职场出现名为FOBO(Fear of Becoming Obsolete,即被淘汰恐惧)的新型职场心理。毕马威调研显示,40%员工将AI导致的失业作为主要焦虑源,63%受访者认为AI让工作环境更缺乏人性。Anthropic CEO达里奥·阿莫代伊、微软AI CEO穆斯塔法·苏莱曼等行业人士均提示AI对白领岗位的替代风险,当前岗位技能需求迭代速度较一年前提升66%。

2 小时前

2026年4月,国家安全部就AI核心基础单元词元(Token)发布专项安全警示,当前国内词元日均调用量已突破140万亿,截至2026年3月调用规模较2024年初增长超千倍。随着国家数据局正式对Token作出定名,其已成为智能时代的AI服务核心结算单位,此次警示重点点名身份劫持、金融骗局等新型风险,为快速扩张的AI应用市场敲响安全警钟。